Postgres 杀疯了,堪称 “六边形战士”,还要 Redis 干啥?

我们需要谈谈困扰我几个月的事情。我一直看到独立黑客和初创公司创始人疯狂地拼凑各种技术栈,用 Redis 做缓存,用 RabbitMQ 做队列,用 Elasticsearch 做搜索,还有用 MongoDB……为什么?

我也犯过这种错误。当我开始构建UserJot(我的反馈和路线图工具)时,我的第一反应是规划一个“合适的”架构,为所有功能提供独立的服务。然后我停下来问自己:如果我把所有功能都用 Postgres 来做会怎么样?

事实证明,房间里有一头大象,但没人愿意承认:

| Postgres 几乎可以做到这一切。 |

|---|

而且它的效果比你想象的还要好。

“Postgres 无法扩展”的谬论正在让你损失金钱?

让我猜猜——有人告诉你,Postgres“只是一个关系数据库”,需要专门的工具来完成专门的工作。我以前也是这么想的,直到我发现 Instagram 可以在单个 Postgres 实例上扩展到 1400 万用户。Discord 处理数十亿条消息。Notion 的整个产品都是基于 Postgres 构建的。

但问题是:他们不再像 2005 年那样使用 Postgres。

队列系统

别再为 Redis 和 RabbitMQ 付费了。Postgres 原生支持LISTEN/NOTIFY并且比大多数专用解决方案更好地处理作业队列:

-- Simple job queue in pure Postgres

CREATETABLE job_queue (

id SERIAL PRIMARY KEY,

job_type VARCHAR(50),

payload JSONB,

status VARCHAR(20) DEFAULT'pending',

created_at TIMESTAMPDEFAULT NOW(),

processed_at TIMESTAMP

);

-- ACID-compliant job processing

BEGIN;

UPDATE job_queue

SET status ='processing', processed_at = NOW()

WHERE id = (

SELECT id FROM job_queue

WHERE status ='pending'

ORDERBY created_at

FORUPDATESKIP LOCKED

LIMIT 1

)

RETURNING *;

COMMIT;

这让你无需任何额外的基础设施就能实现 Exactly-Once 的处理。不妨试试用 Redis 来实现,会让你很抓狂。

在 UserJot 中,我正是使用这种模式来处理反馈提交、发送通知和更新路线图项目。只需一次事务,即可保证一致性,无需消息代理的复杂性。

键值存储

Redis 在大多数平台上的最低价格为 20 美元/月。Postgres JSONB 已包含在您现有的数据库中,可以满足您的大部分需求:

-- Your Redis alternative

CREATETABLE kv_store (

key VARCHAR(255) PRIMARY KEY,

value JSONB,

expires_at TIMESTAMP

);

-- GIN index for blazing fast JSON queries

CREATE INDEX idx_kv_value ON kv_store USING GIN (value);

-- Query nested JSON faster than most NoSQL databases

SELECT*FROM kv_store

WHEREvalue @>'{"user_id": 12345}';

运算符@>是 Postgres 的秘密武器。它比大多数 NoSQL 查询更快,并且数据保持一致。

全文搜索

Elasticsearch 集群价格昂贵且复杂。Postgres 内置的全文搜索功能非常出色:

-- Add search to any table

ALTERTABLE posts ADDCOLUMN search_vector tsvector;

-- Auto-update search index

CREATEOR REPLACE FUNCTION update_search_vector()

RETURNStriggerAS $

BEGIN

NEW.search_vector := to_tsvector('english',

COALESCE(NEW.title, '') ||' '||

COALESCE(NEW.content, '')

);

RETURNNEW;

END;

$ LANGUAGE plpgsql;

-- Ranked search results

SELECT title, ts_rank(search_vector, query) as rank

FROM posts, to_tsquery('startup & postgres') query

WHERE search_vector @@ query

ORDERBY rank DESC;

这可以处理模糊匹配、词干提取和相关性排名。

对于 UserJot 的反馈搜索,此功能可让用户跨标题、描述和评论即时查找功能请求。无需 Elasticsearch 集群 - 只需使用 Postgres 即可发挥其优势。

实时功能

忘掉复杂的 WebSocket 基础架构吧。Postgres LISTEN/NOTIFY无需任何附加服务即可为您提供实时更新:

-- Notify clients of changes

CREATEOR REPLACE FUNCTION notify_changes()

RETURNStriggerAS $

BEGIN

PERFORM pg_notify('table_changes',

json_build_object(

'table', TG_TABLE_NAME,

'action', TG_OP,

'data', row_to_json(NEW)

)::text

);

RETURNNEW;

END;

$ LANGUAGE plpgsql;

您的应用程序会监听这些通知并向用户推送更新。无需 Redis 的发布/订阅机制。

“专业”工具的隐性成本

我们来算一下。一个典型的“现代”堆栈的成本是:

- Redis:20美元/月

- 消息队列:25美元/月

- 搜索服务:50美元/月

- 监控 3 项服务:30 美元/月

- 总计:每月 125 美元

但这还只是托管成本。真正的痛点在于:

运营开销:

- 三种不同的服务用于监控、更新和调试

- 不同的缩放模式和故障模式

- 需要维护多种配置

- 单独的备份和灾难恢复程序

- 每项服务的安全考虑因素不同

开发复杂性:

- 客户端库和连接模式

- 多个服务的部署

- 间数据不一致

- 的测试场景

- 的性能调优方法

如果您自行托管,请添加服务器管理、安全补丁以及当 Redis 决定消耗所有内存时不可避免的凌晨 3 点调试会话。

Postgres 使用您已经管理的单一服务来处理所有这些。

扩展的单一数据库

大多数人可能没有意识到:单个 Postgres 实例就能处理海量数据。我们指的是每天数百万笔交易、数 TB 的数据以及数千个并发连接。

真实世界的例子:

- Airbnb:单个 Postgres 集群处理数百万个预订

- Robinhood:数十亿笔金融交易

- GitLab:Postgres 上的整个 DevOps 平台

Postgres 的架构魅力非凡。它被设计成具备极佳的垂直扩展能力,而当你最终需要水平扩展时,它也有以下成熟的方案可供选择:

- 用于查询扩展的读取副本

- 大表分区

- 并发连接池

- 分布式设置的逻辑复制

大多数企业从未达到过这些限制。在处理数百万用户或复杂的分析工作负载之前,单个实例可能就足够了。

将此与管理所有以不同方式扩展的单独服务进行比较 - 您的 Redis 可能会耗尽内存,而您的消息队列则会遇到吞吐量问题,并且您的搜索服务需要完全不同的硬件。

从第一天起就停止过度设计

现代开发中最大的陷阱是架构式的“宇航员”。我们设计系统时,面对的是我们从未遇到过的问题,我们面对的是从未见过的流量,我们可能永远无法达到的规模。

过度设计循环:

- “我们可能有一天需要扩大规模”

- 添加 Redis、队列、微服务、多个数据库

- 花费数月时间调试集成问题

- 向 47 位用户推出

- 每月支付 200 美元购买可在 5 美元 VPS 上运行的基础设施

与此同时,您的竞争对手的发货速度更快,因为他们在需要分布式系统之前并没有管理它。

更好的方法:

- 从 Postgres 开始

- 监控实际的瓶颈,而不是想象的瓶颈

- 当达到实际极限时扩展特定组件

- 仅在解决实际问题时才增加复杂性

你的用户并不关心你的架构。他们关心的是你的产品是否有效,是否能解决他们的问题。

当你真正需要专用工具时

别误会我的意思——专用工具自有其用处。但你可能在以下情况之前不需要它们:

- 您每分钟处理 100,000 多个作业

- 您需要亚毫秒级的缓存响应

- 您正在对数 TB 的数据进行复杂的分析

- 您有数百万并发用户

- 您需要具有特定一致性要求的全局数据分布

如果您在公众号上阅读强哥这篇文章,那么您可能还没有到达那一步。

为什么这真的很重要

让我大吃一惊的是:Postgres 可以同时充当您的主数据库、缓存、队列、搜索引擎和实时系统。同时还能在所有方面保持 ACID 事务。

-- One transaction, multiple operations

BEGIN;

INSERT INTO users (email) VALUES ('user@example.com');

INSERT INTO job_queue (job_type, payload)

VALUES ('send_welcome_email', '{"user_id": 123}');

UPDATE kv_store SET value = '{"last_signup": "2024-01-15"}'

WHERE key = 'stats';

COMMIT;

尝试在 Redis、RabbitMQ 和 Elasticsearch 上执行此操作,不要哭泣。

无聊的技术却能获胜

Postgres 并不引人注目。它没有华丽的网站,也没有在 TikTok 上爆红。但几十年来,在其他数据库兴衰更迭之际,它一直默默地支撑着互联网。

选择简单、可靠且有效的技术是有道理的。

下一个项目的行动步骤

- 仅从 Postgres 开始- 抵制添加其他数据库的冲动

- 使用 JSONB 实现灵活性- 借助 SQL 的强大功能,您可以获得无架构的优势

- 在 Postgres 中实现队列——节省资金和复杂性

- 仅当达到实际极限时才添加专用工具- 而不是想象中的极限

我的真实经历

UserJot 的构建是这一理念的完美测试案例。它是一个反馈和路线图工具,需要:

- 提交反馈时实时更新

- 针对数千个功能请求进行全文搜索

- 发送通知的后台作业

- 缓存经常访问的路线图

- 用于用户偏好和设置的键值存储

我的整个后端只有一个 Postgres 数据库。没有 Redis,没有 Elasticsearch,没有消息队列。从用户身份验证到实时 WebSocket 通知,一切都由 Postgres 处理。

结果如何?我的功能交付速度更快,需要调试的部件更少,而且基础设施成本也降到了最低。当用户提交反馈、搜索功能或获取路线图变更的实时更新时,一切都由 Postgres 完成。

这不再只是理论上的。它正在实际生产中,通过真实的用户和真实的数据发挥作用。

令人不安的结论

Postgres 或许好得过头了。它功能强大,以至于大多数其他数据库对于 90% 的应用程序来说都显得多余。业界一直说服我们,所有事情都需要专门的工具,但或许我们只是把事情弄得比实际需要的更难。

你的初创公司不必成为分布式系统的样板。它需要为真正的人解决真正的问题。Postgres 让你专注于此,而不是照看基础设施。

因此,下次有人建议添加 Redis 来“提高性能”或添加 MongoDB 来“提高灵活性”时,请问他们:“您是否真的先尝试过在 Postgres 中执行此操作?”

答案可能会让你大吃一惊。我知道,当我完全在 Postgres 上构建UserJot时,它就一直运行顺畅。

| 本文为译文,英文原文地址(可能需要使用魔法访问):dev.to/shayy/postg… |

|---|

来源:juejin.cn/post/7517200182725296178

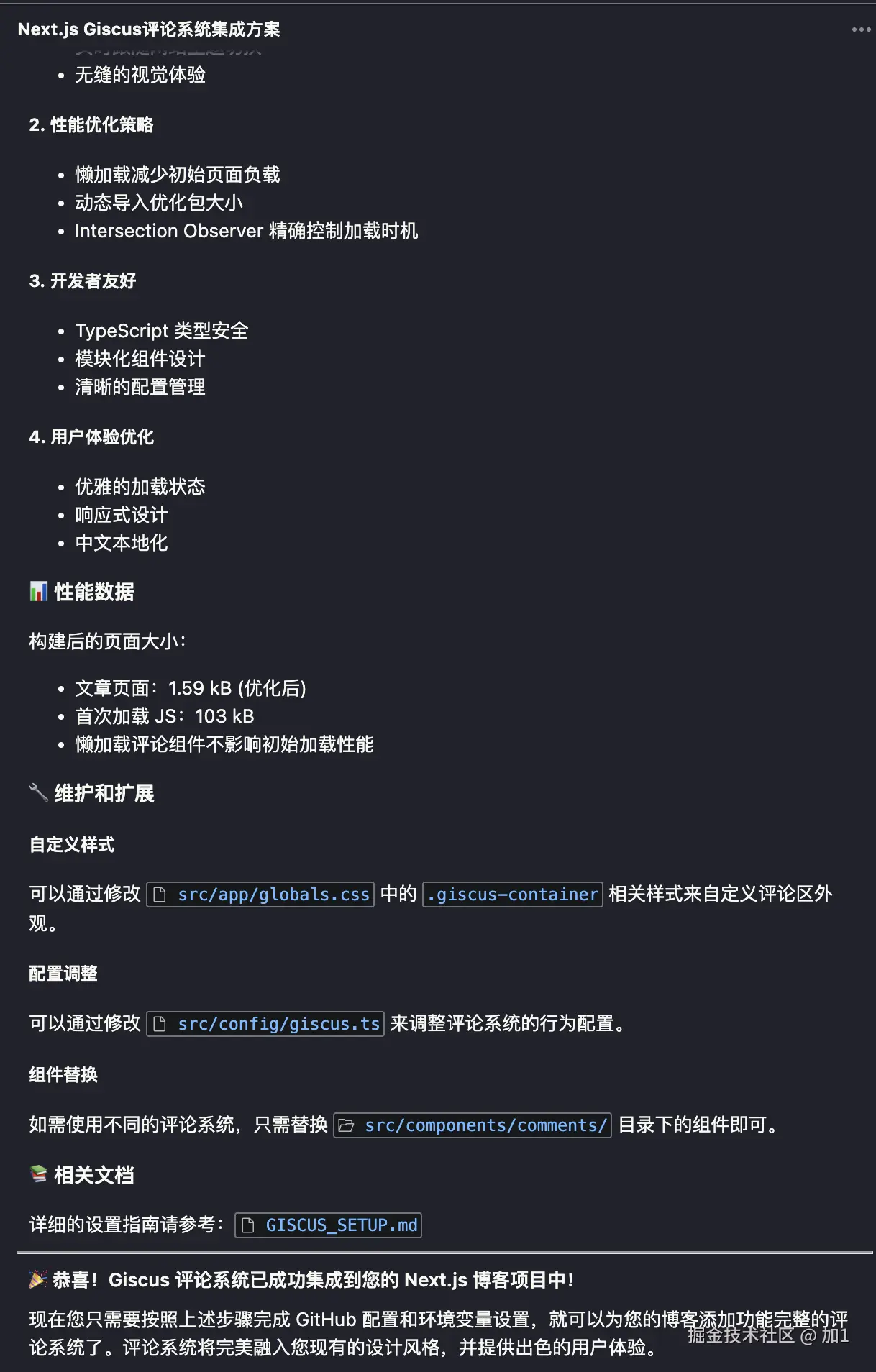

如果产品经理突然要你做一个像抖音一样流畅的H5

从前端到爆点!抖音级 H5 如何炼成?

在万物互联的时代,H5 页面已成为产品推广的利器。当产品经理丢给你一个“像抖音一样流畅的 H5”任务时,是挑战还是机遇?别慌,今天就带你走进抖音 H5 的前端魔法世界。

一、先看清本质:抖音 H5 为何丝滑?

抖音 H5 之所以让人欲罢不能,核心在于两点:极低的卡顿率和极致的交互反馈。前者靠性能优化,后者靠精心设计的交互逻辑。比如,你刷视频时的流畅下拉、点赞时的爱心飞舞,背后都藏着前端开发的“小心机”。

二、性能优化:让页面飞起来

(一)懒加载与预加载协同作战

懒加载是 H5 性能优化的经典招式,只在用户即将看到某个元素时才加载它。但光靠懒加载还不够,聪明的抖音 H5 还会预加载下一个可能进入视野的元素。以下是一个基于 IntersectionObserver 的懒加载示例:

document.addEventListener('DOMContentLoaded', () => {

const lazyImages = [].slice.call(document.querySelectorAll('img.lazy'));

if ('IntersectionObserver' in window) {

let lazyImageObserver = new IntersectionObserver((entries) => {

entries.forEach((entry) => {

if (entry.isIntersecting) {

let lazyImage = entry.target;

lazyImage.src = lazyImage.dataset.src;

lazyImageObserver.unobserve(lazyImage);

}

});

});

lazy Images.forEach((lazyImage) => {

lazyImageObserver.observe(lazyImage);

});

}

});

(二)图片压缩技术大显神威

图片是 H5 的“体重”大户。抖音 H5 常用 WebP 格式,它在保证画质的同时,能将图片体积压缩到 JPEG 的一半。你可以用以下代码轻松实现图片格式转换:

function compressImage(inputImage, quality) {

return new Promise((resolve) => {

const canvas = document.createElement('canvas');

const ctx = canvas.getContext('2d');

canvas.width = inputImage.naturalWidth;

canvas.height = inputImage.naturalHeight;

ctx.drawImage(inputImage, 0, 0, canvas.width, canvas.height);

const compressedImage = new Image();

compressedImage.src = canvas.toDataURL('image/webp', quality);

compressedImage.onload = () => {

resolve(compressedImage);

};

});

}

三、交互设计:让用户欲罢不能

(一)微动画营造沉浸感

在点赞、评论等关键操作上,抖音 H5 会加入精巧的微动画。比如点赞时的爱心从手指位置飞出,这其实是一个 CSS 动画加 JavaScript 事件监听的组合拳。以下是一个简易版的点赞动画代码:

@keyframes flyHeart {

0% {

transform: scale(0) translateY(0);

opacity: 0;

}

50% {

transform: scale(1.5) translateY(-10px);

opacity: 1;

}

100% {

transform: scale(1) translateY(-20px);

opacity: 0;

}

}

.heart {

position: fixed;

width: 30px;

height: 30px;

background-image: url('../assets/heart.png');

background-size: contain;

background-repeat: no-repeat;

animation: flyHeart 1s ease-out;

}

document.querySelector('.like-btn').addEventListener('click', function(e) {

const heart = document.createElement('div');

heart.className = 'heart';

heart.style.left = e.clientX + 'px';

heart.style.top = e.clientY + 'px';

document.body.appendChild(heart);

setTimeout(() => {

heart.remove();

}, 1000);

});

(二)触摸事件优化

在移动设备上,触摸事件的响应速度直接影响用户体验。抖音 H5 通过精准控制触摸事件的捕获和冒泡阶段,减少了延迟。以下是一个优化触摸事件的示例:

const touchStartHandler = (e) => {

e.preventDefault(); // 防止页面滚动干扰

// 处理触摸开始逻辑

};

const touchMoveHandler = (e) => {

// 处理触摸移动逻辑

};

const touchEndHandler = (e) => {

// 处理触摸结束逻辑

};

const element = document.querySelector('.scrollable-container');

element.addEventListener('touchstart', touchStartHandler, { passive: false });

element.addEventListener('touchmove', touchMoveHandler, { passive: false });

element.addEventListener('touchend', touchEndHandler);

四、音频处理:让声音为 H5 增色

抖音 H5 的音频体验也很讲究。它会根据用户的操作实时调整音量,甚至在不同视频切换时平滑过渡音频。以下是一个简单的声音控制示例:

const audioContext = new (window.AudioContext || window.webkitAudioContext)();

const audioElement = document.querySelector('audio');

const audioSource = audioContext.createMediaElementSource(audioElement);

const gainNode = audioContext.createGain();

audioSource.connect(gainNode);

gainNode.connect(audioContext.destination);

// 调节音量

function setVolume(level) {

gainNode.gain.value = level;

}

// 音频淡入效果

function fadeInAudio() {

gainNode.gain.setValueAtTime(0, audioContext.currentTime);

gainNode.gain.linearRampToValueAtTime(1, audioContext.currentTime + 1);

}

// 音频淡出效果

function fadeOutAudio() {

gainNode.gain.linearRampToValueAtTime(0, audioContext.currentTime + 1);

}

五、跨浏览器兼容:让 H5 无处不在

抖音 H5 能在各种浏览器上保持一致的体验,这离不开前端开发者的兼容性优化。常用的手段包括使用 Autoprefixer 自动生成浏览器前缀、为老浏览器提供 Polyfill 等。以下是一个为 CSS 动画添加前缀的示例:

const autoprefixer = require('autoprefixer');

const postcss = require('postcss');

const css = '.example { animation: slidein 2s; } @keyframes slidein { from { transform: translateX(0); } to { transform: translateX(100px); } }';

postcss([autoprefixer]).process(css).then(result => {

console.log(result.css);

/*

输出:

.example {

animation: slidein 2s;

}

@keyframes slidein {

from {

-webkit-transform: translateX(0);

transform: translateX(0);

}

to {

-webkit-transform: translateX(100px);

transform: translateX(100px);

}

}

*/

});

打造一个像抖音一样的流畅 H5,需要前端开发者在性能优化、交互设计、音频处理和跨浏览器兼容等方面全方位发力。希望这些技术点能为你的 H5 开发之旅提供助力,让你的产品在激烈的市场竞争中脱颖而出!

来源:juejin.cn/post/7522090635908251686

做个大屏既要不留白又要不变形还要没滚动条,我直接怒斥领导,大屏适配就这四种模式

在前端开发中,大屏适配一直是个让人头疼的问题。领导总是要求大屏既要不留白,又要不变形,还要没有滚动条。这看似简单的要求,实际却压根不可能。今天,我们就来聊聊大屏适配的四种常见模式,以及如何根据实际需求选择合适的方案。

一、大屏适配的困境

在大屏项目中,适配问题几乎是每个开发者都会遇到的挑战。屏幕尺寸的多样性、设计稿与实际屏幕的比例差异,都使得适配变得复杂。而领导的“既要...又要...还要...”的要求,更是让开发者们感到无奈。不过,我们可以通过合理选择适配模式来尽量满足这些需求。

二、四种适配模式

在大屏适配中,常见的适配模式有以下四种:

(以下截图中模拟视口1200px*500px和800px*600px,设计稿为1920px*1080px)

1. 拉伸填充(fill)

- 特点:内容会被拉伸变形,以完全填充视口框。这种方式可以确保视口内没有空白区域,但可能会导致内容变形。

- 适用场景:适用于对内容变形不敏感的场景,例如全屏背景图。

2. 保持比例(contain)

- 特点:内容保持原始比例,不会被拉伸变形。如果内容的宽高比与视口不一致,会在视口内出现空白区域(黑边)。这种方式可以确保内容不变形,但可能会留白。

- 适用场景:适用于需要保持内容原始比例的场景,例如视频或图片展示。

3. 滚动显示(scroll)

- 特点:内容不会被拉伸变形,当内容超出视口时会添加滚动条。这种方式可以确保内容完整显示,但用户需要滚动才能查看全部内容。

- 适用场景:适用于内容较多且需要完整显示的场景,例如长列表或长文本。

4. 隐藏超出(hidden)

- 特点:内容不会被拉伸变形,当内容超出视口时会隐藏超出部分。这种方式可以避免滚动条的出现,但可能会隐藏部分内容。

- 适用场景:适用于内容较多但不需要完整显示的场景,例如仪表盘。

三、为什么不能同时满足所有要求?

这四种适配模式各有优缺点,但它们在逻辑上是相互矛盾的。具体来说:

- 不留白:要求内容完全填充视口,没有任何空白区域。这通常需要拉伸或缩放内容以适应视口的宽高比。

- 不变形:要求内容保持其原始宽高比,不被拉伸或压缩。这通常会导致内容无法完全填充视口,从而出现空白区域(黑边)。

- 没滚动条:要求内容完全适应视口,不能超出视口范围。这通常需要隐藏超出部分或限制内容的大小。

这三个要求在逻辑上是相互矛盾的:

- 如果内容完全填充视口(不留白),则可能会变形。

- 如果内容保持原始比例(不变形),则可能会出现空白区域(留白)。

- 如果内容超出视口范围,则需要滚动条或隐藏超出部分。

四、【fitview】插件快速实现大屏适配

fitview 是一个视口自适应的 JavaScript 插件,它支持多种适配模式,能够快速实现大屏自适应效果。

github地址:github.com/pbstar/fitv…

在线预览:pbstar.github.io/fitview

以下是它的基本使用方法:

配置

- el: 需要自适应的 DOM 元素

- fit: 自适应模式,字符串,可选值为 fill、contain(默认值)、scroll、hidden

- resize: 是否监听元素尺寸变化,布尔值,默认值 true

安装引入

npm 安装

npm install fitview

esm 引入

import fitview from "fitview";

cdn 引入

<script src="https://unpkg.com/fitview@[version]/lib/fitview.umd.js"></script>

使用示例

<div id="container">

<div style="width:1920px;height:1080px;"></div>

</div>

const container = document.getElementById("container");

new fitview({

el: container,

});

五、总结

大屏适配是一个复杂的问题,不同的项目有不同的需求。虽然不能同时满足“不留白”“不变形”和“没滚动条”这三个要求,但可以通过合理选择适配模式来尽量满足大部分需求。在实际开发中,我们需要根据项目的具体需求和用户体验来权衡,选择最合适的适配方案。

在选择适配方案时,fitview 这个插件可以提供很大的帮助。它支持多种适配模式,能够快速实现大屏自适应效果。如果你正在寻找一个简单易用的适配工具,fitview 值得一试。你可以通过 npm 安装或直接使用 CDN 引入,快速集成到你的项目中。

希望这篇文章能帮助你更好地理解和选择大屏适配方案。如果你有更多问题或建议,欢迎在评论区留言。

来源:juejin.cn/post/7513059488417497123

弃用 html2canvas!快 93 倍的截图神器!

作者:前端开发爱好者

原文:mp.weixin.qq.com/s/t0s5dCOrs…

在前端开发中,网页截图是个常用功能。从前,html2canvas 是大家的常客,但随着网页越来越复杂,它的性能问题也逐渐暴露,速度慢、占资源,用户体验不尽如人意。

好在,现在有了 SnapDOM,一款性能超棒、还原度超高的截图新秀,能完美替代 html2canvas,让截图不再是麻烦事。

什么是 SnapDOM

SnapDOM 就是一个专门用来给网页元素截图的工具。

它能把 HTML 元素快速又准确地存成各种图片格式,像 SVG、PNG、JPG、WebP 等等,还支持导出为 Canvas 元素。

它最厉害的地方在于,能把网页上的各种复杂元素,比如 CSS 样式、伪元素、Shadow DOM、内嵌字体、背景图片,甚至是动态效果的当前状态,都原原本本地截下来,跟直接看网页没啥两样。

SnapDOM 优势

快得飞起

测试数据显示,在不同场景下,SnapDOM 都把 html2canvas 和 dom-to-image 这俩老前辈远远甩在身后。

尤其在超大元素(4000×2000)截图时,速度是 html2canvas 的 93.31 倍,比 dom-to-image 快了 133.12 倍。这速度,简直就像坐火箭。

还原度超高

SnapDOM 截图出来的效果,跟在网页上看到的一模一样。

各种复杂的 CSS 样式、伪元素、Shadow DOM、内嵌字体、背景图片,还有动态效果的当前状态,都能精准还原。

无论是简单的元素,还是复杂的网页布局,它都能轻松拿捏。

格式任你选

不管你是想要矢量图 SVG,还是常用的 PNG、JPG,或者现代化的 WebP,又或者是需要进一步处理的 Canvas 元素,SnapDOM 都能满足你。

多种格式,任你挑选,适配各种需求。

怎么用 SnapDOM

安装

SnapDOM 的安装超简单,有好几种方式:

用 NPM 或 Yarn:在命令行里输

# npm

npm i @zumer/snapdom

# yarn

yarn add @zumer/snapdom

就能装好。

用 CDN 在 HTML 文件里加一行:

<script src="https://unpkg.com/@zumer/snapdom@latest/dist/snapdom.min.js"></script>

直接就能用。

要是项目里用的是 ES Module:

import { snapdom } from '@zumer/snapdom

基础用法示例

一键截图

const card = document.querySelector('.user-card');

const image = await snapdom.toPng(card);

document.body.appendChild(image);

这段代码就是找个元素,然后直接截成 PNG 图片,再把图片加到页面上。简单粗暴,一步到位。

高级配置

const element = document.querySelector('.chart-container');

const capture = await snapdom(element, {

scale: 2,

backgroundColor: '#fff',

embedFonts: true,

compress: true

});

const png = await capture.toPng();

const jpg = await capture.toJpg({ quality: 0.9 });

await capture.download({

format: 'png',

filename: 'chart-report-2024'

});

这儿可以对截图进行各种配置。比如 scale 能调整清晰度,backgroundColor 能设置背景色,embedFonts 可以内嵌字体,compress 能压缩优化。配置好后,还能把截图存成不同格式,或者直接下载到本地。

和其他库比咋样

和 html2canvas、dom-to-image 比起来,SnapDOM 的优势很明显:

| 特性 | SnapDOM | html2canvas | dom-to-image |

|---|---|---|---|

| 性能 | ⭐⭐⭐⭐⭐ | ⭐⭐ | ⭐ |

| 准确度 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐ |

| 文件大小 | 极小 | 较大 | 中等 |

| 依赖 | 无 | 无 | 无 |

| SVG 支持 | ✅ | ❌ | ✅ |

| Shadow DOM 支持 | ✅ | ❌ | ❌ |

| 维护状态 | 活跃 | 活跃 | 停滞 |

用的时候注意点

用 SnapDOM 时,有几点得注意:

跨域资源

要是截图里有外部图片等跨域资源,得确保这些资源支持 CORS,不然截不出来。

iframe 限制

SnapDOM 不能截 iframe 内容,这是浏览器的安全限制,没办法。

Safari 浏览器兼容性

在 Safari 里用 WebP 格式时,会自动变成 PNG。

大型页面截图

截超大页面时,建议分块截,不然可能会内存溢出。

SnapDOM 能干啥及代码示例

社交分享

async function shareAchievement() {

const card = document.querySelector('.achievement-card');

const image = await snapdom.toPng(card, { scale: 2 });

navigator.share({

files: [new File([await snapdom.toBlob(card)], 'achievement.png')],

title: '我获得了新成就!'

});

}

报表导出

async function exportReport() {

const reportSection = document.querySelector('.report-section');

await preCache(reportSection);

await snapdom.download(reportSection, {

format: 'png',

scale: 2,

filename: `report-${new Date().toISOString().split('T')[0]}`

});

}

海报导出

async function generatePoster(productData) {

document.querySelector('.poster-title').textContent = productData.name;

document.querySelector('.poster-price').textContent = `¥${productData.price}`;

document.querySelector('.poster-image').src = productData.image;

await new Promise((resolve) => setTimeout(resolve, 100));

const poster = document.querySelector('.poster-container');

const blob = await snapdom.toBlob(poster, { scale: 3 });

return blob;

}

写在最后

SnapDOM 就是这么一款简单、快速、准确,还零依赖的网页截图神器。

无论是社交分享、报表导出、设计保存,还是营销推广,它都能轻松搞定。

而且它是免费开源的,背后还有活跃的社区支持。要是你还在为网页截图的事儿发愁,赶紧试试 SnapDOM 吧。

要是你在用 SnapDOM 的过程中有啥疑问,或者碰上啥问题,可以去下面这些地方找答案:

- 项目地址 :github.com/zumerlab/sn…

- 在线演示 :zumerlab.github.io/snapdom/

- 详细文档 :github.com/zumerlab/sn…

来源:juejin.cn/post/7524740743165722634

别再用 100vh 了!移动端视口高度的终极解决方案

作为一名前端开发者,我们一定都遇到过这样的需求:实现一个占满整个屏幕的欢迎页、弹窗蒙层或者一个 fixed 定位的底部菜单。

直觉告诉我们,这很简单,给它一个 height: 100vh 就行了。

.fullscreen-element {

height: 100vh;

width: 100%;

color: #000;

display: flex;

justify-content: center;

align-items: center;

font-size: 10em;

background-color: #fff;

}

在PC端预览,完美!然而,当你在手机上打开时,可能会看到下面这个令人抓狂的场景:

明明是 100vh,为什么会超出屏幕高度?这个烦人的滚动条到底从何而来?

如果你也曾为此抓耳挠腮,那么恭喜你,这篇文章就是你的“终极答案”。今天,我将带你彻底搞懂 100vh 在移动端的“坑”,并为你介绍当下最完美的解决方案。

1. 问题根源:移动端动态变化的“视口”

要理解问题的本质,我们首先要明白 vh (Viewport Height) 单位的定义:1vh 等于视口高度的 1%。

在PC端,浏览器窗口大小是相对固定的,所以 100vh 就是浏览器窗口的可见高度,这没有问题。

但在移动端,情况变得复杂了。为了在有限的屏幕空间里提供更好的浏览体验,手机浏览器(尤其是Safari和Chrome)的地址栏和底部工具栏是动态变化的。

- 初始状态:当你刚进入页面时,地址栏和工具栏是完全显示的。

- 滚动时:当你向下滚动页面,这些UI元素会自动收缩,甚至隐藏,以腾出更多空间展示网页内容。

关键点来了:大多数移动端浏览器将 100vh 定义为“最大视口高度”,也就是当地址栏和工具栏完全收起时的高度。

这就导致了:

在页面初始加载、地址栏还未收起时,

100vh的实际计算高度 > 屏幕当前可见区域的高度。

于是,那个恼人的滚动条就出现了。

2. “过去式”的解决方案:JavaScript 动态计算

在很长一段时间里,前端开发者们只能求助于 JavaScript 来解决这个问题。思路很简单:通过 window.innerHeight 获取当前可见视口的高度,然后用它来动态设置元素的 height。

JavaScript

function setRealVH() {

const vh = window.innerHeight * 0.01;

document.documentElement.style.setProperty('--vh', `${vh}px`);

}

// 初始加载时设置

window.addEventListener('load', setRealVH);

// 窗口大小改变或旋转屏幕时重新设置

window.addEventListener('resize', setRealVH);

然后在 CSS 中这样使用:

CSS

.fullscreen-element {

height: calc(var(--vh, 1vh) * 100);

}

这个方案的缺点显而易见:

- 性能开销:监听

resize事件过于频繁,可能会引发性能问题。 - 逻辑耦合:纯粹的样式问题却需要JS来解决,不够优雅。

- 时机问题:执行时机需要精确控制,否则可能出现闪烁。

虽然能解决问题,但这绝不是我们想要的“终极方案”。

3. “现在时”的终极解决方案:CSS动态视口单位

谢天谢地,CSS 工作组听到了我们的呼声!为了解决这个老大难问题,CSS Values and Units Module Level 4 引入了一套全新的动态视口单位。

它们就是我们今天的“主角”:

svh(Small Viewport Height): 最小视口高度。对应于地址栏和工具栏完全展开时的可见高度。lvh(Large Viewport Height): 最大视口高度。对应于地址栏和工具栏完全收起时的高度(这其实就等同于旧的100vh)。dvh(Dynamic Viewport Height): 动态视口高度。这是最智能、最实用的单位!它的值会随着浏览器UI元素(地址栏)的出现和消失而动态改变。

所以,我们的终极解决方案就是:

CSS

.fullscreen-element {

height: 100svh; /* 如果你希望高度固定,且永远不被遮挡 */

/* 或者,也是我最推荐的 */

height: 100dvh; /* 如果你希望元素能动态地撑满整个可见区域 */

}

使用 100dvh,当地址栏收起时,元素高度会平滑地增加以填满屏幕;当地址栏滑出时,元素高度又会平滑地减小。整个过程如丝般顺滑,没有任何滚动条,完美!

浏览器兼容性

你可能会担心兼容性问题。好消息是,从2023年开始,所有主流现代浏览器(Safari, Chrome, Edge, Firefox)都已经支持了这些新的视口单位。

(数据截至2025年6月,兼容性已非常好)

可以看到,兼容性已经非常理想。除非你需要支持非常古老的浏览器版本,否则完全可以放心地在生产环境中使用。

告别 100vh 的时代

让我们来快速回顾一下:

- 问题:在移动端,

100vh通常被解析为“最大视口高度”,导致在浏览器UI未收起时内容溢出。 - 旧方案:使用 JavaScript 的

window.innerHeight动态计算,但有性能和维护问题。 - 终极方案:使用CSS新的动态视口单位,尤其是

100dvh,它能根据浏览器UI的变化自动调整高度,完美解决问题。

当需要实现移动端全屏布局时,请大胆地告别 100vh,拥抱 100dvh!

来源:juejin.cn/post/7520548278338322483

为什么响应性语法糖最终被废弃了?尤雨溪也曾经试图让你不用写 .value

你将永远需要在 Vue3 中写

.value

前言

相信有不少新手在初次接触 Vue3 的组合式 API 时都会产生一个疑问:”为什么一定要写 .value ?",一些 Vue3 老玩家也认为到处写 .value 十分不优雅。

那么有没有办法能不用写 .value 呢?有的兄弟,至少曾经有的,那就是响应性语法糖,可惜在 Vue 3.4 之后已经被移除了。

响应性语法糖是如何实现免去 .value 的?这一特性为何最终被废弃了呢?

响应性语法糖

Vue 的响应性语法糖是一个编译时的转换步骤,让我们可以像这样书写代码:

<script setup>

let count = $ref(0)

console.log(count)

function increment() {

count++

}

</script>

<template>

<button @click="increment">{{ count }}</button>

</template>

这里的 $ref() 方法是一个编译时的宏命令:它不是一个真实的、在运行时会调用的方法,而是用作 Vue 编译器的标记。使用 $ref() 声明的响应式变量可以直接读取与修改,无需 .value。

上面例子中 <script> 部分的代码会被编译成下面这样,在代码中自动加上 .value:

import { ref } from 'vue'

let count = ref(0)

console.log(count.value)

function increment() {

count.value++

}

每一个会返回 ref 的响应式 API 都有一个相对应的、以 $ 为前缀的宏函数。包括以下这些 API:

ref->$refcomputed->$computedshallowRef->$shallowRefcustomRef->$customReftoRef->$toRef

通过 $() 解构

当一个组合式函数返回包含数个 ref 的对象,我们希望解构得到这些 ref,并且在后续使用它们时也不用写 .value 时,可以使用 $() 这个宏:

import { useMouse } from '@vueuse/core'

const { x, y } = $(useMouse())

// x,y 和用 $ref 声明的响应式变量一样,不用写 .value

console.log(x, y)

通过 $$() 防止响应性丢失

假设有一个期望接收一个 ref 对象为参数的函数:

function trackChange(x: Ref<number>) {

watch(x, (x) => {

console.log('x 改变了!')

})

}

let count = $ref(0)

trackChange(count) // 无效!

上面的例子不会正常工作,因为代码被编译成了这样子:

let count = ref(0)

trackChange(count.value)

trackChange 函数期望接收的参数是一个 ref 类型值,而我们传入的 count.value 实际是一个 number 类型。

对于一个使用 $ref() 声明的响应式变量,当我们希望获取到它的原始 ref 值时,可以使用 $$()。

我们将上述例子改写为:

let count = $ref(0)

- trackChange(count)

+ trackChange($$(count))

此时代码可以正常工作,不会再丢失响应性了。

看到这里,聪明的你可能已经意识到了问题:使用响应性语法糖的初衷是为了免去到处写

.value的麻烦,结果现在新引入了$ref()、$()、$(),各自还有不同的使用场景,不是更麻烦了吗?

废弃原因

最终,在收集了大量来自社区的反馈后,经过 Vue 核心团队全员投票,决定移除这一特性。在 Vue 3.3 版本中使用会报 warning,从 3.4 版本开始正式移除。

尤雨溪本人也在 github 上发表了决定将响应性语法糖移除的根本原因,链接:github.com/vuejs/rfcs/…

原文是英语,担心有小伙伴可能看不懂,在这里简单翻译一下:

响应性语法糖的初衷是提供一些简练的语法提升开发体验。我们将它作为实验特性发布并在真实场景的使用中获得反馈。尽管它有一些好处,但我们还是发现了下列问题:

- 没有

.value使得难以辨认响应式变量的读取和设置。这个问题在 SFC 中可能不那么明显,但是在大型项目中会造成心智负担的明显增大,尤其是在 SFC 外也使用此语法时。

- 因为第一条,一些开发者倾向于只在 SFC 中使用响应性语法糖,这就造成了代码的不一致性以及在不同心智模型间切换的成本。这是一个进退两难的窘境:只在 SFC 中使用会造成不一致性,而在 SFC 之外使用则会降低可维护性。

- 既然总有外部函数会使用原始 ref,那么在响应性语法糖与原始 ref 之间的转换是不可避免的。这就产生了另一个需要学习的东西以及额外的认知负担,并且我们发现这会比纯粹的组合式 API 更让初学者感到困惑。

最重要的是,响应性语法糖会带来代码风格分裂的潜在危险。尽管这一功能是自愿使用的,一些使用者还是强烈反对该提议,因为他们不想维护用了语法糖和没用两种风格的代码。这确实值得担心因为使用响应性语法糖需要的心智模型违背了 JavaScript 的基本语义(对变量赋值会触发响应式副作用)。

在考虑了所有因素之后,我们认为将它发布为一个稳定功能带来的问题会大于收益。

结语

在 Vue3 发布之初,Vue 核心团队就考虑到了 ref 需要到处使用 .value 的繁琐,推出了响应性语法糖试图解决这一问题。

响应性语法糖提供了一系列编译器宏,让开发者在书写代码时不必使用 .value,而是在编译阶段由编译器自动加上。

最终,出于代码风格一致性和可维护性上的考量,这一特性最终在 Vue 3.4 版本被正式废弃。

来源:juejin.cn/post/7523231174620102671

为什么 Go 语言非常适合开发 AI Agent

原文:Alexander Belanger - 2025.06.03

如同地球上几乎所有人一样,过去的几个月里,我们也一直在关注着 Agent 的发展。

特别值得一提的是,我们观察到 Agent 的采用推动了我们编排平台的增长,这让我们对哪些技术栈和框架——或者干脆没有框架——在此领域表现良好有了一些见解。

我们看到的一个更有趣的现象是混合技术栈的激增:一个典型的 Next.js 或 FastAPI 后端,搭配着一个用 Go 语言编写的 Agent,甚至在非常早期阶段就如此。

作为一名长期的 Go 语言开发者,这着实令人兴奋;下面我将解释为何我认为这将成为未来更普遍的做法。

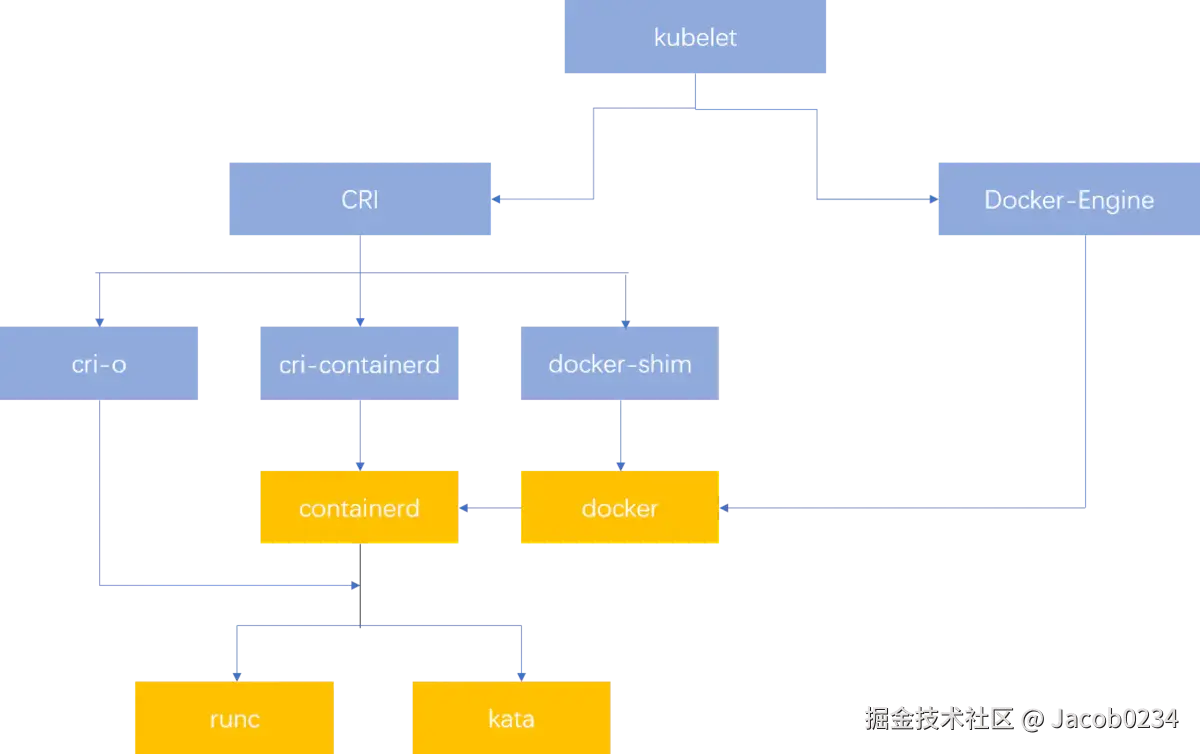

什么是 Agent?

这里的术语有些混乱,但通常我指的是一个在循环中执行的进程,该进程对其执行路径中的下一步操作拥有一定的自主权。这与预定义的执行路径(例如定义为有向无环图的一组步骤,我们称之为工作流)形成对比。Agent 通常包含一个基于最大深度或满足某个条件(如“测试通过”)的退出条件。

当 Agent 开始规模化(即:拥有实际用户)时,它们通常具有一些共同特征:

- 它们是长时间运行的——从几秒到几分钟甚至几小时不等。

- 每次执行的成本都很高——不仅仅是 LLM 调用的成本,Agent 的本质是取代通常需要人工操作员完成的任务。开发环境、浏览器基础设施、大型文档处理——这些都花费 $$$ 钱的。

- 在它们的执行周期中,经常需要在某个时刻接收用户(或另一个 Agent!)的输入。

- 它们花费大量时间等待 I/O 或人类输入。

让我们将这一系列特征转化为对运行时的要求。为了限定问题范围,假设我们正在处理一个在远程执行的 Agent,而非在用户本地机器上(尽管 Go 对于分发本地 Agent 也是一个绝佳选择)。在远程执行的情况下,为每次 Agent 执行运行一个单独的容器成本会高得惊人。因此,在大多数情况下(尤其是当我们的 Agent 主要是简单的 I/O 和 LLM 调用时),我们最终会得到大量并发运行的轻量级进程。每个进程可以处于特定状态(例如,“搜索文件中”、“生成代码中”、“测试中”)。请注意,不同 Agent 执行的状态顺序可能并不相同。

这种包含许多并发、长时间运行进程的系统,与大约十年前的传统 Web 架构截然不同。在传统架构中,对服务器的请求处理速度要快得多,使用一些缓存、高效的处理程序和 OLTP 数据库就能高效地服务数千名日活用户。

事实证明,这种架构转变非常适合 Go 语言的并发模型、依赖通道(channel)进行通信、集中的取消机制以及围绕 I/O 构建的工具链。

高并发性

让我们从最明显的一点开始——Go 拥有极其简单且强大的并发模型。创建一个新的 goroutine 所需的内存和时间成本非常低,因为每个 goroutine 只有 2KB 的预分配内存。

这实际上意味着你可以同时运行许多 goroutine 而开销很小,并且它们在底层运行在多个操作系统线程上,能够利用服务器中的所有 CPU 核心。这一点非常重要,因为如果你碰巧在某个 goroutine 中执行非常消耗 CPU 的操作(比如反序列化一个大型 JSON 结构),其影响会比你使用单线程运行时(如 Node.js)要小(在 Node.js 中,你需要为阻塞线程的操作创建 worker 线程或子进程),或者比使用 Python 的 async/await 也要好。

这对于 Agent 意味着什么?因为 Agent 的运行时间比典型的 Web 请求长得多,所以并发性就成为了一个更关键的问题。在 Go 中,相比于在 Python 中为每个 Agent 运行一个线程,或者在 Node.js 中为每个 Agent 运行一个 async 函数,你受到为每个 Agent 生成一个 goroutine 的限制要小得多。再加上较低的基础内存占用和编译成单一二进制文件的特点,在轻量级基础设施上同时运行数千个并发 Agent 执行变得异常简单。

通过通信共享内存

对于那些不了解的人,Go 语言有一个常见的习语:不要通过共享内存来通信;相反,通过通信来共享内存。

在实践中,这意味着不需要尝试跨多个并发进程同步内存内容(这是使用类似 Python 的 multithreading 库时的常见问题),每个进程可以通过在通道(channel)上获取和释放对象来获得该对象的所有权。这样做的效果是,每个进程只在拥有对象所有权时关心该对象的本地状态,而其他时候不需要协调所有权——无需互斥锁(mutex)!

老实说——在我编写过的大多数 Go 程序中,我使用等待组(wait groups)和互斥锁(mutexes)的次数往往比使用通道(channels)更多,因为这样通常更简单(这也符合 Go 社区的建议),并且只有一个地方需要并发访问数据。

但是,在建模 Agent 时,这种范式非常有用,因为 Agent 通常需要异步响应用户或其他 Agent 发来的消息,并且将应用程序实例视为一个 Agent 池来思考是很有帮助的。

为了更具体说明,让我们编写一些示例代码来表示 Agent 循环的核心逻辑:

// 注意:在真实世界的例子中,我们需要一种机制来优雅地

// 关闭循环并防止通道关闭;

// 这是一个简化示例。

func Agent(in <-chan Message, out chan<- Output, status chan<- State) {

internal := make(chan Message, 10) // 内部缓冲区大小为 10 的通道

for {

select {

case msg := <-internal: // 从内部通道读取消息

processMessage(msg, internal, out, status)

case msg := <-in: // 从外部输入通道读取消息

processMessage(msg, internal, out, status)

}

}

}

func processMessage(msg Message, internal chan<- Message, out chan<- Output, status chan<- State) {

result := execute(msg) // 执行消息处理

status <- State{msg.sessionId, result.status} // 发送状态更新

if next := result.next(); next != nil { // 获取下一步消息(如果有)

internal <- next // 将下一步消息发送到内部通道

}

out <- result // 发送处理结果

}

(请注意,<-chan 表示接收者只能从通道读取,而 chan<- 表示接收者只能向通道写入。)

这个 Agent 是一个长时间运行的进程,它等待消息到达 in 通道,处理消息,然后异步地将结果发送到 out 通道。status 通道用于发送关于 Agent 状态的更新,这对于监控或向用户发送增量结果很有用;而 internal 通道用于处理 Agent 的内部循环。例如,内部循环可以实现下图中的“直到测试通过”循环:

尽管我们使用 for 循环来运行 Agent,但该 Agent 的实例在消息之间不需要维护任何内部状态。它本质上是一个无状态归约器,其决策执行路径的下一步操作不依赖于某些内部状态。重要的是,这意味着任何 Agent 实例都能够处理下一条消息。这也允许 Agent 在消息之间使用持久化边界,例如将消息写入数据库或消息队列。

使用 context.Context 的集中取消机制

还记得 Agent 执行成本很高吗?假设一个用户触发了一个价值 10 美元的执行任务,但突然改变主意并点击“停止生成”——为了节省成本,你希望取消这次执行。

事实证明,在 Node.js 和 Python 中取消长时间运行的工作极其困难,原因有很多:

- 库之间缺乏统一的取消机制——虽然两种语言都支持中止信号(AbortSignal)和控制器(Controller),但这并不能保证你调用的第三方库会尊重这些信号。

- 如果信号取消失败,强行终止线程是个痛苦的过程,并可能导致线程泄漏或资源损坏。

幸运的是,Go 采用 context.Context 使得取消工作变得轻而易举,因为绝大多数库都预期并尊重这种模式。即使某些库不支持:由于 Go 只有一种并发模型,因此有像 goleak 这样的工具,可以更容易地检测出泄漏的 goroutine 和有问题的库。

丰富的标准库

当你开始使用 Go 时,你会立即注意到 Go 的标准库非常丰富且质量很高。它的许多部分也是为 Web I/O 构建的——比如 net/http、encoding/json 和 crypto/tls——这些对于 Agent 的核心逻辑非常有用。

Go 还有一个隐含的假设:所有 I/O 在 goroutine 内部都是阻塞的——再次强调,因为 Go 只有一种方式运行并发工作——这鼓励你将业务逻辑的核心编写为直线式程序。你不需要担心用 await 包装每个函数调用来将执行推迟给调度器。

与 Python 对比:库开发者需要考虑 asyncio、多线程(multithreading)、多进程(multiprocessing)、eventlet、gevent 以及其他一些模式,几乎不可能同等地支持所有并发模型。因此,如果你用 Python 编写 Agent,你需要研究每个库对你所采用的并发模型的支持情况,并且如果你的第三方库不完全支持你想要的模式,你可能需要采用多种模式。

(Node.js 的情况要好得多,尽管 Bun 和 Deno 等其他运行时的加入增加了一些不兼容的层面。)

性能剖析(Profiling)

由于其有状态性(statefulness)和大量长时间运行的进程,Agent 似乎特别容易出现内存泄漏和线程泄漏。Go 在 runtime/pprof 中提供了出色的工具,可以使用堆(heap)和分配(alloc)配置文件找出内存泄漏的来源,或者使用 goroutine 配置文件找出 goroutine 泄漏的来源。

额外优势:LLM 擅长编写 Go 代码

由于 Go 语法非常简单(一个常见的批评是 Go 有点“啰嗦”)并且拥有丰富的标准库,LLM 非常擅长编写符合 Go 语言习惯的代码。我发现它们在编写表格测试(table tests)方面尤其出色,这是 Go 代码库中的一种常见模式。

Go 工程师也往往反对框架(anti-framework),这意味着 LLM 不需要跟踪你使用的是哪个框架(或框架的哪个版本)。

不足之处

尽管有以上诸多好处,仍然有很多理由让你可能不会选择 Go 来开发你的 Agent:

- 第三方库支持仍然落后于 Python 和 Typescript。

- 使用 Go 进行任何涉及真正机器学习(real machine learning)的工作几乎是不可能的。

- 如果你追求最佳性能,那么有比 Go 更好的语言,如 Rust 和 C++。

- 你特立独行,不喜欢(显式)处理错误。

来源:juejin.cn/post/7514621534339055631

纯前端用 TensorFlow.js 实现智能图像处理应用(一)

随着人工智能技术的不断发展,图像处理应用已经在医疗影像分析、自动驾驶、视频监控等领域得到广泛应用。TensorFlow.js 是 Google 开源的机器学习库 TensorFlow 的 JavaScript 版本,能够让开发者在浏览器中运行机器学习模型,在前端应用中轻松实现图像分类、物体检测和姿态估计等功能。本文将介绍如何使用 TensorFlow.js 在纯前端环境中实现这三项任务,并帮助你构建一个智能图像处理应用。

什么是 TensorFlow.js?

TensorFlow.js 是一个能够让开发者在前端直接运行机器学习模型的 JavaScript 库。它允许你无需将数据发送到服务器,便可以在浏览器中运行模型进行推理,这不仅减少了延迟,还可以更好地保护用户的隐私数据。通过 TensorFlow.js,前端开发者能够轻松实现图像分类、物体检测和姿态估计等功能。

TensorFlow.js 的应用非常广泛,尤其是在一些实时交互和隐私敏感的场景下,例如 医疗影像分析、自动驾驶 和 智能监控。在这些领域,前端模型推理能够提升响应速度,并且避免将用户的数据上传到服务器,从而保护用户的隐私。

要开始使用 TensorFlow.js,你需要安装相关的模型库。以下是你需要安装的 npm 包:

npm install @tensorflow/tfjs

npm install @tensorflow-models/mobilenet

npm install @tensorflow-models/coco-ssd

npm install @tensorflow-models/posenet

加载预训练模型

在 TensorFlow.js 中,加载预训练模型非常简单。首先,确保 TensorFlow.js 已经准备好,然后加载所需的模型进行推理。

// 导入

import * as tf from '@tensorflow/tfjs'

// 加载

tf.ready(); // 确保 TensorFlow.js 准备好

用户上传图片

为了使用这些模型进行推理,我们需要让用户上传一张图片。以下是一个处理图片上传的代码示例:

const handleImageUpload = async (event) => {

const file = event.target.files[0]

if (file) {

const reader = new FileReader()

reader.onload = async (e) => {

imageSrc.value = e.target.result

await runModels(e.target.result)

}

reader.readAsDataURL(file)

}

}

图像分类:识别图片中的物体

图像分类是计算机视觉中的基本任务,目的是将输入图像归类到某个类别中。例如,我们可以用图像分类模型识别图像中的“猫”还是“狗”。

使用预训练模型进行图像分类

TensorFlow.js 提供了多个预训练模型,MobileNet 是其中一个常用的图像分类模型。它是一个轻量级的卷积神经网络,适合用来进行图像分类。接下来,我们通过 MobileNet 实现一个图像分类功能:

const mobilenetModel = await mobilenet.load()

const predictions = await mobilenetModel.classify(image)

classification.value = `分类结果: ${predictions[0].className}, 信心度: ${predictions[0].probability.toFixed(3)}`

这段代码实现了图像分类。我们加载 MobileNet 模型,并对用户上传的图像进行推理,最后返回图像的分类结果。

物体检测:找出图像中的所有物体

物体检测不仅仅是识别图像中的物体是什么,还需要标出它们的位置,通常用矩形框来框住物体。Coco-SSD 是一个强大的物体检测模型,能够在图像中检测出多个物体并标出它们的位置。

使用 Coco-SSD 进行物体检测

const cocoModel = await cocoSsd.load();

const detectionResults = await cocoModel.detect(image);

objects.value = detectionResults.map((prediction) => ({

class: prediction.class,

bbox: prediction.bbox,

}));

通过 Coco-SSD 模型,我们可以检测图像中的多个物体,并标出它们的位置。

绘制物体的边界框

为了更直观地展示检测结果,我们可以在图像上绘制出物体的边界框:

// 绘制物体检测边界框

const drawObjects = (detectionResults, image) => {

nextTick(() => {

const ctx = objectCanvas.value.getContext('2d')

const imageWidth = image.width

const imageHeight = image.height

objectCanvas.value.width = imageWidth

objectCanvas.value.height = imageHeight

ctx.clearRect(0, 0, objectCanvas.value.width, objectCanvas.value.height)

ctx.drawImage(image, 0, 0, objectCanvas.value.width, objectCanvas.value.height)

// 绘制边界框

detectionResults.forEach((prediction) => {

const [x, y, width, height] = prediction.bbox

ctx.beginPath()

ctx.rect(x, y, width, height)

ctx.lineWidth = 2

ctx.strokeStyle = 'green'

ctx.stroke()

// 添加标签

ctx.font = '16px Arial'

ctx.fillStyle = 'green'

ctx.fillText(prediction.class, x + 5, y + 20)

})

})

}

这段代码通过绘制边界框来标出检测到的物体位置,同时在边界框旁边显示物体类别。

姿态估计:识别人体的关键点

姿态估计主要是识别人类的身体部位,例如头部、手臂、腿部等。通过这些关键点,我们可以了解一个人当前的姿势。TensorFlow.js 提供了 PoseNet 模型来进行姿态估计。

使用 PoseNet 进行姿态估计

// 加载 PoseNet 模型

const posenetModel = await posenet.load()

const poseResult = await posenetModel.estimateSinglePose(image, {

flipHorizontal: false

})

// 人体关键点

pose.value = poseResult.keypoints.map((point) => `${point.part}: (${point.position.x.toFixed(2)}, ${point.position.y.toFixed(2)})`)

PoseNet 模型会估计图像中人物的关键点,并返回每个关键点的位置。

绘制姿态估计骨架图

const drawPose = (keypoints, image) => {

nextTick(() => {

const ctx = canvas.value.getContext('2d')

const imageWidth = image.width

const imageHeight = image.height

canvas.value.width = imageWidth

canvas.value.height = imageHeight

ctx.clearRect(0, 0, canvas.value.width, canvas.value.height)

// 绘制图像

ctx.drawImage(image, 0, 0, canvas.value.width, canvas.value.height)

const scaleX = canvas.value.width / image.width

const scaleY = canvas.value.height / image.height

// 绘制关键点并标记名称

keypoints.forEach((point) => {

const { x, y } = point.position

const scaledX = x * scaleX

const scaledY = y * scaleY

ctx.beginPath()

ctx.arc(scaledX, scaledY, 5, 0, 2 * Math.PI)

ctx.fillStyle = 'red'

ctx.fill()

// 标记点的名称

ctx.font = '12px Arial'

ctx.fillStyle = 'blue'

ctx.fillText(point.part, scaledX + 8, scaledY)

})

// 连接骨架

const poseConnections = [

['leftShoulder', 'rightShoulder'],

['leftShoulder', 'leftElbow'],

['leftElbow', 'leftWrist'],

['rightShoulder', 'rightElbow'],

['rightElbow', 'rightWrist'],

['leftHip', 'rightHip'],

['leftShoulder', 'leftHip'],

['rightShoulder', 'rightHip'],

['leftHip', 'leftKnee'],

['leftKnee', 'leftAnkle'],

['rightHip', 'rightKnee'],

['rightKnee', 'rightAnkle'],

['leftEye', 'rightEye'],

['leftEar', 'leftShoulder'],

['rightEar', 'rightShoulder']

]

poseConnections.forEach(([partA, partB]) => {

const keypointA = keypoints.find((point) => point.part === partA)

const keypointB = keypoints.find((point) => point.part === partB)

if (keypointA && keypointB && keypointA.score > 0.5 && keypointB.score > 0.5) {

const scaledX1 = keypointA.position.x * scaleX

const scaledY1 = keypointA.position.y * scaleY

const scaledX2 = keypointB.position.x * scaleX

const scaledY2 = keypointB.position.y * scaleY

ctx.beginPath()

ctx.moveTo(scaledX1, scaledY1)

ctx.lineTo(scaledX2, scaledY2)

ctx.lineWidth = 2

ctx.strokeStyle = 'blue'

ctx.stroke()

}

})

})

}

这段代码通过 PoseNet 返回的人体关键点信息,绘制人体姿态的骨架图,帮助用户理解图像中的人物姿势。

总结

通过 TensorFlow.js,我们可以轻松地将图像分类、物体检测和姿态估计等功能集成到前端应用中,无需依赖后端计算,提升了应用的响应速度并保护了用户隐私。在本文中,我们介绍了如何使用 MobileNet、Coco-SSD 和 PoseNet 等预训练模型,在前端实现智能图像处理应用。无论是开发图像识别应用还是增强现实应用,TensorFlow.js 都是一个强大的工具,值得前端开发者深入学习和使用。

来源:juejin.cn/post/7437392938441687049

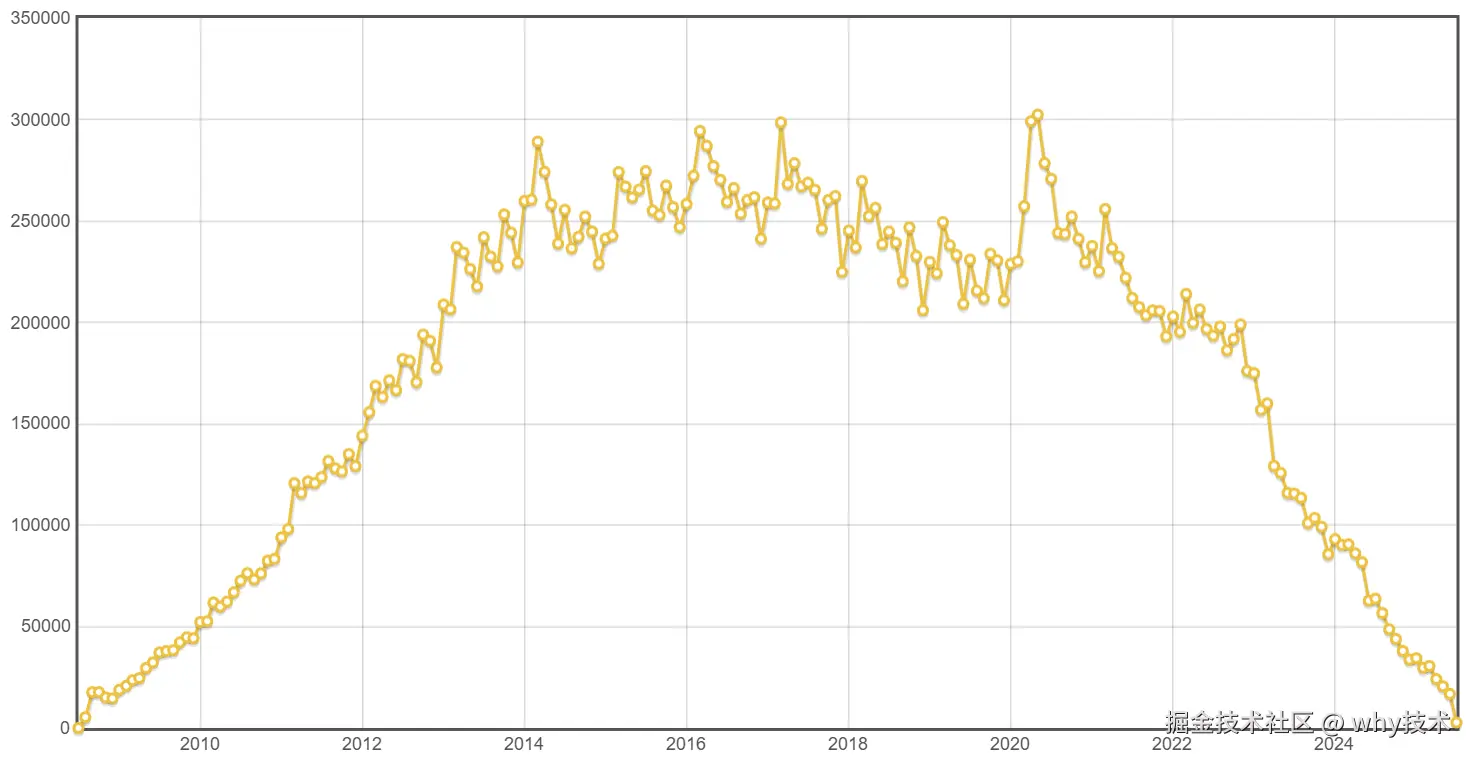

AI独角兽团队Manus裁员80人,剩下40人迁至新加坡总部!

大家好,我是程序员小灰。

大家是否还记得,今年3月份横空出世的AI产品Manus?

Manus号称是全球首款通用Agent的产品,它刚刚上线的时候在AI圈子里红极一时,许多人都在争抢Manus的内测激活码,这些内测码甚至在闲鱼平台被炒到了10万元!

小灰一直没有机会真正使用Manus,但我看过许多网友的演示视频,虽然这款Agent产品没有发布会上说的那么神奇,存在种种瑕疵,但是在某种程度上确实可以帮助人们解决一些流程化的工作。

在当时,Manus不止在国内受到追捧,也受到了全世界的关注。在4月25日,Manus母公司蝴蝶效应获得了美国风险投资公司Benchmark领投的7500万美元融资。

包括小灰在内的许多同行都认为,Manus一定会在资本的加持下继续做大做强,成为中国甚至全世界的AI Agent领军人。

可是万万没想到,在7月8日这一天,Manus团队被爆出了裁员消息。Manus在中国区大约有120名员工,其中40多位核心员工被迁往新加坡总部,剩下80人左右将被裁员,补偿方案是N+3或者2N。

仅仅4个月的时间,Manus就从刚刚诞生时候的辉煌走到了如今的局面,难怪圈子里都在说:AI一天,人间十年。

那么,Manus为什么会面临裁员呢?主要有三个原因:

1.政策影响

2025年1月生效的《对外投资安全计划》限制美元基金对中国AI企业的投资,Manus的主要投资方Benchmark在审查压力下,被迫要求Manus迁出中国。

2.芯片断供

从去年开始,美国商务部就禁止向中国大陆客户供应AI芯片,到了今年年初,禁令执行越来越严格,这对Manus的打击是致命的。Manus研发负责人也在内部会议中坦承,因无法及时获取英伟达最新AI芯片,智能体的迭代升级进度被迫延缓。

3.成本问题

Manus从今年3月底开始向用户收费,基础版每月39美元,高级版每月199美元。相比于国内很多物美价廉的AI产品,Manus收费真的很贵。

但是从Manus官方的角度,他们的运营成本也确实很高,目前的收费根本无法覆盖运营成本。再加上国内又诞生了扣子空间这样的平替产品,导致Manus用户增长乏力,无法形成规模效应。

Manus如今的结局是令人遗憾的,但是像DeepSeek和Manus这样了不起的产品,也让全世界看到了中国AI的希望。

小灰相信,中国AI行业的未来发展只会越发迅猛,今后一定会有越来越多优秀的AI产品走进大众的视野,让全世界的人们看到我们中国人的智慧和努力。

大家对Manus裁员和迁移新加坡这件事怎么看?欢迎在留言区说出你的想法。

来源:juejin.cn/post/7524931208746975270

我为什么放弃了“大厂梦”,去了一家“小公司”?

我,前端八年。我的履历上,没有那些能让HR眼前一亮的名字,比如字节、阿里,国内那些头部的互联网公司。

“每个程序员都有一个大厂梦”,这句话我听了八年。说实话,我也有过,而且非常强烈。

刚毕业那几年,我把进大厂当作唯一的目标。我刷过算法题,背过“八股文”,也曾一次次地在面试中被刷下来。那种“求之不得”的滋味,相信很多人都体会过。

但今天,我想聊的是,我是如何从一开始的“执念”,到后来的“审视”,再到现在的“坦然”,并最终心甘情愿地在一家小公司里,找到了属于我自己的价值。

这是一个普通的、三十多岁的工程师,与自己和解的经历。

那段“求之不得”的日子

我还记得大概四五年前,是我冲击大厂最疯狂的时候。

市面上所有关于React底层原理、V8引擎、事件循环的面经,我都能倒背如流。我把LeetCode热题前100道刷了两遍,看到“数组”、“链表”这些词,脑子里就能自动冒出“双指针”、“哈希表”这些解法。

我信心满满地投简历,然后参加了一轮又一轮的面试。

结果呢?大部分都是在三轮、四轮之后,收到一句“感谢您的参与,我们后续会保持联系”。我一次次地复盘,是我哪里没答好?是项目经验不够亮眼?还是算法题的最优解没写出来?

那种感觉很糟糕。你会陷入一种深深的自我怀疑,觉得自己的能力是不是有问题,是不是自己“不配”进入那个“高手如云”的世界。

开始问自己:“大厂”真的是唯一的出路吗?

在经历了一段密集而失败的面试后,我累了,也开始冷静下来思考。

我观察身边那些成功进入大厂的朋友。他们确实有很高的薪水和很好的福利,但他们也常常在半夜的朋友圈里,吐槽着无休止的会议、复杂的流程、以及自己只是庞大系统里一颗“螺丝钉”的无力感。

我看到他们为了一个需求,要跟七八个不同部门的人“对齐”;看到他们写的代码,90%都是在维护内部庞大而陈旧的系统;看到他们即使想做一个小小的技术改进,也要经过层层审批。

我突然问自己:这真的是我想要的生活吗?我想要的是什么?

当我把这些想清楚之后,我发现,大厂的光环,对我来说,好像没那么耀眼了。

在“小公司”,找到了意想不到的“宝藏”

后来,我加入了一家规模不大的科技公司。在这里,我确实找到了我想要的东西。

成了一个“产品工程师”,而不仅仅是“前端工程师”

在小公司,边界是模糊的。

我不仅要写前端代码,有时候也得用Node.js写一点中间层。我需要自己去研究CI/CD,把自动化部署的流程跑起来。我甚至需要直接跟客户沟通,去理解他们最原始的需求。

这个过程很“野”,也很累,但我的成长是全方位的。我不再只关心页面好不好看,我开始关心整个产品的逻辑、服务器的成本、用户的留存。我的视野被强制性地拉高了。

“影响力”被无限放大

在这里,我就是前端的负责人。

用Vue还是React?用Tailwind CSS还是CSS Modules?这些技术决策,我能够和老板、和团队一起讨论,并最终拍板。我们建立的每一个前端规范,写的每一个公共组件,都会立刻成为整个团队的标准。

这种“规则制定者”的身份,和在大厂当一个“规则遵守者”,是完全不同的体验。你能清晰地看到自己的每一个决定,都对产品和团队产生了直接而深远的影响。

离“价值”更近了

最重要的一点是,我能非常直接地感受到自己工作的价值。

我花一周时间开发的新功能上线后,第二天就能从运营同事那里拿到用户的反馈数据。我知道用户喜不喜欢它,它有没有帮助公司赚到钱。这种即时的、正向的反馈,比任何KPI或者年终奖金,更能给我带来成就感。

还会羡慕那些在大厂的朋友吗?

当然会。我羡慕他们优厚的薪酬福利,羡慕他们能参与到改变数亿人的项目中去。

但我不再因此而焦虑,也不再因此而自我否定。

你可以多想一想你真正想要的是什么? 一个公司的名字,并不能定义你作为一名工程师的价值。你的价值,体现在你写的代码里,体现在你解决的问题里,也有可能体现在你创造的产品里。

找到一个能让你发光发热的地方,比挤进一个让你黯淡无光的地方,重要得多。

分享完毕。谢谢大家🙂

来源:juejin.cn/post/7525011608366579758

网易微前端架构实战:如何管理100+子应用而不崩

你知道网易有多少个前端项目吗?

超过 1000 个代码仓库、200+子应用、每天发布300次。

如果没有一套微前端治理系统,项目早炸了。

今天就来带你拆解网易微前端架构的核心——基座 + 动态加载 + 权限隔离 + 独立发布。

一、网易为什么早早就用上了微前端?

因为早年起就有大量频道、游戏门户、社区运营、CMS后台等:

- 功能多样、团队独立

- 迭代频繁、部署不可等待

- 技术栈各异:Vue2、Vue3、React、甚至还有 jQuery...

👇于是他们选择了模块化能力最强的方案:微前端架构(Micro Frontends)

二、整体架构图(网易实战版)

三、主子应用通信怎么做?(网易方案)

网易没有用 qiankun,而是基于内部封装的微前端 SDK,核心原理类似。

// 主应用提供通信桥

window.__MICRO_APP_EVENT_BUS__ = new EventTarget()

// 子应用监听事件

window.__MICRO_APP_EVENT_BUS__.addEventListener('global-refresh', () => {

window.location.reload()

})

// 主应用触发事件

window.__MICRO_APP_EVENT_BUS__.dispatchEvent(new Event('global-refresh'))

👉这种方式:

- 不侵入框架(Vue/React 通吃)

- 不耦合代码,只用浏览器原生事件系统

四、部署与权限如何统一管理?

网易配套了一整套“发布平台 + 权限系统”,做到:

| 功能 | 说明 |

|---|---|

| 独立部署 | 每个子应用都有独立 Jenkins/流水线 |

| 权限接入 | 每个子应用上线必须绑定角色权限模块 |

| 域名配置 | 主应用统一路由配置,动态注入 iframe 或模块 |

| 沙箱运行 | 子应用运行在 iframe + ShadowDOM + CSP 下,完全隔离 |

五、实战代码:子应用注册和加载

// 主应用注册子应用(JSON 配置化)

const microAppList = [ { name: 'content-manage', entry: 'https://cdn.xxx.com/apps/content-manage/index.html', activeRule: '/content' }, { name: 'user-center', entry: 'https://cdn.xxx.com/apps/user-center/index.html', activeRule: '/user' }]

// 动态加载示例(简化版)

function loadMicroApp(appConfig) {

const iframe = document.createElement('iframe')

iframe.src = appConfig.entry

iframe.style = 'width:100%;height:100%;border:none'

document.getElementById('micro-container').appendChild(iframe)

}

六、网易踩过的3个坑(干货!)

| 坑 | 解决方案 |

|---|---|

| 子应用样式污染 | 每个子应用编译时加 prefixCls,搭配 ShadowDOM 隔离 |

| 子应用登录状态不一致 | 所有项目统一通过 Cookie + SSO 网关授权 |

| 子应用发布顺序冲突 | 发布系统支持灰度 + 停发自动依赖检查 |

七、总结:你能从中学到什么?

- 不要迷信 qiankun,自己也能搞微前端(原理简单)

- 微前端不仅是技术,更是权限、部署、治理一整套体系

- 想要稳定运行,必须有主子应用契约 + 灰度发布 + 统一通信策略

尾声:

“你看到的稳定,其实是他们踩了无数坑后的优雅。”

来源:juejin.cn/post/7510653719672094739

30+程序员如何不被小事击垮

引言

老张最近有一个重点项目在推进,他准备今天回家加班赶赶进度。

可到家之后,发现孩子发烧了,由于妻子出差,他赶紧放下手头的事情,抱起带孩子往医院跑。

堵车、吃饭、挂号、排队,一路折腾下来,已经九点了。

可就是这个点,儿科急诊仍是人山人海。孩子好奇的问东问西,手机里还不断跳出加急的消息,老张焦急的不断盘算着还有多久能排到他们。

马上到老张了,突然有一个人抱着孩子挤进了医生房间,老张愣了一下,火一下子就上来了,冲进屋子和对方吵了起来......

幸运的是孩子没什么事,可老张熬了一晚上啥也没干成。第二天上班状态不好,和业务方沟通时及其不耐烦。

下午收到了业务方的投诉,理由是态度消极。

老张一天什么也没干,却感觉自己马上就要崩溃了。

英雄就是这么被击垮的。据说是伏尔泰有句话说,“使人疲惫的不是远方的高山,而是你鞋里的一粒沙子”。

工作繁忙、孩子生病、业务方催促进度......都不是什么“重大事件”,可就是会压的你喘不过气来。

处理不好这些小麻烦,不但会影响你的情绪和工作表现,还有可能会影响我们的健康,最重要的是,如果被这些小事击垮了,我们哪还有心思去想什么大事呢?

我现在“大概”可以做到情绪稳定,我有四个自己在用的心法,分享给大家。

学会忽略

学会忽略,是我看到一句,据说是爱因斯坦说过的话:“弱者报复,强者原谅,智者忽略”。

就拿开车举例,我在路上发现过一个特别有意思的现象,如果开车的时候遇见插队,不同的司机有三种反应。

第一种人是对抗型,面对插队丝毫不让,眼看着两辆车的距离都塞不下一根手指头了,插队车决定放弃,他可能赢得了这场面子仗。

第二种人是原谅型,一开始会正常起步,但如果对方强行变道, 他会及时刹车,毕竟剐蹭了浪费时间浪费金钱。

第三种人是忽略型,他可能根本就没有在意这辆车在插队,他会直到前车完全进来,才会继续出发。他可能正沉浸在播客或者音乐里,神游在另一个维度。

你觉着哪种应对方式最好?

之前我是第二种人,并且还觉着第三种人是技术不佳,或者说是“好欺负”,直到最近我也有点了第三种人的样子。

有一次我在路上,听播客听的入迷,前方有个车有变道的意图。我也不着急,就让他变道进来了。

随后我才意识到,自己好像甚至都没有为这件事情,分散一点注意力。

那一刻我才明白,忽略,不是退让,也不用压抑情绪——

而是你根本没分配注意力分配给小事,负面情绪自然也就不会被激活。

忽略负面情绪非常有必要,有一项针对1300名男性做的研究,让他们对自己遇见类似于加塞这种小麻烦的反应打分,分数越高代表情绪反应越大。

结果发现,经常对小事有激烈反应的男性,他们的健康状况和死亡率,和面对那些重大人生压力的人一样。反应最激烈的那一组,在同样时间段内的死亡率,竟然是正常人的三倍。

我想起之前我奶奶家挂着一副《莫生气》的字画,里面有一句话:别人生气我不气,气出病来无人替。

看来对小事有激烈反应,真的会影响身心健康啊。我实践下来,忽略情绪有三个小技巧:

第一个是觉察情绪。当你发现自己心跳加快、紧握双拳,要注意情绪可能要来了。你需要深吸一口气,把注意力放到自己身上,让自己停下来,别被情绪牵着鼻子。

第二是控制自己的反应。维克多·弗兰克尔有一句话:“在面对外界刺激时,我们拥有选择如何回应的自由”。人真正能控制的只有自己的行动和态度,你控制不了堵车,但你能控制堵车的时候听一首钢琴曲。

第三是发现身边的美好,也就是感知生活中的“小确幸”。比如阳台上的花突然开了,孩子自己穿衣服了。有研究表明,对生活中积极细节的留意,能有效中和压力引发的负面情绪。

不恶意揣测

不过有些事情你很难忽略,比如公司考核政策调整,甚至说你持仓的股票大跌。

你感觉这个世界充满了恶意:公司打压你、社会在压榨你、资本在收割你。

可现实真的是这样吗?

帮助我解决心结的法则叫做「汉隆剃刀」。简单的说,它的意思就是「能解释为愚蠢的,就不要解释为恶意」。

这里说的愚蠢,代表各种无知的、偶然的、非故意的原因。这些情况发生的可能性远远大于恶意,汉隆剃刀大多数情况下反应了客观事实。

比如你开车,前方突然有车插队,你怒不可遏,心想:你是不是觉着我好欺负?

但其实他根本不认识你,只不过恰巧他意识到前方需要拐弯了。

这个法则在理解社会、组织层面,特别有效。

比如你持有的一只股票突然暴跌,你会听到一些传闻:说这是“庄家”在故意控盘。

我之前特别相信这种阴谋论,觉着股价是被人为操控的。可真实情况是,大公司的股价是很难操控的,投入很多钱也不一定能成功,一旦失败就会受到很大损失。而且市场上每个股民的互动、追涨杀跌,也会给股价造成很大影响。

再比如一家公司突然开始了绩效改革,给研发人员制定了和销售额相关的KPI,而且目标不完成还会对薪资产生影响。

可研发的考核怎么可能和销售的KPI挂钩呢?你怀疑管理层在变相降薪。

可更大的可能性是:管理层也不知道如何满足老板制定的目标,只能先套个模版应付一下。

不是你被打压了,只是碰巧他们不专业,你以为它是在有意的做坏事,但更大的可能是它没能力做好事。

我们大脑为了认知方便,常常会把一家公司或者一个政府当成一个人,假设他有自由意志,是一个决策缜密、心怀不轨的敌人。但其实组织就是一部机器而已。

不是组织在有意针对你,这世界其实就是个草台班子。

超越身份思维

你有没有经历过这种场面,过年回家刚坐下,七大姑八大姨联合开麦:

“你看你三十多了还在北京漂着,准备啥时候结婚啊?你表哥孩子都上小学了。”

“北京租房多贵啊,在咱老家,这都够还房贷了,干嘛不考个公务员安稳点?”

你努力工作、认真生活,熬过了失业焦虑、加班压力,结果成了他们口中的“混日子”。

你不是气他们说了什么,而是他们压根不懂你,却笃定地定义你。

可他们的确不懂你,也不会真正的懂你。他们只不过是在维护自己的世界观而已。

学术界有一个流行的说法是,人们的行为和观点,是由身份认同决定的。你的长辈,可能在一个小城过了一辈子,有编制、有房子、生儿育女,就是他们眼里的体面生活。

你异地漂泊、私企行业、租房未婚,就是他们眼中的“不务正业”。

你不需要反驳,也不需要忍耐。而是你明白了,你不需要从所有人眼里获得认可,你可以看到不同身份的局限性。

超越身份思维,在养育孩子的过程中特别有用。

那天我带儿子去上烘焙课,糖刚撒进面粉中,他就开始一边揉一边往嘴里塞。

我试图制止,他越发固执,并且不耐烦的喊:“我要回家!我要回家!”

我有点崩溃,一边怕他吃坏肚子,一边气他为什么这么不听话。

但那一刻我突然意识到,他不是故意气我,他只不过多想吃几口糖而已。

我们常说父母要包容孩子,为此你需要先理解他们的行为。糖果能刺激大脑释放多巴胺,这是最本能的反应,而且他们理性大脑还没有开始发育,你不能要求一个孩子有“自控力”

我们总以“大人的身份”要求孩子守规矩,可孩子的很多行为,并不是“不听话”,而是“做不到”。

就像人类的大脑,在25岁才能完全发育完成。也就是说,一个孩子即使成年之后,也会做出一些你不理解的事情。一个人成长的过程中,本就充满了能力滞后,

你不理解他,就会对抗他。你理解了,才能包容他。

找到目标

有一天我正坐在电脑前,正为了文章选题抓耳挠腮。

我儿子“砰”地一下推开门,一屁股坐在我旁边,拿着小汽车喊:“爸爸!爸爸...”

以往工作时被打断,我会特别不耐烦。可那天,我关上电脑开始陪他玩,我发现自己变得很有耐心。

过了一会他自己去客厅玩了,我坐在电脑前,去想我为什么会有这种改变。

是我变得有耐心了?还是我终于佛系了?后来我想明白了——是自己的目标更明确了。

过去一被打断就恼火,其实都是因为自己都不知道要干什么。我只是模糊的觉得,自己得做点有意义的事情。

但现在写好每一篇文章就是我想做的事情,就算短暂的停下来,也没有任何影响。

心理学上有一个「自我决定理论」:真正让人持续投入的,从来不是外界的压力或奖励,而是自己选的方向。

比如说当你在街道上跑步,周围车水马龙、喧嚣嘈杂,可你根本就听不见。因为你眼中,只有即将抵达的下一个路口。目标感就像降噪耳机,能让你不被外界打扰。

但如果你没有目标呢?虽然一天什么都没干,却很容易因为工作上的催促,家人的一句话,就能让你心烦意乱。

你不是没有承受力,你可能只是没有方向而已。

尼采说:“一个人知道自己为什么而活,就可以忍受任何一种生活。”

现在看来这不是鸡汤,而是硬道理。

真正让你内心安定的,不是时间管理、情绪技巧,而是——你有没有在朝着自己认可的方向,慢慢靠近。

说在最后

最后分享一句据说是爱默生说的一段话来结尾吧。

当整个世界似乎都在暗中图谋,用琐事一次又一次侵扰你、纠缠你,当所有人都来敲你的门,并且说,“到我们这里来吧。”绝对不要动心,不要加入到他们的喧闹中。始终保有一颗自助自主的心,不受外界影响和左右,活在自己的意志里,才能够使心灵得到宁静,才会过上真正独立的生活。

以上就是我自己应对生活中一些“小麻烦”的个人心得,如果你也有面对“小麻烦”时处理情绪的技巧,欢迎在评论区分享~

这是东东拿铁的第84篇原创文章,欢迎关注。

来源:juejin.cn/post/7522751214263992370

苹果官网前端技术解析:极简设计背后的技术精粹

苹果公司官网(apple.com)以其优雅的极简设计、流畅的交互体验和卓越的性能表现闻名于世。本文将深入解析苹果官网前端实现的技术亮点,并附上关键技术的示例代码实现。

一、视觉滚动效果:视差与滚动驱动动画

苹果官网最显著的特点是其精致的滚动效果,包括视差滚动、滚动触发的动画和流畅的页面过渡。

1. 高级视差效果实现

苹果官网的视差效果不是简单的背景固定,而是多层元素以不同速度移动创造的深度感。

// 视差滚动控制器

class ParallaxController {

constructor() {

this.elements = [];

this.scrollY = 0;

this.init();

}

init() {

this.cacheElements();

this.addEventListeners();

this.animate();

}

cacheElements() {

this.elements = Array.from(

document.querySelectorAll('[data-parallax]')

).map(el => ({

el,

speed: parseFloat(el.getAttribute('data-parallax-speed')) || 0.3,

offset: 0

}));

}

addEventListeners() {

window.addEventListener('scroll', () => {

this.scrollY = window.scrollY;

});

// 使用IntersectionObserver来优化性能

const observer = new IntersectionObserver((entries) => {

entries.forEach(entry => {

if (entry.isIntersecting) {

entry.target.classList.add('parallax-active');

}

});

}, { threshold: 0.1 });

this.elements.forEach(({ el }) => observer.observe(el));

}

animate() {

requestAnimationFrame(() => {

this.elements.forEach(({ el, speed }) => {

const rect = el.getBoundingClientRect();

const offset = this.scrollY * speed;

// 只对可见元素应用变换

if (rect.top < window.innerHeight && rect.bottom > 0) {

el.style.transform = `translate3d(0, ${offset}px, 0)`;

}

});

this.animate();

});

}

}

new ParallaxController();

2. 滚动触发动画(ScrollTrigger)

苹果官网大量使用滚动位置触发的精细动画:

// 滚动触发动画系统

class ScrollAnimation {

constructor() {

this.animations = [];

this.init();

}

init() {

document.querySelectorAll('[data-scroll-animation]').forEach(el => {

const animation = {

el,

trigger: el.getAttribute('data-scroll-trigger') || 'center',

class: el.getAttribute('data-scroll-class'),

reverse: el.hasAttribute('data-scroll-reverse')

};

this.animations.push(animation);

});

window.addEventListener('scroll', this.checkAnimations.bind(this));

this.checkAnimations();

}

checkAnimations() {

const viewportHeight = window.innerHeight;

const scrollY = window.scrollY;

this.animations.forEach(animation => {

const rect = animation.el.getBoundingClientRect();

const elementTop = rect.top + scrollY;

const elementCenter = elementTop + rect.height / 2;

const triggerPoint = scrollY + viewportHeight * this.getTriggerRatio(animation.trigger);

if (elementCenter < triggerPoint) {

animation.el.classList.add(animation.class);

} else if (animation.reverse) {

animation.el.classList.remove(animation.class);

}

});

}

getTriggerRatio(trigger) {

const ratios = {

top: 0.1,

center: 0.5,

bottom: 0.9

};

return ratios[trigger] || 0.5;

}

}

new ScrollAnimation();

二、响应式图片与艺术指导(Art Direction)

苹果官网针对不同设备展示不同裁剪和分辨率的图片,实现最佳视觉效果。

1. 响应式图片实现

<picture>

<!-- 大屏幕显示宽屏图片 -->

<source media="(min-width: 1440px)"

srcset="product-large.jpg 1x,

product-large@2x.jpg 2x">

<!-- 中等屏幕显示标准图片 -->

<source media="(min-width: 768px)"

srcset="product-medium.jpg 1x,

product-medium@2x.jpg 2x">

<!-- 小屏幕显示竖版图片 -->

<source srcset="product-small.jpg 1x,

product-small@2x.jpg 2x">

<!-- 默认回退 -->

<img src="product-medium.jpg"

alt="Apple Product"

class="responsive-image"

loading="lazy">

</picture>

2. 动态图片加载优化

class ImageLoader {

constructor() {

this.images = [];

this.init();

}

init() {

this.cacheImages();

this.observeImages();

}

cacheImages() {

this.images = Array.from(document.querySelectorAll('img[data-src]'));

}

observeImages() {

const observer = new IntersectionObserver((entries, observer) => {

entries.forEach(entry => {

if (entry.isIntersecting) {

this.loadImage(entry.target);

observer.unobserve(entry.target);

}

});

}, {

rootMargin: '200px 0px',

threshold: 0.01

});

this.images.forEach(img => observer.observe(img));

}

loadImage(img) {

const src = img.getAttribute('data-src');

if (!src) return;

const tempImg = new Image();

tempImg.src = src;

tempImg.onload = () => {

img.src = src;

img.removeAttribute('data-src');

img.classList.add('loaded');

};

}

}

new ImageLoader();

三、高性能动画实现

苹果官网的动画以60fps的流畅度著称,这得益于他们对动画性能的极致优化。

1. GPU加速动画

/* 苹果官网风格的CSS动画 */

.product-card {

transform: translateZ(0); /* 触发GPU加速 */

will-change: transform, opacity; /* 提示浏览器元素将变化 */

transition: transform 0.6s cubic-bezier(0.25, 0.1, 0.25, 1),

opacity 0.6s ease-out;

}

.product-card:hover {

transform: translateY(-10px) scale(1.02);

opacity: 0.9;

}

2. 基于WebGL的复杂动画

苹果官网有时会使用WebGL实现复杂的3D产品展示:

// 简化的WebGL产品展示实现

class ProductViewer {

constructor(canvasId) {

this.canvas = document.getElementById(canvasId);

this.renderer = new THREE.WebGLRenderer({

canvas: this.canvas,

antialias: true,

alpha: true

});

this.scene = new THREE.Scene();

this.camera = new THREE.PerspectiveCamera(45, 1, 0.1, 1000);

this.product = null;

this.init();

}

async init() {

this.setupCamera();

this.setupLighting();

await this.loadProduct();

this.setupControls();

this.animate();

this.handleResize();

}

setupCamera() {

this.camera.position.z = 5;

this.updateAspectRatio();

}

updateAspectRatio() {

const width = this.canvas.clientWidth;

const height = this.canvas.clientHeight;

this.camera.aspect = width / height;

this.camera.updateProjectionMatrix();

this.renderer.setSize(width, height, false);

}

setupLighting() {

const ambientLight = new THREE.AmbientLight(0xffffff, 0.5);

this.scene.add(ambientLight);

const directionalLight = new THREE.DirectionalLight(0xffffff, 0.8);

directionalLight.position.set(1, 1, 1);

this.scene.add(directionalLight);

}

async loadProduct() {

const loader = new THREE.GLTFLoader();

const { scene } = await loader.loadAsync('product-model.glb');

this.product = scene;

this.scene.add(this.product);

}

setupControls() {

this.controls = new THREE.OrbitControls(this.camera, this.canvas);

this.controls.enableDamping = true;

this.controls.dampingFactor = 0.05;

this.controls.minDistance = 3;

this.controls.maxDistance = 10;

}

animate() {

requestAnimationFrame(this.animate.bind(this));

this.controls.update();

this.renderer.render(this.scene, this.camera);

}

handleResize() {

window.addEventListener('resize', () => {

this.updateAspectRatio();

});

}

}

new ProductViewer('product-canvas');

四、自适应与响应式布局系统

苹果官网的自适应布局系统能够在各种设备上提供完美的视觉体验。

1. 基于CSS Grid的布局系统

/* 苹果官网风格的自适应网格系统 */

.product-grid {

display: grid;

grid-template-columns: repeat(auto-fit, minmax(300px, 1fr));

gap: 24px;

padding: 0 40px;

max-width: 2560px;

margin: 0 auto;

}

@media (max-width: 768px) {

.product-grid {

grid-template-columns: 1fr;

padding: 0 20px;

gap: 16px;

}

}

/* 苹果特色的全屏分段布局 */

.section {

min-height: 100vh;

display: flex;

flex-direction: column;

justify-content: center;

padding: 120px 10%;

position: relative;

overflow: hidden;

}

.section-content {

max-width: 1200px;

margin: 0 auto;

position: relative;

z-index: 2;

}

2. 动态字体大小调整

// 基于视口宽度调整字体大小

class FluidTypography {

constructor() {

this.minFont = 16;

this.maxFont = 24;

this.minWidth = 320;

this.maxWidth = 1920;

this.init();

}

init() {

this.updateFontSizes();

window.addEventListener('resize', this.updateFontSizes.bind(this));

}

updateFontSizes() {

const viewportWidth = window.innerWidth;

const clampedWidth = Math.min(Math.max(viewportWidth, this.minWidth), this.maxWidth);

const scale = (clampedWidth - this.minWidth) / (this.maxWidth - this.minWidth);

const fontSize = this.minFont + (this.maxFont - this.minFont) * scale;

document.documentElement.style.setProperty(

'--fluid-font-size',

`${fontSize}px`

);

}

}

new FluidTypography();

五、微交互与状态管理

苹果官网的按钮、导航等交互元素有着精细的状态反馈。

1. 按钮交互效果

/* 苹果风格的按钮 */

.apple-button {

display: inline-block;

padding: 12px 22px;

border-radius: 30px;

background: linear-gradient(to bottom, #42a1ec, #0070c9);

color: white;

font-size: 17px;

font-weight: 400;

text-align: center;

cursor: pointer;

border: none;

outline: none;

transition: all 0.3s cubic-bezier(0.25, 0.1, 0.25, 1);

position: relative;

overflow: hidden;

}

.apple-button:hover {

background: linear-gradient(to bottom, #2d92e8, #0068b8);

transform: scale(1.02);

box-shadow: 0 5px 15px rgba(0, 112, 201, 0.3);

}

.apple-button:active {

transform: scale(0.98);

background: linear-gradient(to bottom, #1b7fd1, #005ea3);

}

.apple-button::after {

content: '';

position: absolute;

top: 50%;

left: 50%;

width: 5px;

height: 5px;

background: rgba(255, 255, 255, 0.5);

opacity: 0;

border-radius: 100%;

transform: scale(1, 1) translate(-50%, -50%);

transform-origin: 50% 50%;

}

.apple-button:focus:not(:active)::after {

animation: ripple 1s ease-out;

}

@keyframes ripple {

0% {

transform: scale(0, 0);

opacity: 0.5;

}

100% {

transform: scale(20, 20);

opacity: 0;

}

}

2. 全局状态管理

苹果官网使用类似状态机的模式管理复杂的UI状态:

class UIStateManager {

constructor() {

this.states = {

NAV_OPEN: false,

MODAL_OPEN: false,

DARK_MODE: false,

PRODUCT_VIEW: null

};

this.subscribers = [];

this.init();

}

init() {

// 监听系统颜色偏好

const darkModeMediaQuery = window.matchMedia('(prefers-color-scheme: dark)');

this.setDarkMode(darkModeMediaQuery.matches);

darkModeMediaQuery.addListener(e => this.setDarkMode(e.matches));

}

setState(key, value) {

if (this.states[key] !== undefined) {

this.states[key] = value;

this.notifySubscribers(key);

}

}

subscribe(callback) {

this.subscribers.push(callback);

}

notifySubscribers(changedKey) {

this.subscribers.forEach(cb => cb(changedKey, this.states));

}

toggleNav() {

this.setState('NAV_OPEN', !this.states.NAV_OPEN);

}

setDarkMode(enabled) {

this.setState('DARK_MODE', enabled);

document.documentElement.classList.toggle('dark-mode', enabled);

}

}

const stateManager = new UIStateManager();

// 示例组件使用状态

class NavMenu {

constructor() {

this.el = document.querySelector('.nav-menu');

stateManager.subscribe(this.onStateChange.bind(this));

}

onStateChange(key, states) {

if (key === 'NAV_OPEN') {

this.el.classList.toggle('open', states.NAV_OPEN);

document.body.style.overflow = states.NAV_OPEN ? 'hidden' : '';

}

}

}

new NavMenu();

六、性能优化策略

苹果官网加载速度快且运行流畅,这得益于多项性能优化技术。

1. 资源预加载

<!-- 预加载关键资源 -->

<link rel="preload" href="hero-image.jpg" as="image">

<link rel="preload" href="main.css" as="style">

<link rel="preload" href="main.js" as="script">

<!-- 预连接重要第三方源 -->

<link rel="preconnect" href="https://cdn.apple.com">

<link rel="dns-prefetch" href="https://cdn.apple.com">

2. 代码分割与懒加载

// 动态导入非关键模块

document.addEventListener('DOMContentLoaded', async () => {

if (document.querySelector('.product-carousel')) {

const { initCarousel } = await import('./carousel.js');

initCarousel();

}

if (document.querySelector('.video-player')) {

const { initVideoPlayer } = await import('./video-player.js');

initVideoPlayer();

}

});

3. Service Worker缓存策略

// service-worker.js

const CACHE_NAME = 'apple-v3';

const ASSETS = [

'/',

'/main.css',

'/main.js',

'/images/logo.svg',

'/images/hero.jpg'

];

self.addEventListener('install', event => {

event.waitUntil(

caches.open(CACHE_NAME)

.then(cache => cache.addAll(ASSETS))

);

});

self.addEventListener('fetch', event => {

event.respondWith(

caches.match(event.request)

.then(response => {

if (response) {

return response;

}

return fetch(event.request).then(response => {

if (!response || response.status !== 200 ||

response.type !== 'basic' ||

!event.request.url.includes('/assets/')) {

return response;

}

const responseToCache = response.clone();

caches.open(CACHE_NAME)

.then(cache => cache.put(event.request, responseToCache));

return response;

});

})

);

});

结语

苹果官网的前端实现代表了Web开发的最高水准,其技术特点可以总结为:

- 极致的性能优化:确保60fps的流畅动画和即时加载

- 精细的交互设计:每个微交互都经过精心调校

- 自适应的视觉系统:在各种设备上提供完美体验

- 高效的状态管理:复杂UI的有序控制

- 渐进增强策略:平衡功能与兼容性

这些技术不仅适用于大型企业网站,其中的许多模式和技巧也可以应用于各种Web项目,帮助开发者创建更高质量的用户体验。

来源:juejin.cn/post/7521160007854866467

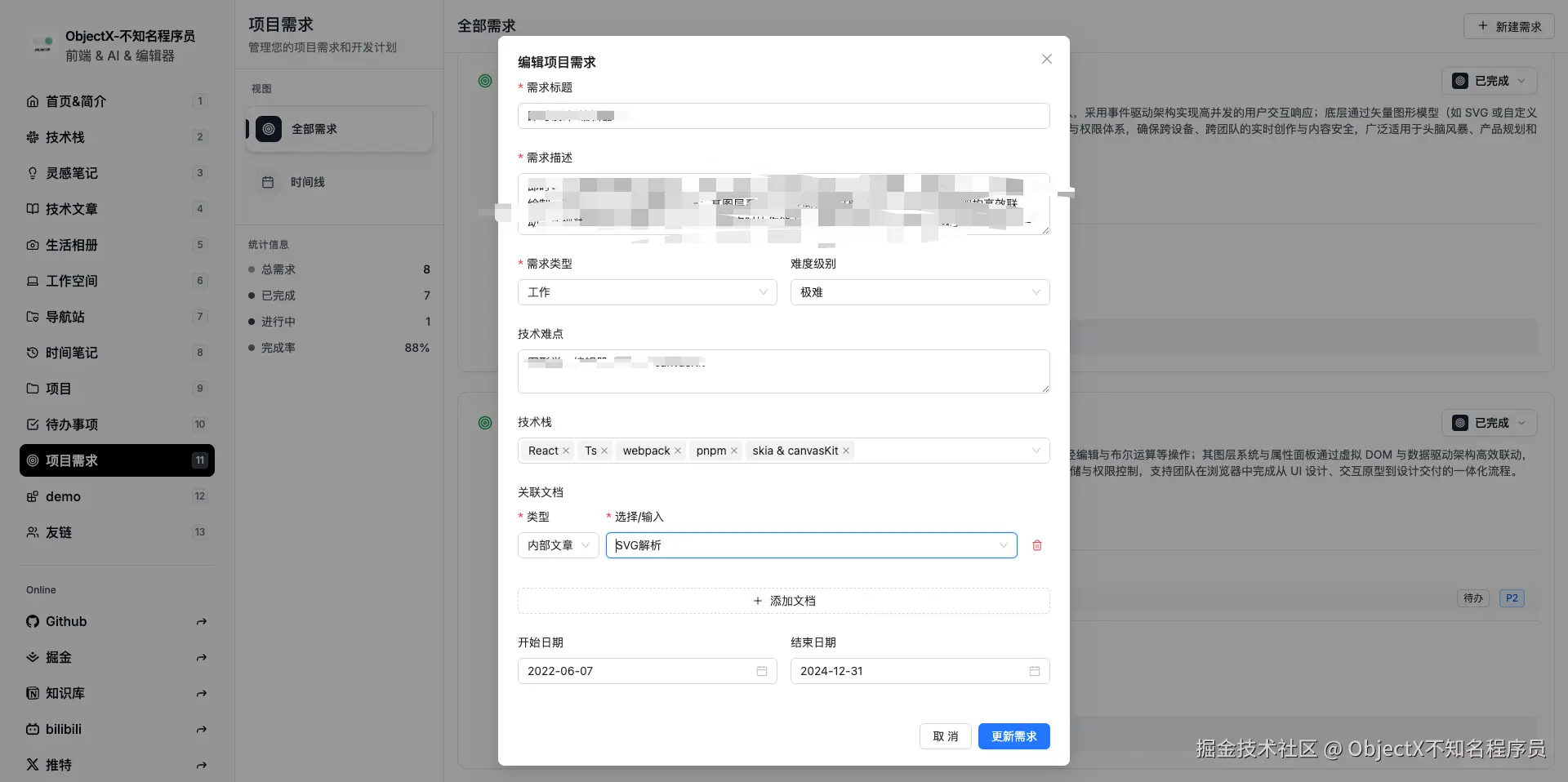

三年写了很多代码,也想写写自己

前言

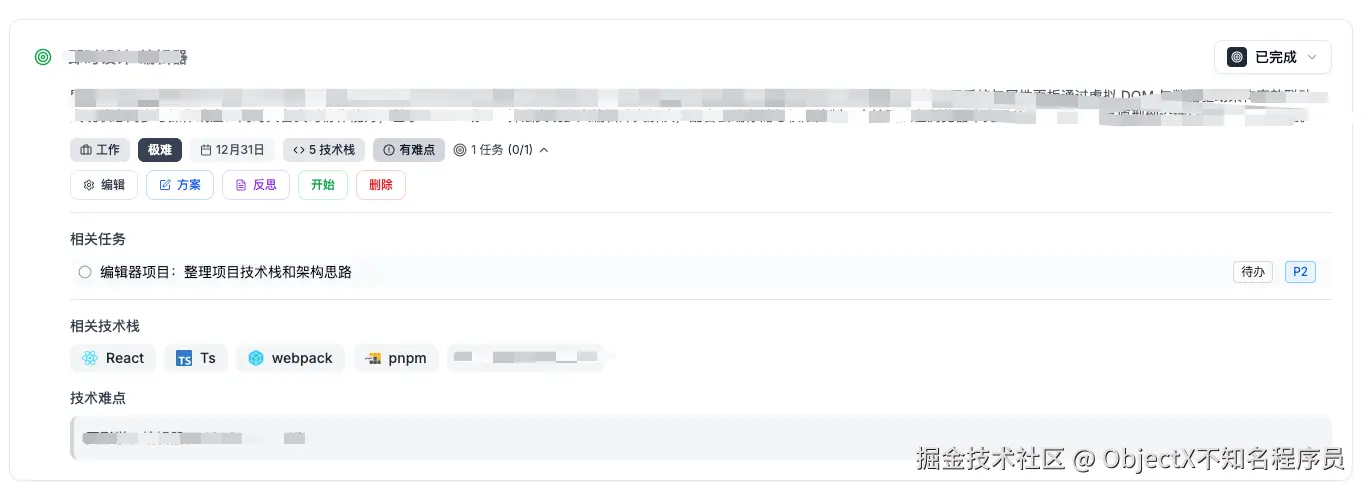

从我进入公司开始,我给自己立了一个三年成为中级前端工程师的目标,或者说flag吧,最近正好三年合同到期了,我开始思考过去的这三年我都做了什么,是否完成了flag,所以我在个人博客中增加了一个模块《项目需求》用于管理自己在生活、工作、学习过程中开发过的项目文档和思考,在整理的过程中才发现很多东西都忘记是怎么做的了,大概是只知道做,不知道为什么做吧,所以这里想写一篇文章记录下或者说获取一些建议吧。

很多人说博客和todo没啥用,开发完几乎都不会使用,我觉得看怎么用吧,我这里把项目和todo、技术文档、技术栈绑定了。编辑项目和可以和todo绑定,我觉得还挺好使,这样在整理技术文档、技术调研的时候也可以用

过去三年我都做了什么

2022年

基本情况

因为在学校的时候根本没想过这么早出社会,原本是打算走学术路线的,结果考研那年因为家里临时出了点状况,最后决定先工作再说。现在回头看也挺好的,早点接触社会,其实成长得更快。

在这一年我主要是疯狂补项目经验和疯狂加班,因为社会始终不同于学校,排期让人很头疼,在以往我缺失了很多的项目经验,导致对企业级项目几乎不通,导致我在做任何项目都比较挣扎,再加上进的是一个小厂,完全没有导师制,属于放养,并且大家都很忙,所以只能自己多花时间,并且当时我学的vue的技术栈,但是公司是react的,光是搞懂 React 那一套生态就花了不少时间。

项目经历

- 早期主要是做企业后台 & figma插件,其中有一个插件让我特别头疼,一方面因为当时的自己比较菜,另一方面因为这个需求是一个刚毕业的设计驱动的,属于是啥也不通,导致产品逻辑也不对,写出来之后疯狂打补丁,最后也还是啥也不是。

- 后面做了设计社区,都是一些简单的ui和业务逻辑,因为是一个设计编辑器平台

- 在写了几个后台之后我逐渐熟悉了公司开发技术栈和后台开发逻辑,最早这个公司吸引我的是编辑器,后面我就申请去做了编辑器

- 最开始是编辑器的字体加载、和一些创新的业务需求、设计工具中不同模式的数据结构复用、画布设置【缩放、背景等等】、对齐至像素网格

成长

- 技术上,从 Vue 转到 React 后,逐步掌握了 React 的核心理念和生态工具,像状态管理、组件设计、性能优化这些都有了比较实战的理解;

- 项目上,能独立负责模块开发,也逐步学会了和产品、设计磨合需求;

- 心态上,从一开始觉得“自己不会”到现在敢主动挑任务、遇到新东西也不怕折腾,整体自驱力和解决问题的能力都提升了不少。

- 这时候还是需要拿着电脑到处抓人问问题,非常感谢当时给予我帮助的小伙伴

2023年

基本情况

这个阶段已经开始逐步适应工作生活了,但是还是会畏惧需求,因为还有很多没接触过的东西,依然还是疯狂加班,不光是需求,还有自己学习一些东西,这时候我已经切换到了编辑器领域,其中涉及很多图形学知识,比如坐标转换、矩阵运算、渲染原理、渲染库的使用等等,因为公司里的人几乎不写文档,代码也是anyscript,并且这时候ai还没有,编辑器这个领域,网上几乎搜不到什么文档啥的,只能生啃代码和类型文件并尝试demo,这时候用的就是最笨却最有效的方法,做到哪就把哪个模块整理一篇文档记录下来,慢慢的也就掌握了项目的大部分逻辑和架构思路

项目经历

- 设计工具中不同模式的数据结构复用,一个创新业务需求,使用同一套数据,快捷的进行模式切换,非常巨大的需求,正是因为这个需求让我学会了很多东西,开始能独立负责一个模块的开发

- 白板项目:其中做了节点数据结构定义【便签、图形文本、连接线等等】、节点树的处理、节点的渲染、项目框架搭建、画布设置、缩放、属性控制、属性工具条、性能优化等等,几乎所有功能都写了一部分,这个项目是我从0-1经历的一个项目,历时10个月,早期有很多人,后来因团队调整,部分成员转入新项目,剩余的人员就非常的少了,我是其中之一。

- 这一年我几乎都在做白板项目,其中连接线是最难的,我写了其中的一部分,还因此挨了一批,给我上了社会上的第一堂课【能力不足就得背锅】

成长

- 编辑器初步入门:理解了编辑器的基本架构 & 实现原理,如模块划分、碰撞检测、矩阵运算原理、渲染库的基本使用、复制粘贴的实现原理、svg的解析原理等等、数据节点定义、节点树的使用等等

- canvas、svg、渲染库的基本使用 & 原理

- 学到了很多调试技巧、看了很多的技术文章

- 能够独立负责一个模块的开发和推进

- 自己开始从0-1写一些项目,23年主要是一个工程化的项目,因为当时公司没有脚手架,每次创建新项目都要配置一遍,我就想写一个脚手架来用,就开始探究一些前端工程化的东西,这里主要是一个前端工程化的demo

2024年

基本情况

这时候已经对编辑器开发很熟练了,能够自己调研、处理一些模块,不会畏惧需求,拿到什么都能做也敢做,再加上ai的爆发,现在很轻松就能应付日常需求,还有一些时间开发自己的东西。这时候我几乎不用在追着别人问了,开始探究一些技术上的原理,看了react的源码,了解了react的运行原理,我最初看这个的驱动是因为我想看懂编辑器底层的数据结构和自定义渲染器的实现原理,因为是相通的。

项目经历

- 多模式切换的设计工具,在23年双模式切换有一个比较客观的数据基础上,想要开发多模式切换

- 编辑器重构:真真正正的从0-1实现编辑器,学到了非常多的东西

成长

- 这个阶段成长是最快的,在之前自己主动学习和开发过程中的积累,达到了量变到质变的过程,再加上重构过程中全是实实在在的技术类需求,这个阶段开发的非常爽,学到了非常多的东西,一度让我觉得我们也能做出一个超级nb的东西

- 对编辑器的整体实现理解更加深入,对大型项目的推进和管理有一些了解

- 对于代码质量,代码风格,团队管理,团队交流都有更深的体会

2025年

基本情况

进入新团队后,开始参与 AI 方向的生成类产品开发。虽然整体技术难度相比之前的编辑器项目要低一些,但节奏非常快,很多需求都是边想边做,对响应能力和落地能力要求更高。项目整体强调快速迭代、快速验证,很多时候从 0 到上线都只有几天时间。

项目经历

- 核心流程重构:参与整个生成流程的梳理和重构,数据结构的重设计,提升了整体稳定性和扩展性。

- AI 创新功能研发:参与多个创意方向的原型开发,包括智能组件、AI 引导式操作流程等,既需要理解前端,也需要深入 AI 接口的能力边界。

- 常规前端需求:除了核心 AI 功能,也参与大量 Web 端页面开发、交互优化、组件抽象等日常前端需求的处理。

- 跨角色协作:与产品、模型工程师保持密切沟通,协助设计 prompt、测试接口,探索“产品-模型-前端”的协作流程,理解 prompt 工程的基本逻辑。

成长

- AI 与前端的深度结合:理解 AI 接口的调用逻辑、数据结构设计、模型能力边界,并在多个场景中尝试 prompt 调优、token 限制控制、输出结构稳定性等关键问题。

- 需求落地能力提升:现在不管接到什么需求,都能独立完成从调研、设计、开发、联调到交付的完整流程,并且具备识别风险、提前发现问题并推动解决的能力。

- 项目推进与优化意识:开始更关注整体产品的合理性和可维护性,不再仅仅关注功能实现,会主动提出重构建议、设计优化点、体验提升方案。

- 应变与协作能力加强:面对快节奏、多变的需求场景,能够保持清晰的优先级判断

- 干了很多新鲜的东西,还挺好玩的,ai接入支付、ai表单等等。

我自己写的项目

就这几个,其他的几乎都是一些不成型的demo,还有几乎都在写公司的项目

- nextjs-blog:一个用nextjs写的高聚合的全栈博客,还在持续更新,有时候有点犯懒,在线访问

- handwriting_js:没事写点手写题,写了忘,忘了写,一个也记不住

- react_demo :前端工程化demo,配合这个专栏食用最佳

- debug_react:18.2.0的react源码调试环境

- debug_webpack: webpack5源码调试环境

现在我是怎么想的

- 快速学习的能力比技术能力更值得培养

技术更新太快了,几乎每一年都会冒出一堆新概念、新框架、新工具,追是追不完的。相比“掌握某个技术”,更在意的是“有没有能力快速理解它、上手它、找到它的边界”,这是一个更本质的能力。 - 技术是为业务服务的,但我们也要有自己的判断和坚持

做久了之后会发现,代码写得好不好,有时候并不是最关键的,能不能解决问题、把事情落地才是关键。谁也不想变成“只写业务”的人——在完成需求的同时,尽可能把事情做得优雅些,至少对得起自己的审美和标准。 - 保持初心

有时候项目节奏快、需求不讲理、上线压力大,很容易被“搞完就行”的心态裹挟,还是需要保持自己的思考 - 身体是革命的本钱!!!!

24年7月份左右,体检,发现小毛病快20项,全是久坐,熬夜搞出来的小毛病,可能因为之前加班太多了,也不运动,在7-11月胖了20多斤,并且整日没精打采,身体没有力气,像是气血亏虚一样,我去看了中医,开了一些调养的中药,12月底才开始有好转,我找了私教,去健身房开始健身,大半年了现在就好多了,增肌也小成 - 培养工作之外的兴趣爱好

健身、摄影、钓鱼都可以,长时间的工作会使人麻木和疲惫,需要一些工作之外的爱好调和

我还做了一个在线相册,从大佬Innei获取到的思路,但技术栈是不一样的,也比较简单

以后我想干啥

说实话,我现在还没完全想明白这个问题。过去几年我经历了从业务开发,到编辑器、到 AI 项目,接触了很多不同的方向,也成长了不少。但也正因为尝试了很多,现在反而更谨慎,不想轻易贴标签。

我想我还是会继续写代码,但不一定只写代码。我更在意的是:“我做的东西有没有价值?有没有可能改变点什么?”也许未来会往架构方向走,也许会继续在 AI 产品方向深入,也可能有一天突然转向一个完全不同的方向,比如做点属于自己的产品。

我目前能确定的就是三件事:

- 我希望能一直保持学习和探索的状态,不断拓宽认知边界;

- 我希望在一个让我有成长、有挑战感的环境里工作;

- 我希望做的事能让我感到值得,能有一点点“留下痕迹”的感觉。

剩下的,就边走边看吧,继续更新文章,但不会跟之前一样那么频繁,从中学到东西,并且能够帮助别人

来源:juejin.cn/post/7524602914514763819

老板:咱们公司的设备开机,怎么显示Android。这怎么行,把Android替换掉,显示公司的logo,最好加点牛逼的动画.。

老板: 咱们公司的设备开机,怎么显示Android。这怎么行,把Android替换掉,显示公司的logo,最好加点牛逼的动画.

小卡拉米: 好的,老板

小卡拉米 to UI: 老板说要一个牛逼的动画。

UI: 我*&……%%¥……&&*………………%

1、UI设计帧动画

跟UI沟通,最好说明,老板的意思,怎么牛逼。最重要的是:

- 把动画输出成序列帧。

- 分辨率和板子的分辨率一致。

- 命名规则:00.jpg 01.jpg ...99.jpg

2、制作动画包

新建一个文件夹,名字为:bootanimation

新建子文件夹第一部分动画:命名为part1,将UI设计好的非常牛逼的动画,放进去

新建子文件夹第二部分定格动画:命名为part2 ,将帧动画的最后一帧放到这里边

新建一个desc.txt

desc.txt的内容:

1024 768 60

p 1 0 part1

p 0 10 part2

全局参数(第一行)

1024

屏幕的 宽度(Width),单位为像素(px)。表示动画的分辨率宽度为 1024px。768

屏幕的 高度(Height),单位为像素(px)。表示动画的分辨率高度为 768px。60

动画的 帧率(FPS, Frames Per Second)。表示每秒播放 60 帧,但实际帧率受硬件和系统限制(可能无法真正达到 60 FPS)。

分段参数(后续行)

每行定义一个动画片段,格式为:

[类型] [循环次数] [间隔时间] [目录名]

第一片段:p 1 0 generic1

p

播放类型(Play Mode):

p表示正常播放(逐帧播放后停止)。- 另一种类型是

c(hold last frame),表示播放完成后停留在最后一帧。

1

循环次数(Loop Count):

1表示该片段播放 1 次。0表示无限循环(直到开机完成或被中断)。

0

间隔时间(Delay):

- 单位为帧数(基于全局帧率)。

0表示片段播放完成后 无额外延迟,直接进入下一片段。

- 单位为帧数(基于全局帧率)。

generic1

动画资源目录名:

- 对应

part0、part1等目录,存放该片段的 PNG 图片(按序号命名,如img000.png)。

- 对应

第二片段:p 0 10 generic2

p

正常播放模式。0

无限循环,直到开机流程结束或被系统终止。10

间隔时间为 10 帧(若全局帧率为 60 FPS,则实际延迟为10/60 ≈ 0.167 秒)。generic2

第二个动画资源目录名。

- 系统会先播放

generic1目录中的动画,播放 1 次,无延迟。 - 接着播放

generic2目录中的动画,无限循环,每次循环结束后等待 10 帧的时间。 - 开机动画会持续播放,直到系统启动完成(或强制终止)。

压缩动画包(很重要的一步)

- 压缩的时候,不要在外边一层去压缩,要点进去bootanimation文件夹,全选压缩。

- 压缩的时候格式要选择成存储。360压缩,自定义里边有。

3、替换动画包

使用adb命令进行替换,替换之前设备要进行root,一般开发板都是 root过的,然后使用命令进行替换

默认情况下,Android 设备的 /system 分区是只读的(出于系统安全性考虑)。adb remount 会临时将其重新挂载为可读写(rw),允许你修改系统文件(如删除预装应用、替换系统文件等)。

adb root // 获取root 权限

adb remount //重新挂载为可读写

adb push 你的动画包路径 system/media

动画包的名称一般是bootanimation.zip,有些厂商的可能不一样,如果不生效可以咨询板子厂家进行修改

替换成功之后,直接运行 adb reboot 进行重启,见证奇迹。

4、Android动画前的小企鹅(Linux开机动画)

我真服了,板子出厂前,竟然还有Linux开机动画,这个关掉,需要更改内核启动参数。下边是修改方法,但是建议联系厂家,建议联系厂家,建议联系厂家

4.1. 确认 Logo 类型

- Linux 内核 Logo:企鹅 Logo 通常是内核编译时内置的,文件格式可能是

.ppm、.rle或.png。 - Bootloader Logo:某些设备的厂商会在 Bootloader 阶段显示自定义 Logo(如高通设备的

splash.img)。

需要先确定企鹅 Logo 的来源:

- 如果设备启动时先显示企鹅,再显示 Android 开机动画(

bootanimation.zip),则属于 内核 Logo。

4.2. 替换 Linux 内核 Logo

步骤 1:获取内核源码

- 需要设备的 内核源代码(从厂商或开源社区获取,如 LineageOS、XDA 论坛等)。

- 如果厂商未公开源码,此方法不可行。

步骤 2:准备自定义 Logo

- 内核支持的格式通常为 PPM(Portable PixMap),尺寸需与屏幕分辨率匹配(如 1024x768)。

- 使用工具(如 GIMP、ffmpeg)将图片转换为

.ppm格式,并保存为logo_linux_clut224.ppm(文件名可能因内核版本而异)。

步骤 3:替换内核 Logo 文件

- 将自定义的

.ppm文件替换内核源码目录中的对应文件:

# 示例路径(不同内核可能不同)

cp custom_logo.ppm drivers/video/logo/logo_linux_clut224.ppm

步骤 4:编译内核

- 配置内核编译选项,确保启用 Logo 显示:

make menuconfig

# 进入 Device Drivers -> Graphics support -> Bootup logo

# 启用 "Standard 224-color Linux logo"

- 编译内核并生成

boot.img:

make -j$(nproc)

步骤 5:刷入新内核

- 使用

fastboot刷入编译后的boot.img:

fastboot flash boot boot.img

4.3. 替换 Bootloader Logo(高通设备示例)

如果企鹅 Logo 是 Bootloader 阶段的 Splash Screen(如高通设备):

步骤 1:提取当前 Splash Image

- 从设备中提取

splash.img:

adb pull /dev/block/bootdevice/by-name/splash splash.img

步骤 2:修改 Splash Image

- 使用工具(如 splash_screen_tool)解包

splash.img,替换其中的图片,再重新打包。

步骤 3:刷入新 Splash Image

- 通过

fastboot刷入:

fastboot flash splash splash.img

4. 隐藏企鹅 Logo(无需替换)

如果无法修改内核或 Bootloader,可以尝试以下方法:

- 修改内核启动参数:在内核命令行中添加

logo.nologo参数(需解锁 Bootloader 并修改boot.img的cmdline)。 - 禁用 Framebuffer:在内核配置中关闭

CONFIG_LOGO选项(需重新编译内核)。

注意事项

- 风险提示:建议联系厂家进行修改

- 修改内核或 Bootloader 可能导致设备无法启动(变砖)。

- 需要解锁 Bootloader(会清除设备数据并失去保修)。

- 兼容性:

- 不同设备的 Logo 实现方式差异较大,需查阅设备的具体文档。

- 备份:

- 操作前备份重要数据,并保留原版

boot.img或splash.img。

- 操作前备份重要数据,并保留原版

来源:juejin.cn/post/7508646757884690468

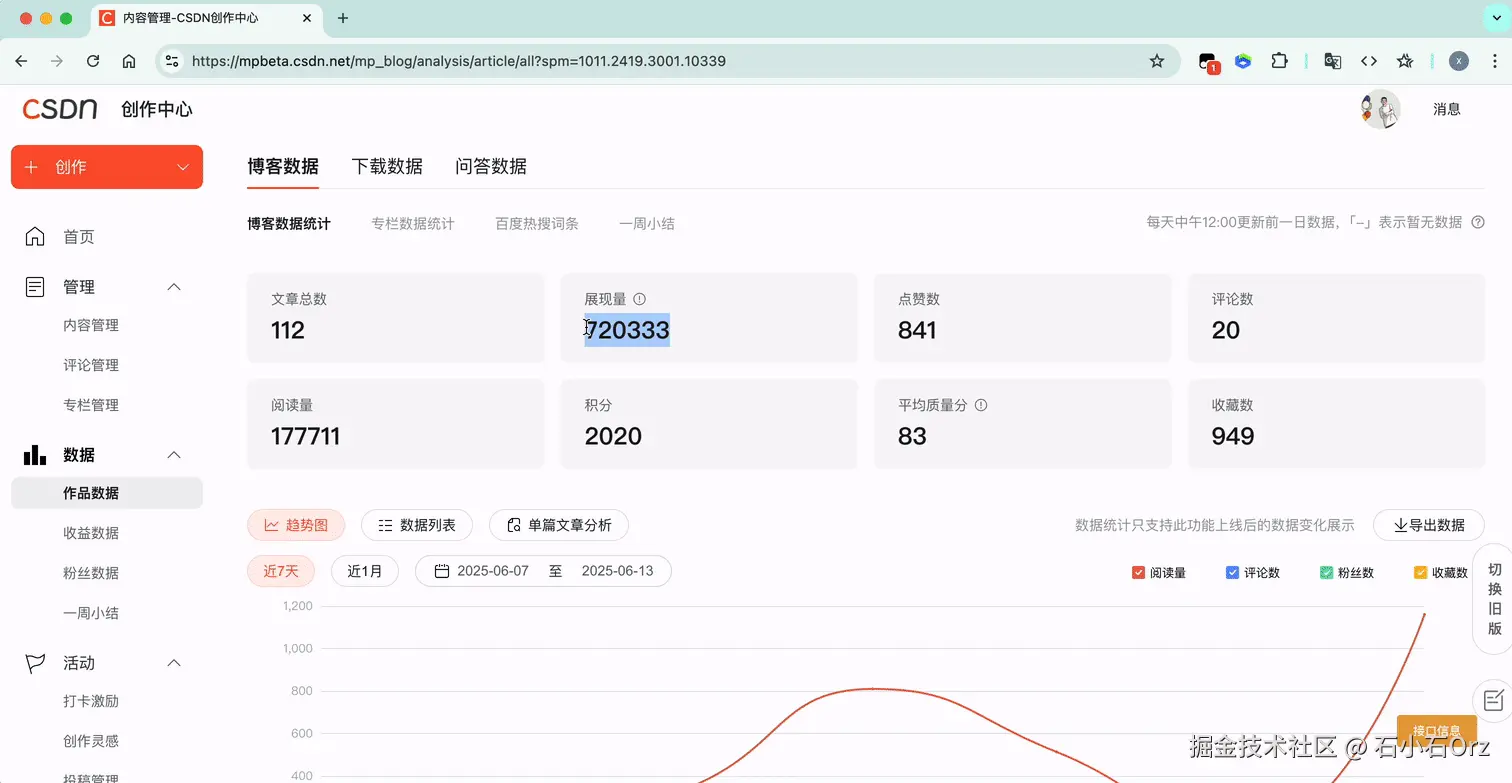

写了个脚本,发现CSDN的前端居然如此不严谨

引言

最近在折腾油猴脚本开发,顺手搞了一个可以拦截任意网页接口的小工具,并修改了CSDN的博客数据接口,成功的将文章总数和展现量进行了修改。

如果你不了解什是油猴,参考这篇文章:juejin.cn/book/751468…

然后我突然灵光一闪:

既然能拦截接口、篡改数据,那我为什么不顺便测试一下 CSDN 博客在极端数据下的表现呢?

毕竟我们平时开发的时候,测试同学各种花式挑刺,什么 null、undefined、999999、-1、空数组……

每次都能把页面测出一堆边角 bug。

今天,轮到我来当一回“灵魂测试”了!

用我的脚本,造几个极限场景,看看 CSDN 的前端到底稳不稳!

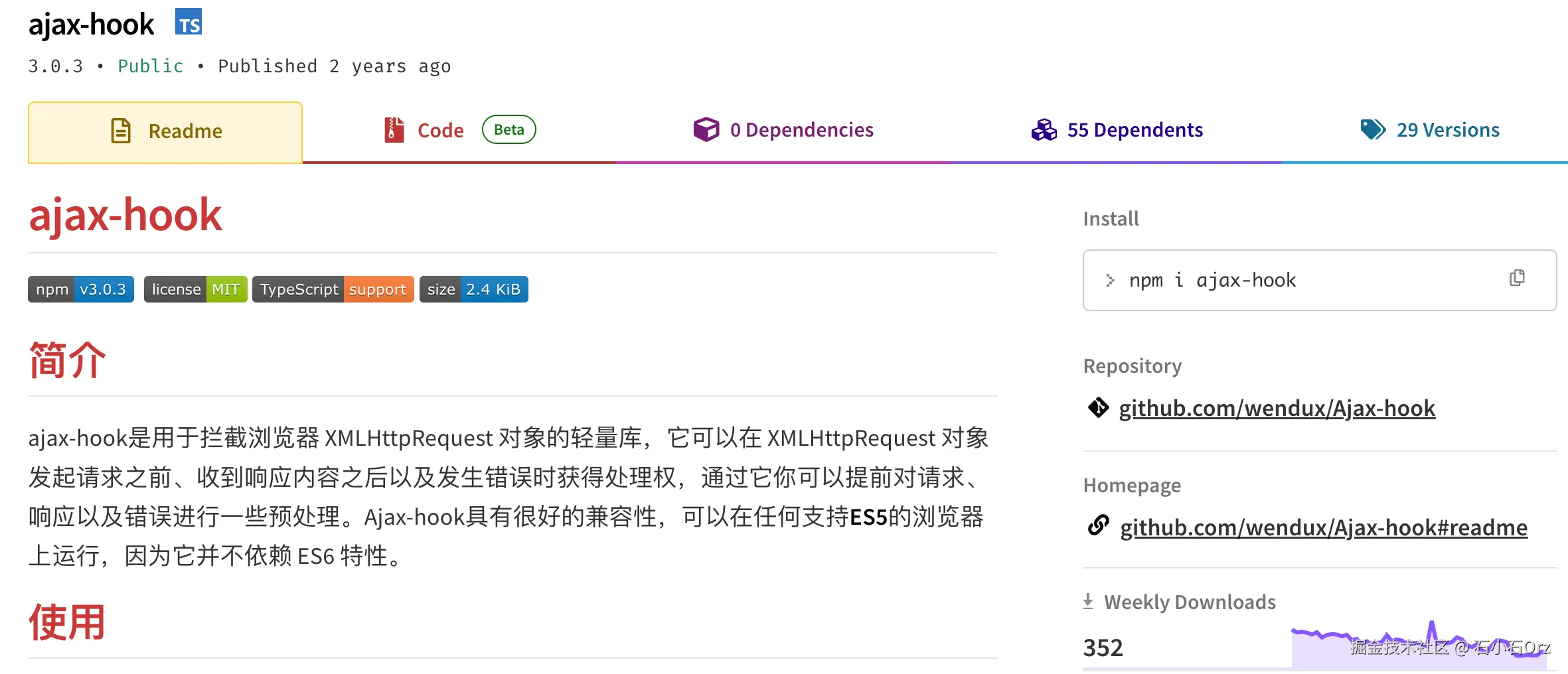

实现原理

其实原理并不复杂,核心就一句话:

借助油猴的脚本注入能力 + ajax-hook 对接口请求进行拦截和修改。

我们知道,大部分网页的数据接口都是通过 XMLHttpRequest 或 fetch 发起的,而 ajax-hook 就是一个开源的轻量工具,它能帮我们劫持原生的 XMLHttpRequest,在请求发出前、响应返回后进行自定义处理。

配合油猴脚本的注入机制,我们就可以实现在浏览器端伪造任意接口数据,用来调试前端样式、模拟数据异常、测试权限控制逻辑等等。

ajax-hook 快速上手

我们用的是 CDN 方式直接引入,简单暴力:

<script src="https://unpkg.com/ajax-hook@3.0.3/dist/ajaxhook.min.js"></script>

引入后,页面上会多出一个全局对象 ah,我们只需要调用 ah.proxy(),就可以注册一套钩子:

ah.proxy({

onRequest: (config, handler) => {

// 请求发出前

handler.next(config);

},

onError: (err, handler) => {

// 请求出错时

handler.next(err);

},

onResponse: (response, handler) => {

// 请求成功响应后

console.log("响应内容:", response.response);

handler.next(response);

}

});

拦截实现

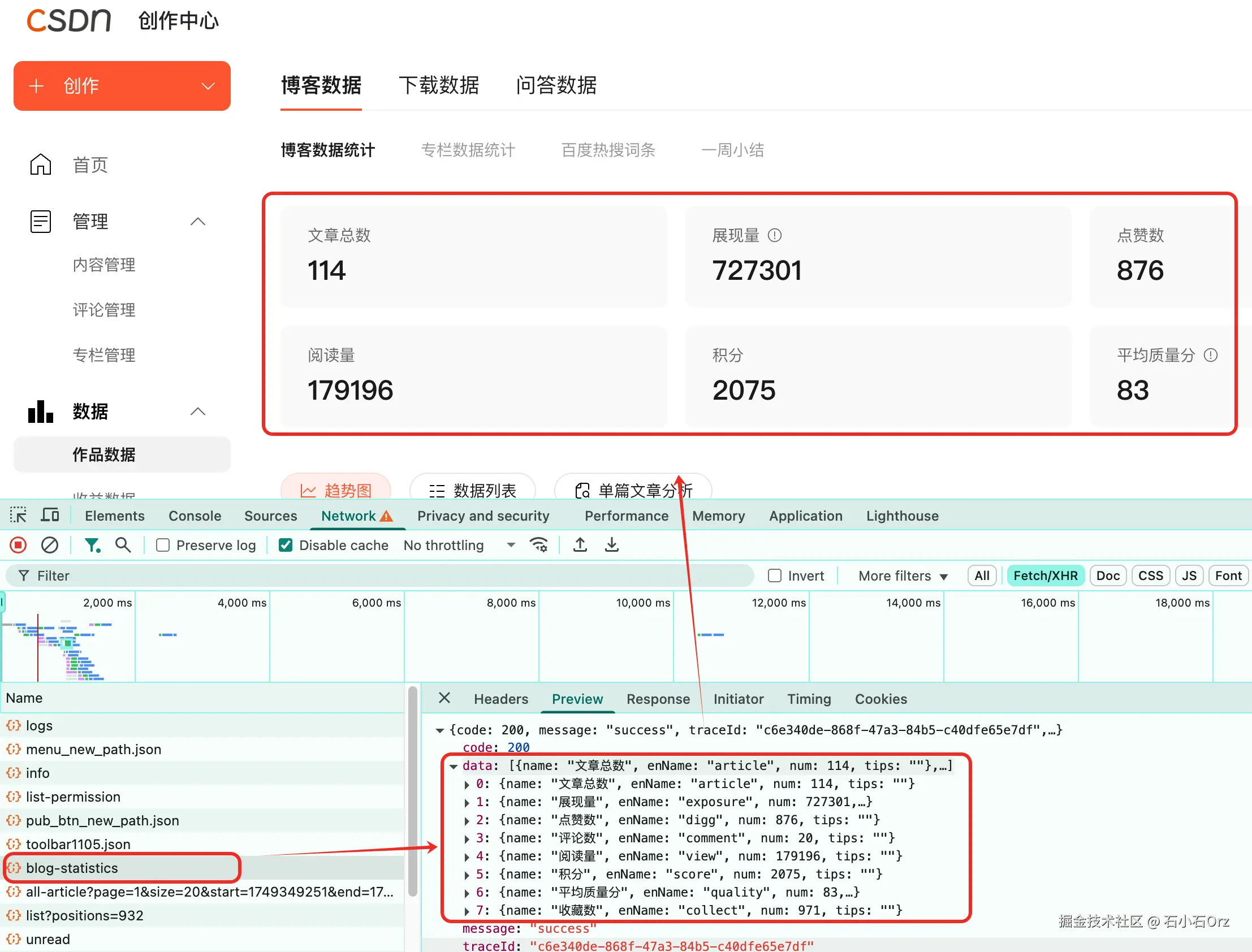

我们以 CSDN 博客后台为例,先找到博客数据接口

地址长这样:bizapi.csdn.net/blog/phoeni…

我们在 onResponse 钩子中,加入 URL 判断,专门拦截这个接口:

onResponse: (response, handler) => {

if (response.config.url.includes("https://bizapi.csdn.net/blog/phoenix/console/v1/data/blog-statistics")) {

const hookResponse = JSON.parse(response.response);

console.log("拦截到的数据:", hookResponse);

handler.next(response);

} else {

handler.next(response);

}

}

就这样,接口拦截器初步搭建完成!

使用油猴将脚本运行在网页

接下来我们用油猴把这段脚本注入到 CSDN 博客后台页面。

// ==UserScript==

// @name CSDN博客数据接口拦截

// @namespace http://tampermonkey.net/

// @version 0.0.1

// @description 拦截接口数据,验证极端情况下的样式展示

// @author 石小石Orz

// @match https://mpbeta.csdn.net/*

// @require https://unpkg.com/ajax-hook@3.0.3/dist/ajaxhook.min.js

// @run-at document-start

// @grant none

// ==/UserScript==

(function() {

'use strict';

ah.proxy({

onRequest: (config, handler) => {

handler.next(config);

},

onError: (err, handler) => {

handler.next(err);

},

onResponse: (response, handler) => {

console.log("接口响应列表:", response);

// 这里写拦截逻辑

handler.next(response);

}

});

})();

为了测试前端的容错能力,我们可以伪造一些极端数据返回:

- 文章总数设为

null - 展现量设为

0 - 点赞数设为一个异常大的值

onResponse: (response, handler) => {

if (response.config.url.includes("https://bizapi.csdn.net/blog/phoenix/console/v1/data/blog-statistics")) {

const hookResponse = JSON.parse(response.response);

// 伪造数据

hookResponse.data[0].num = null; // 文章总数

hookResponse.data[1].num = 0; // 展现量

hookResponse.data[2].num = 99999999999999999; // 点赞数

console.log("修改后的数据:", hookResponse);

response.response = JSON.stringify(hookResponse);

}

handler.next(response);

}

结果验证

修改成功后刷新页面,可以观察到如下问题:

- 文章总数为

null时,布局异常,显然缺乏空值判断。 - 点赞数为超大值 时,页面直接渲染出

100000000000000000,不仅视觉上溢出容器,连排版都崩了,前端没有做任何兼容处理。

CSDN的前端还是偷懒了呀,一点也不严谨!差评!

总结

通过这篇文章的示例,我们前端应该引以为戒,永远不要相信后端同学返回的数据,一定要做好容错处理!

通过本文,相信大家也明白了油猴脚本不仅是玩具,它在前端开发中其实是个非常实用的辅助工具!

如果你对油猴脚本的开发感兴趣,不妨看看我写的这篇教程 《油猴脚本实战指南》

从小脚本写起,说不定哪天你也能靠一个脚本搞出点惊喜来!

来源:juejin.cn/post/7519005878566748186

用 iframe 实现前端批量下载的优雅方案 —— 从原理到实战

传统的下载方式如window.open()或标签点击存在诸多痛点:

- 批量下载时浏览器会疯狂弹窗

- HTTPS页面下载HTTP资源被拦截

今天分享的前端iframe批量下载方案,可以有效解决以上问题。

一、传统批量下载方案的局限性

传统的批量下载方式通常是循环创建 a 标签并触发点击事件:

urls.forEach(url => {

const link = document.createElement('a');

link.href = url;

link.download = 'filename';

document.body.appendChild(link);

link.click();

document.body.removeChild(link);

});

这种方式存在以下问题:

- 浏览器会限制连续的自动点击行为

- 用户体验不佳,会弹出多个下载对话框

二、iframe 批量下载解析

更优雅的解决方案是使用 iframe 技术,通过动态创建和移除 iframe 元素来触发下载:

downloadFileBatch(url) {

const iframe = document.createElement('iframe');

iframe.style.display = 'none';

iframe.style.height = '0';

iframe.src = this.urlProtocolDelete(url);

document.body.appendChild(iframe);

setTimeout(() => {

iframe.remove();

}, 5000);

}

urlProtocolDelete(url: string = '') {

if (!url) {

return;

}

return url.replace('http://', '//').replace('https://', '//');

}

这种方案的优势在于:

- 不依赖用户交互,可自动触发下载

- 隐藏 iframe 不会影响页面布局,每个iframe独立运行,互不干扰

- 主线程保持流畅

三、核心代码实现解析

让我们详细分析一下这段代码的工作原理:

- 动态创建 iframe 元素:

const iframe = document.createElement('iframe');

iframe.style.display = 'none';

iframe.style.height = '0';

通过创建一个不可见的 iframe 元素,我们可以在不影响用户界面的情况下触发下载请求。

- 协议处理函数:

urlProtocolDelete(url: string = '') {

return url.replace('http://', '//').replace('https://', '//');

}

这个函数将 URL 中的协议部分替换为//,这样可以确保在 HTTPS 页面中请求 HTTP 资源时不会出现混合内容警告。

- 触发下载并清理 DOM:

iframe.src = this.urlProtocolDelete(url);

document.body.appendChild(iframe);

setTimeout(() => {

iframe.remove();

}, 5000);

将 iframe 添加到 DOM 中会触发浏览器对 src 的请求,从而开始下载文件。设置 5 秒的超时时间后移除 iframe,既保证了下载有足够的时间完成,又避免了 DOM 中积累过多无用元素。

四、批量下载的实现与优化

对于多个文件的批量下载,可以通过循环调用 downloadFileBatch 方法:

result.forEach(item => {

this.downloadFileBatch(item.url);

});

五、踩坑+注意点

在实现批量下载 XML 文件功能时,你可能会遇到这种情况:明明请求的 URL 地址无误,服务器也返回了正确的数据,但文件却没有被下载到本地,而是直接在浏览器中打开预览了。这是因为 XML 作为一种可读的文本格式,浏览器默认会将其视为可直接展示的内容,而非需要下载保存的文件。

解决方案:

通过在下载链接中添加response-content-disposition=attachment参数,可以强制浏览器将 XML 文件作为附件下载,而非直接预览。这个参数会覆盖浏览器的默认行为,明确告诉浏览器 "这是一个需要下载保存的文件"。

addDownloadDisposition(url: string, filename: string): string {

try {

const urlObj = new URL(url);

// 添加 response-content-disposition 参数

const disposition = `attachment;filename=${encodeURIComponent(filename)}`;

urlObj.searchParams.set('response-content-disposition', disposition);

return urlObj.toString();

} catch (error) {

console.error('URL处理失败:', error);

return url;

}

}

六、大量文件并发控制

有待补充

来源:juejin.cn/post/7524627104580534306

😡同事查日志太慢,我现场教他一套 grep 组合拳!

前言

最近公司来了个新同事,年轻有活力,就是查日志的方式让我有点裂开。

事情是这样的:他写的代码在测试环境报错了,报警信息也被钉钉机器人发到了我们群里。作为资深摸鱼战士,我寻思正好借机摸个鱼顺便指导一下新人,就凑过去看了眼。

结果越看我越急,差点当场喊出:“兄弟你是来写代码的,还是和日志谈恋爱的?”

来看看他是怎么查日志的

他先敲了一句:

tail -f a.log | grep "java.lang.NullPointerException"

想着等下次报错就能立刻看到。等了半天,终于蹦出来一行:

2025-07-03 11:38:48.339 [http-nio-8960-exec-1] [47gK4n32jEYvTYX8AYti48] [INFO] [GlobalExceptionHandler] java.lang.NullPointerException, ex: java.lang.NullPointerException

java.lang.NullPointerException: null

我提醒他:“这样看不到堆栈信息啊。”

他“哦”了一声,灵机一动,用 vi把整个文件打开,/NullPointerException 搜关键词,一个 n 一个 n 地翻……半分钟过去了,异常在哪都没找全,我都快给他跪下了。

于是我当场掏出了一套我压箱底的“查日志组合拳”,一招一式手把手教他。他当场就“悟了”,连连称妙,并表示想让我写成文章好让他发给他前同事看——因为他前同事也是这样查的……

现在,这套组合拳我也分享给你,希望你下次查日志的时候,能让你旁边的同事开开眼。

正式教学

核心的工具其实还是 grep 命令,下面我将分场景给你讲讲我的实战经验,保证你能直接套用!

场景一:查异常堆栈,不能只看一行!

Java 异常堆栈通常都是多行的,仅仅用 grep "NullPointerException" 只能看到最上面那一行,问题根源在哪你压根找不到。

这时候使用 **grep** 的 **-A** (After) 参数来显示匹配行之后的N行。

# 查找 NullPointerException,并显示后面 50 行

grep -A 50 "java.lang.NullPointerException" a.log

如果你发现异常太多,屏幕一闪而过,也可以用less加上分页查看:

grep -A 50 "java.lang.NullPointerException" a.log | less

在 less 视图中,你可以:

- 使用 箭头↑↓ 或 Page Up/Down 键来上下滚动

- 输入

G直接翻到末尾,方便快速查看最新的日志 - 输入

/Exception继续搜索 - 按

q键退出

这样你就能第一时间拿到完整异常上下文信息,告别反复 vi + / 的低效操作!

场景二:实时看新日志怎么打出来的

如果你的应用正在运行,并且你怀疑它会随时抛出异常,你可以实时监控日志文件的增长。

使用 tail -f 结合 grep:

# 实时监控 a.log 文件的新增内容,并只显示包含 "java.lang.NullPointerException" 的行及其后50行

tail -f a.log | grep -A 50 "java.lang.NullPointerException"

只要异常一出现,它就会自动打出来,堆栈信息也一并送到你面前!

- 想停下?

Ctrl + C - 想更准确?加

-i忽略大小写,防止大小写拼错找不到

场景三:翻历史日志 or 查压缩日志

服务器上的日志一般都会按天或按大小分割并压缩,变成 .log.2025-07-02.gz 这种格式,查找这些文件的异常信息怎么办?

🔍 查找当前目录所有 .log 文件:

# 在当前目录下查找所有以 .log 结尾的文件,-H 参数可以顺便打印出文件名

grep -H -A 50 "java.lang.NullPointerException" *.log

其中 -H 会帮你打印出是哪个文件中出现的问题,防止你找完还不知道是哪天的事。

🔍 查找 .gz 文件(压缩日志):

zgrep -H -A 50 "java.lang.NullPointerException" *.gz

zgrep 是专门处理 .gz 的 grep,它的功能和 grep 完全一样,无需手动解压,直接开整!

场景四:统计异常数量(快速判断异常是否频繁)

有时候你需要知道某个异常到底出现了多少次,是偶发还是成灾,使用 grep -c(count):

grep -c "java.lang.NullPointerException" a.log

如果你要统计所有日志里的数量:

grep -c "java.lang.NullPointerException" *.log

其他常用的 grep 参数

| 参数 | 作用 |

|---|---|

-B N | 匹配行之前的 N 行(Before) |

-A N | 匹配行之后的 N 行(After) |

-C N | 匹配行上下共 N 行(Context) |

-i | 忽略大小写 |

-H | 显示匹配的文件名 |

-r | 递归搜索目录下所有文件 |

比如:

grep -C 25 "java.lang.NullPointerException" a.log

这个命令就能让你一眼看到异常前后的上下文,帮助定位代码逻辑是不是哪里先出问题了。

尾声

好了,这套组合拳我已经传授给你了,要是别人问你在哪学的,记得报我杆师傅的大名(doge)。

其实还有其他查日志的工具,比如awk、wc 等。

但是我留了一手,没有全部教给我这个同事,毕竟江湖规则,哪有一出手就把看家本领全都交出去的道理?

如果你也想学,先拜个师交个学费(点赞、收藏、关注),等学费凑够了,我下次再开新课,传授给大家~

来源:juejin.cn/post/7524216834619408430

为什么我不再相信 Tailwind?三个月重构项目教会我的事

Tailwind 曾经是我最爱的工具,直到它让我维护不下去整个项目。

前情提要:我是如何变成 Tailwind 重度用户的

作为一个多年写 CSS 的前端,我曾经深陷“命名地狱”:

什么 .container-title, .btn-primary, .form-item-error,一个项目下来能写几百个类名,然后改样式时不知道该去哪动刀,甚至删个类都心慌。

直到我遇见了 Tailwind CSS——一切原子化,想改样式就加 class,别管名字叫什么,直接调属性即可。

于是我彻底拥抱它,团队项目里我把所有 SCSS 全部清除,组件中也只保留了 Tailwind class,一切都干净、轻便、高效。

但故事从这里开始转变。

三个月后的重构期,我被 Tailwind“反噬”

我们的后台管理系统迎来一次大版本升级,我负责重构 UI 样式逻辑,目标是:

- 统一设计规范;

- 提高代码可维护性;

- 降低多人协作时的样式冲突。

刚开始我信心满满,毕竟 Tailwind 提供了:

- 原子化 class;

@apply合成组件级 class;- 配置主题色/字体/间距系统;

- 插件支持动画/form 控件/typography;

但随着项目深入,我开始发现 几个巨大的问题,并最终决定停用 Tailwind。

一、class 污染:结构和样式纠缠成灾

来看一个真实例子:

<div class="flex items-center justify-between bg-white p-4 rounded-lg shadow-sm border border-gray-200">

<h2 class="text-lg font-semibold text-gray-800">订单信息</h2>

<button class="text-sm px-2 py-1 bg-blue-500 text-white rounded hover:bg-blue-600">编辑</button>

</div>

你能看出这个组件的“设计意图”吗?

你能快速改它的样式吗?

一个看似简单的按钮,一眼看不到设计语言,只看到一坨 class,你根本不知道:

px-2 py-1是从哪里决定的?bg-blue-500是哪个品牌色?hover:bg-blue-600是统一交互吗?

Tailwind 让样式变得快,但也让样式“变得不可读”。

二、复用失败:想复用样式还得靠 SCSS