招行2面:为什么需要序列化和反序列?为什么不能直接使用对象?

Hi,你好,我是猿java。

工作中,我们经常听到序列化和反序列化,那么,什么是序列化?什么又是反序列化?这篇文章,我们来分析一个招商的面试题:为什么需要序列化和反序列化?

1. 什么是序列化和反序列化?

简单来说,序列化就是把一个Java对象转换成一系列字节的过程,这些字节可以被存储到文件、数据库,或者通过网络传输。反过来,反序列化则是把这些字节重新转换成Java对象的过程。

想象一下,你有一个手机应用中的用户对象(比如用户的名字、年龄等信息)。如果你想将这个用户对象存储起来,或者发送给服务器,你就需要先序列化它。等到需要使用的时候,再通过反序列化把它恢复成原来的对象。

2. 为什么需要序列化?

“为什么需要序列化?为什么不能直接使用对象呢?”这确实是一个好问题,而且很多工作多年的程序员不一定能回答清楚。综合来看:需要序列化的主要原因有以下三点:

- 持久化存储:当你需要将对象的数据保存到磁盘或数据库中时,必须把对象转换成一系列字节。

- 网络传输:在分布式系统中,不同的机器需要交换对象数据,序列化是实现这一点的关键。

- 深拷贝:有时候需要创建对象的副本,序列化和反序列化可以帮助你实现深拷贝。

更直白的说,序列化是为了实现持久化和网络传输,对象是应用层的东西,不同的语言(比如:java,go,python)创建的对象还不一样,实现持久化和网络传输的载体不认这些对象。

3. 序列化的原理分析

Java中的序列化是通过实现java.io.Serializable接口来实现的。这个接口是一个标记接口,意味着它本身没有任何方法,只是用来标记这个类的对象是可序列化的。

当你序列化一个对象时,Java会将对象的所有非瞬态(transient)和非静态字段的值转换成字节流。这包括对象的基本数据类型、引用类型,甚至是继承自父类的字段。

序列化的步骤

- 实现

Serializable接口:你的类需要实现这个接口。 - 创建

ObjectOutputStream:用于将对象转换成字节流。 - 调用

writeObject方法:将对象写入输出流。 - 关闭流:别忘了关闭流以释放资源。

反序列化的步骤大致相同,只不过是使用ObjectInputStream和readObject方法。

4. 示例演示

让我们通过一个简单的例子来看看实际操作是怎样的。

定义一个可序列化的类

import java.io.Serializable;

public class User implements Serializable {

private static final long serialVersionUID = 1L; // 推荐定义序列化版本号

private String name;

private int age;

private transient String password; // transient字段不会被序列化

public User(String name, int age, String password) {

this.name = name;

this.age = age;

this.password = password;

}

// 省略getter和setter方法

@Override

public String toString() {

return "User{name='" + name + "', age=" + age + ", password='" + password + "'}";

}

}

序列化对象

import java.io.FileOutputStream;

import java.io.IOException;

import java.io.ObjectOutputStream;

public class SerializeDemo {

public static void main(String[] args) {

User user = new User("Alice", 30, "secret123");

try (FileOutputStream fileOut = new FileOutputStream("user.ser");

ObjectOutputStream out = new ObjectOutputStream(fileOut)) {

out.writeObject(user);

System.out.println("对象已序列化到 user.ser 文件中.");

} catch (IOException i) {

i.printStackTrace();

}

}

}

运行上述代码后,你会发现当前目录下生成了一个名为user.ser的文件,这就是序列化后的字节流。

反序列化对象

import java.io.FileInputStream;

import java.io.IOException;

import java.io.ObjectInputStream;

public class DeserializeDemo {

public static void main(String[] args) {

User user = null;

try (FileInputStream fileIn = new FileInputStream("user.ser");

ObjectInputStream in = new ObjectInputStream(fileIn)) {

user = (User) in.readObject();

System.out.println("反序列化后的对象: " + user);

} catch (IOException | ClassNotFoundException i) {

i.printStackTrace();

}

}

}

运行这段代码,你会看到输出:

反序列化后的对象: User{name='Alice', age=30, password='null'}

注意到password字段为空,这是因为它被声明为transient,在序列化过程中被忽略了。

5. 常见问题与注意事项

serialVersionUID是干嘛的?

serialVersionUID是序列化时用来验证版本兼容性的一个标识符。如果你不显式定义它,Java会根据类的结构自动生成。但为了避免类结构变化导致序列化失败,建议手动定义一个固定的值。

继承关系中的序列化

如果一个类的父类没有实现Serializable接口,那么在序列化子类对象时,父类的字段不会被序列化。反序列化时,父类的构造函数会被调用初始化父类部分。

处理敏感信息

使用transient关键字可以防止敏感信息被序列化,比如密码字段。此外,你也可以自定义序列化逻辑,通过实现writeObject和readObject方法来更精细地控制序列化过程。

6. 总结

本文,我们深入浅出地探讨了Java中的序列化和反序列化,从基本概念到原理分析,再到实际的代码示例,希望你对这两个重要的技术点有了更清晰的理解。

为什么需要序列化和反序列化?

最直白的说,如果不进行持久化和网络传输,根本不需要序列化和反序列化。如果需要实现持久化和网络传输,就必须序列化和反序列化,因为对象是应用层的东西,不同的语言(比如:java,go,python)创建的对象还不一样,实现持久化和网络传输的载体根本不认这些对象。

7. 交流学习

最后,把猿哥的座右铭送给你:投资自己才是最大的财富。 如果你觉得文章有帮助,请帮忙转发给更多的好友,或关注公众号:猿java,持续输出硬核文章。

来源:juejin.cn/post/7499078331708932134

vue文件自动生成路由会成为主流

vue-router悄悄发布了5.0版本,用官方的话说,V5 是一个过渡版本,它将unplugin-vue-router(基于文件的路由)合并到了核心包中,就是说V5版本直接支持基于文件自动生成路由了,无需再引入unplugin-vue-router。

这一变化标志着前端开发模式的一个重要转折点。过去,开发者需要手动定义路由配置,这种方式虽然灵活,但随着项目规模增大,维护成本也随之增加。现在,Vue Router 5.0内置了基于文件的路由系统,使得路由管理变得更加直观和高效。

传统路由配置与基于文件路由的对比

在传统的Vue Router使用方式中,我们需要手动创建路由:

import { createRouter, createWebHistory } from "vue-router";

import Home from "./views/Home.vue";

import About from "./views/About.vue";

const routes = [

{

path: "/",

name: "home",

component: Home,

},

{

path: "/about",

name: "about",

component: About,

},

];

const router = createRouter({

history: createWebHistory(),

routes,

});

而基于文件的路由系统允许我们通过目录结构自动生成路由,例如:

src/

├── pages/

│ ├── index.vue # -> /

│ ├── about.vue # -> /about

│ ├── user/

│ │ └── index.vue # -> /user

│ └── user-[id].vue # -> /user/:id

无需手动创建,直接导入即可:

import { routes } from "vue-router/auto-routes";

const router = createRouter({

history: createWebHistory(),

routes,

});

省去了手动定义路由的繁琐步骤。

基于文件路由的优势

- 减少样板代码:无需手动编写大量路由配置

- 约定优于配置:通过文件名和目录结构确定路由路径

- 提高开发效率:添加新页面只需创建对应文件

- 易于维护:路由结构一目了然,便于团队协作

- 类型化路由: 使用ts能够获得更好的提示,比如

router.push(xxx)现在会有提示了

缺点

- 路由的

meta等额外数据必须在.vue文件使用definePage或route标签声明,点此查看教程 - 增加了额外的学习成本

快速入门

安装

pnpm add vue-router@5

vite.config.ts

import VueRouter from "vue-router/vite";

export default defineConfig({

plugins: [

VueRouter({

dts: "typed-router.d.ts",

}),

// ⚠️ Vue must be placed after VueRouter()

Vue(),

],

});

tsconfig.json

// tsconfig.json

{

"include": [ "typed-router.d.ts" ],

"vueCompilerOptions": {

"plugins": [

"vue-router/volar/sfc-typed-router",

"vue-router/volar/sfc-route-blocks"

]

}

}

src/router/index.ts

import { createRouter, createWebHistory } from "vue-router";

import { routes, handleHotUpdate } from "vue-router/auto-routes";

export const router = createRouter({

history: createWebHistory(),

routes,

});

// This will update routes at runtime without reloading the page

if (import.meta.hot) {

handleHotUpdate(router);

}

详细的路由生成规则

根据官方文档,基于文件的路由系统有以下具体规则:

索引路由:任何 index.vue 文件(必须全小写)将生成空路径,类似于 index.html 文件:

src/pages/index.vue生成/路由src/pages/users/index.vue生成/users路由

嵌套路由:当在同一层级同时存在同名文件夹和 .vue 文件时,会自动生成嵌套路由。例如:

src/pages/

├── users/

│ └── index.vue

└── users.vue

这将生成如下路由配置:

const routes = [

{

path: "/users",

component: () => import("src/pages/users.vue"),

children: [

{ path: "", component: () => import("src/pages/users/index.vue") },

],

},

];

不带布局嵌套的路由:有时候你可能想在URL中添加斜杠形式的嵌套,但不想影响UI层次结构。可以使用点号(.)分隔符:

src/pages/

├── users/

│ ├── [id].vue

│ └── index.vue

└── users.vue

要添加 /users/create 路由而不将其嵌套在 users.vue 组件内,可以创建 src/pages/users.create.vue 文件,. 会被转换为 /:

const routes = [

{

path: "/users",

component: () => import("src/pages/users.vue"),

children: [

{ path: "", component: () => import("src/pages/users/index.vue") },

{ path: ":id", component: () => import("src/pages/users/[id].vue") },

],

},

{

path: "/users/create",

component: () => import("src/pages/users.create.vue"),

},

];

路由组:有时候需要组织文件结构而不改变URL。路由组允许你逻辑性地组织路由,不影响实际URL:

src/pages/

├── (admin)/

│ ├── dashboard.vue

│ └── settings.vue

└── (user)/

├── profile.vue

└── order.vue

生成的URL:

/dashboard-> 渲染src/pages/(admin)/dashboard.vue/settings-> 渲染src/pages/(admin)/settings.vue/profile-> 渲染src/pages/(user)/profile.vue/order-> 渲染src/pages/(user)/order.vue

命名视图:可以通过在文件名后附加 @ + 名称来定义命名视图,如 src/pages/index@aux.vue 将生成:

{

path: '/',

component: {

aux: () => import('src/pages/index@aux.vue')

}

}

默认情况下,未命名的路由被视为 default,即使有其他命名视图也不需要将文件命名为 index@default.vue。

动态路由:使用方括号语法定义动态参数:

[id].vue->/users/:id[category]-details.vue->/electronics-details[...all].vue-> 通配符路由/all/*

对开发工作流的影响

这一变化将显著改变Vue应用的开发流程:

- 新功能页面的添加变得更加简单

- 团队成员更容易理解项目的路由结构

- 减少了因手动配置错误导致的路由问题

- 更好的IDE集成和自动补全支持

迁移策略

对于现有项目,Vue Router 5.0提供了平滑的迁移路径:

- 旧的路由配置方式依然有效

- 可以逐步采用基于文件的路由

- 混合使用两种方式以适应不同场景

配置选项和高级功能

Vue Router 5.0的基于文件路由系统提供了丰富的配置选项,可以根据项目需求进行定制:

自定义路由目录:默认情况下,系统会在 src/pages 目录中查找 .vue 文件,但可以通过配置更改此行为。

命名路由:所有生成的路由都会自动获得名称属性,避免意外将用户引导至父路由。默认情况下,名称使用文件路径生成,但可以通过自定义 getRouteName() 函数覆盖此行为。

类型安全:系统会自动生成类型声明文件(如 typed-router.d.ts),提供几乎无处不在的 TypeScript 验证。

配置示例:

// vite.config.js

import { defineConfig } from "vite";

import vue from "@vitejs/plugin-vue";

import VueRouter from "unplugin-vue-router/vite";

export default defineConfig({

plugins: [

VueRouter({

routesFolder: "src/pages", // 自定义路由目录

extensions: [".vue"], // 指定路由文件扩展名

dts: "typed-router.d.ts", // 生成类型声明文件

importMode: (filename) => "async", // 自定义导入模式

}),

vue(),

],

});

实际应用建议

在实际项目中采用基于文件的路由时,建议遵循以下最佳实践:

- 清晰的目录结构:保持一致的目录结构,便于团队成员理解

- 有意义的文件名:使用描述性的文件名,使路由意图明确

- 合理使用路由组:利用路由组组织相关的页面,而不影响URL结构

- 渐进式采用:对于大型项目,可以逐步迁移部分路由到新的系统

总结

Vue Router 5.0引入的基于文件的路由系统代表了前端开发模式的重要演进。它将 Nuxt.js 等框架成功的路由理念整合到了 Vue 的核心生态中,使开发者能够以更简洁、更直观的方式管理应用路由。

这一变化不仅减少了样板代码,提高了开发效率,还促进了更一致的项目结构。随着更多开发者采用这一新模式,我们可以期待看到更高质量、更易维护的 Vue 应用程序出现,这将为整个前端社区带来积极的影响。

来源:juejin.cn/post/7610253888646119467

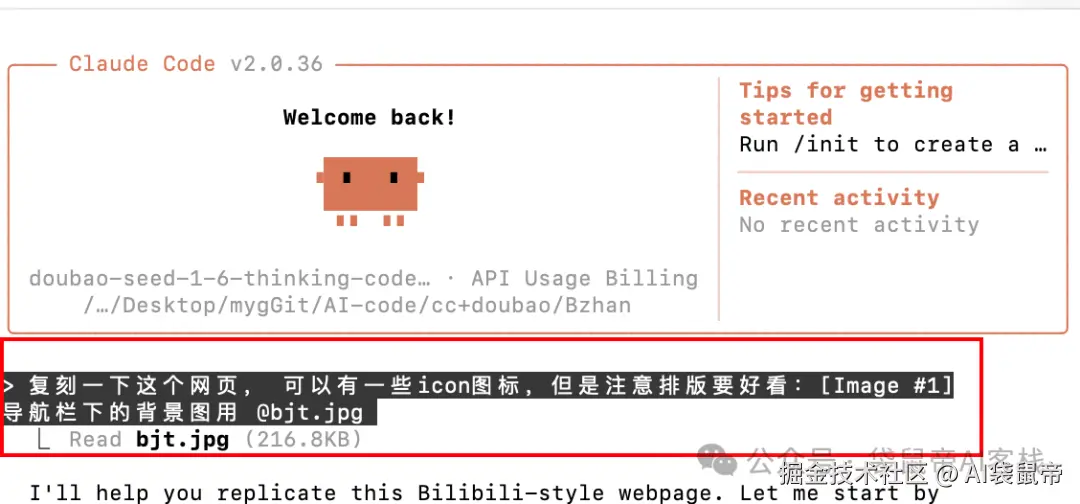

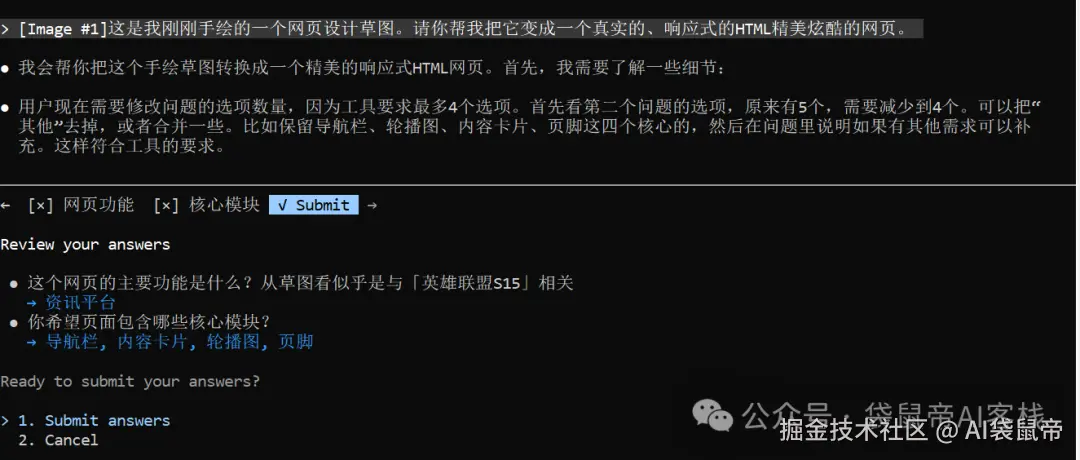

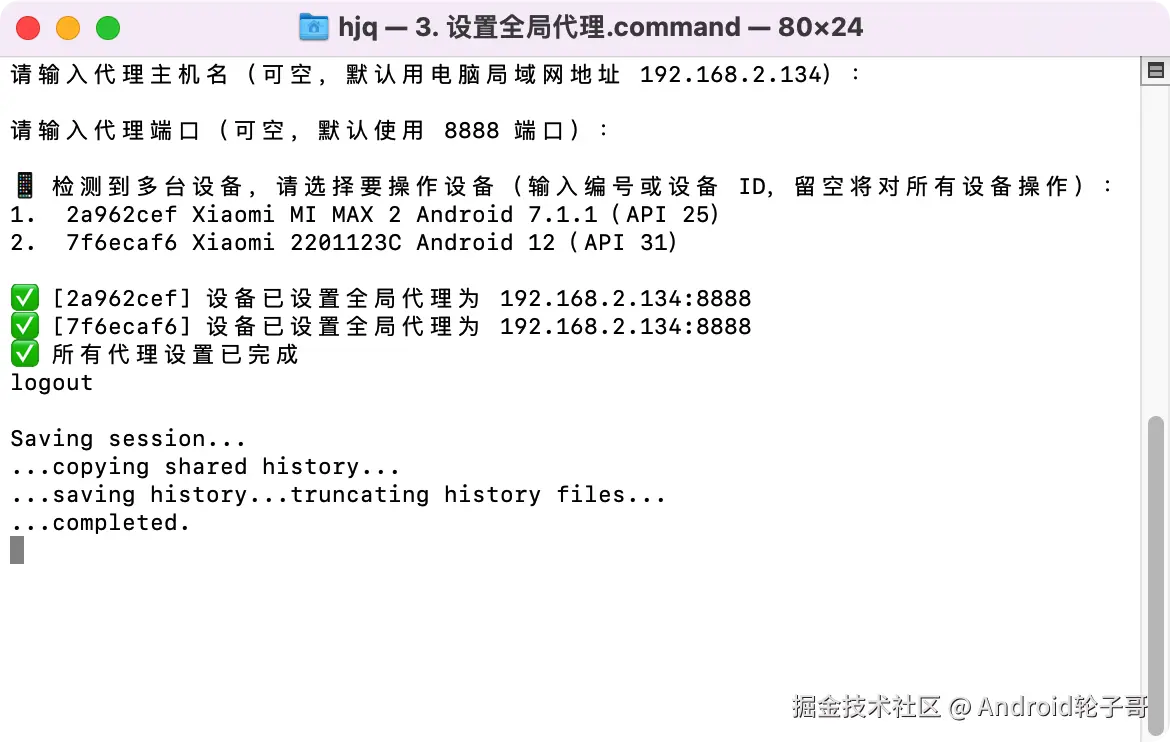

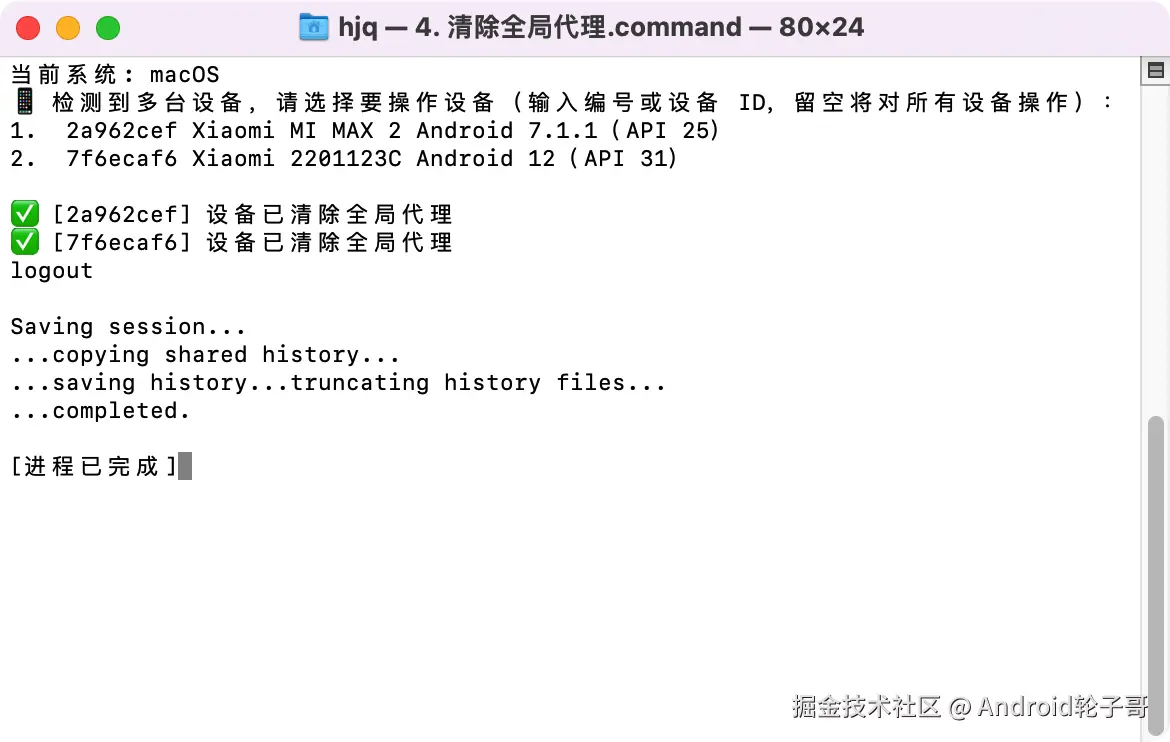

🦞OpenClaw 让 MacMini 脱销了,而我拿出了6年陈的安卓机

前言

OpenClaw 作为 AI 界 2026 年的新宠,第一波受益的居然是 Mac Mini,原因是 Mac Mini 功耗低,适合 7x24 小时运行。这就让我很不李姐,作为一个十年 Linux 手,我坚信只要能运行 Linux 的设备上就可以运行 OpenClaw。像树莓派这种小众玩具就算了,我们的安卓手机也完全可以,这手机不比 Mac Mini 的功耗低吗,而且手机自带 UPS+移动网络,即使你家断电断网,都不影响 OpenClaw 为你干活。

好巧不巧我的 2019 年的包浆三星,昨晚音量键也坏了,这是完全没法用了,但是我觉得它的处理器还能打,这不正好适合干这个吗。

当我在安卓手机上安装了 Termux(终端模拟器) + nodejs + cmake 等古法炼丹的组件之后,意外发现这是 AI 时代了,GitHub 上已经有一个完善的项目openclaw-termux,它不仅提供了基于 Termux 环境的安装指令,还提供了一个 Flutter App,大大降低了安装门槛。下面将一步步介绍我的安装过程。

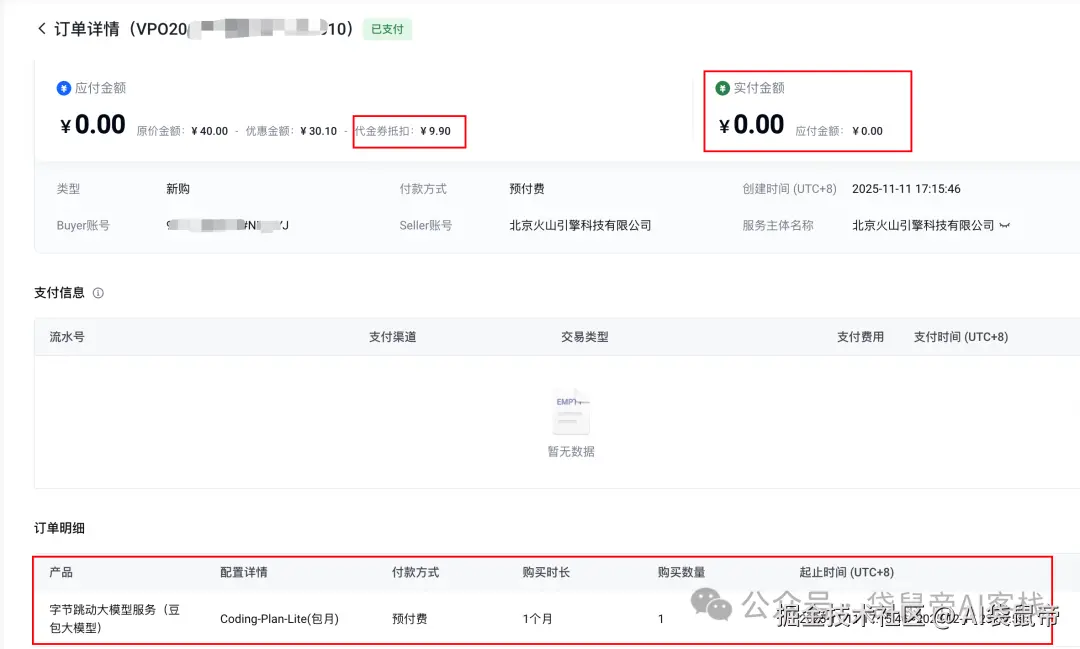

Step 0:准备工作

0.1 准备大模型API key

我选用的是 MiniMax,CodingPlan 可以无限 token 使用,实名认证之后也可以获得体验额度。

点击链接获得 CodingPlan 9 折优惠 platform.minimaxi.com/subscribe/c…

注意这里有两种 key,上面的接口密钥是消耗余额和体验券的,点击“创建新的 API key”。有CodingPlan的朋友点击“重置并复制”使用下面的key。

0.2 创建聊天机器人

我用的是飞书,这个创建操作流程较长,没有操作过的朋友直接转到文末参考附录:创建飞书聊天机器人

0.3 安装 OpenClaw 安卓 App

安装之后打开 App,就进入了下面的界面。因为许多访问地址都是国外的,所以建议安装过程挂🪜,会比较顺利。这个界面视网络情况,可能需要等待比较久时间,我大概花了 15 分钟。 期间尽量让 app 保持在前台,防止被杀掉。

后面完成后会有两个可选安装项,不懂可以跳过。

Step 1:运行配置向导

第一段是风险提示,默认选项是“No”,我们点下面的⬅️按钮选到“Yes”,并在键盘按“↩︎”键

继续选择“QuickStart”,就来到最关键的模型配置了。

1.1 Model 模型配置

国内的供应商可选的有 MiniMax 和 DeepSeek。MiniMax 可以看到专门的选项,但是 DeepSeek 没有,因为 DeepSeek 执行了 OpenAI 的标准,因此我们可以用 OpenAI 或者 Custom 选兼容 OpenAI 的方式。

关于这两个平台的对比,可以参考下图:

这里我选择了 MiniMax,第二个 auth method 不要选 Oauth。然后提示输入 MiniMax 后台的 API key。模型选择见下图,建议使用-cn 后缀的,利于国内访问。

1.2 Channel 会话频道配置

完成模型配置就来到了 Channel 配置,这里的 Channel 是指用什么即时通讯工具与 OpenClaw 交互,国内的只有飞书。我们就选飞书。

题外话是飞书的配置属于较复杂的,如果有条件优先使用 Telegram会比较简单。

这里就需要输入飞书的 AppID 以及 Secret 了。后文会介绍如何创建飞书机器人。

1.3 Skill技能配置

配置完 Channel 之后,就来到了 Skills,建议配置 mcporter,MCP好比 OpenClaw 的手臂,能大大增强它做事的能力。其余技能按需即可。

这里会有一些配置API KEY 的提示,通通选 No 即可,如果有需求,可以后配。

再然后看到这个界面就告诉你配置结束了。

Step 2:仪表盘界面

这个仪表盘界面最重要的功能是管理Gateway的状态,只有当Gateway运行状态时,OpenClaw 才可以正常工作。因此这里要点击“Start Gateway”。

然后我们看到绿色的“运行中”就万事毕备了。

Step 3:工作节点配置

点击 Node 进入工作节点配置,点击 Enable,会提示你进行各种授权,这也意味着 OpenClaw 可以接管你手机的相关能力,比如拍照,这都属于敏感操作,一定要想清楚再开。

Step 4:飞书后台设置事件回调

如果你这个时候迫不及待的去找机器人聊天,你会发现连输入框都没有。我们需要继续配置事件回调。

选择使用长连接接收事件:

可以看到添加事件按钮由原来的灰色不可点击变为可点击:

添加接收消息事件:

给应用开通获取通讯录基本信息的权限:

重新发布版本:

跟前面的步骤一样,发布为在线应用即可。

现在可以看到飞书机器人有输入框了!

但是如果你发消息给机器人,会收到一条配对提示

我们找到with:后面那一行指令到 OpenClaw App 主界面的Terminal中执行。这是唯一需要输入命令的地方。

openclaw pairing approve feishu A5T7L53A

附录:创建飞书聊天机器人

1. 来到飞书开发者后台

飞书开放平台地址:

没有飞书账号的,需要自己注册账号

点击右上角进入开发者后台:

2. 创建应用

3. 填写应用信息

4. 获取自己的应用凭证

5. 给应用添加机器人

6. 给应用配置权限

把即时通讯相关的权限全部开通:

7. 创建版本并发布

如果当前账号不是管理员会多一个审批流程。

来源:juejin.cn/post/7611386394679459874

为什么Django这么慢,却还是Python后端第一梯队呢?

学习Web框架的Python玩家大多应该都听过:Django 性能不行”、“高并发场景根本用不了 Django”。但有趣的是,在TIOBE、PyPI下载量、企业技术栈选型中,Django始终稳居Python后端框架第一梯队,甚至是很多公司的首选。

这背后的矛盾,恰恰折射出工业级开发的核心逻辑:性能从来不是唯一的衡量标准,生产力和工程化能力才是。

一、先澄清:Django 的“慢”,到底慢在哪?

首先要纠正一个认知偏差:Django的 “慢” 是相对的,而非绝对的。

1. 所谓“慢”的本质

Django被吐槽“慢”,主要集中在这几个点:

- 全栈特性的代价:Django是“电池已内置”的全栈框架,ORM、表单验证、认证授权、Admin后台、缓存、国际化等功能开箱即用,这些内置组件会带来一定的性能开销,对比Flask、FastAPI这类轻量框架,纯接口响应速度确实稍慢(基准测试中,简单接口QPS约为FastAPI的1/3-1/2)。

- 同步 IO 的天然限制:Django默认是同步架构,在高并发IO密集型场景(如大量请求等待数据库/第三方接口响应)下,线程/进程池容易被打满,吞吐量受限。

- ORM 的 “便利税” :自动生成的SQL可能不够优化,新手容易写出N+1查询,进一步放大性能问题。

2. 但这些“慢”,大多是“伪问题”

绝大多数业务场景下,Django的性能完全够用:

- 普通中小网站(日活10万以内):Django+合理缓存+数据库优化,能轻松支撑业务,性能瓶颈根本不在框架本身。

- 所谓 “慢” 的对比场景:大多是“裸框架接口跑分”,而真实业务中,接口响应时间的80%以上消耗在数据库、缓存、网络IO上,框架本身的耗时占比不足5%。

- 性能可优化空间大:通过异步改造(Django 3.2+原生支持ASGI)、缓存层(Redis)、数据库读写分离、CDN、Gunicorn+Nginx部署等方式,完全能把Django的性能提升到满足中高并发的水平。

二、Django能稳居第一梯队,核心是“降本增效”

企业选框架,本质是选“性价比”——开发效率、维护成本、团队协作成本,远比单点性能重要。而这正是Django的核心优势。

1. 极致的开发效率:“开箱即用” 的工业级体验

Django的设计哲学是 “不要重复造轮子”,一个命令就能生成完整的项目骨架,几行代码就能实现核心功能:

# 5行代码实现带权限的REST接口(Django+DRF)

from rest_framework import viewsets

from .models import Article

from .serializers import ArticleSerializer

class ArticleViewSet(viewsets.ModelViewSet):

queryset = Article.objects.all()

serializer_class = ArticleSerializer

permission_classes = [IsAuthenticated]

- 内置Admin后台:无需写一行前端代码,就能实现数据的增删改查,调试和运营效率拉满。

- 完善的认证授权:Session、Token、OAuth2等认证方式开箱即用,不用自己造权限轮子。

- 表单验证&CSRF防护:自动处理表单校验、跨站请求伪造,减少安全漏洞。

- ORM的价值:虽然有性能损耗,但大幅降低了数据库操作的学习成本和出错概率,新手也能快速写出安全的数据库逻辑。

对于创业公司或快速迭代的业务,“快上线、少踩坑”比“多10%的性能” 重要得多——Django能让团队用最少的人力,在最短时间内搭建起稳定的业务系统。

2. 成熟的工程化体系:适合团队协作

个人项目可以用Flask自由发挥,但团队项目需要“规范”。Django的“约定优于配置”理念,强制规范了项目结构、代码组织、数据库迁移等流程:

- 统一的项目结构:新人接手项目,不用花时间理解自定义的目录结构,直接就能上手。

- 内置的数据库迁移工具:

makemigrations/migrate完美解决数据库版本管理问题,避免团队协作中的数据结构混乱。 - 丰富的中间件和扩展生态:缓存中间件、跨域中间件、日志中间件等开箱即用,DRF(Django REST Framework)、Celery、Django Channels等扩展几乎能覆盖所有业务场景。

- 完善的文档和社区:官方文档堪称 “教科书级别”,遇到问题能快速找到解决方案,招聘时也更容易找到有经验的开发者。

3. 稳定可靠:经得起生产环境的考验

Django 诞生于2005年,经过近20年的迭代,已经成为一个极其稳定的框架:

- 长期支持版本(LTS):每2-3年发布一个LTS版本,提供3年以上的安全更新和bug修复,企业不用频繁升级框架。

- 安全特性完善:自动防御XSS、CSRF、SQL注入等常见攻击,官方会及时修复安全漏洞,这对企业来说是“刚需”。

- 大量知名案例背书:Instagram、Pinterest、Mozilla、Spotify、国内的知乎(早期)、豆瓣等,都在用 Django支撑核心业务——这些产品的规模,足以证明Django的可靠性。

三、Django 的 “破局之路”:性能短板正在被补齐

面对性能吐槽,Django团队也一直在迭代优化:

- 异步支持:Django 3.0引入ASGI,3.2+完善异步视图、异步ORM,能直接对接WebSocket、长连接,IO密集型场景的并发能力大幅提升。

- 性能优化:新版本持续优化ORM、模板引擎、中间件,减少不必要的开销,比如Django 4.0+的ORM支持批量更新/插入,性能提升显著。

- 生态适配:可以和FastAPI混合部署(比如核心接口用FastAPI,管理后台用Django),兼顾性能和生产力;也可以通过Gunicorn+Uvicorn+异步工作进程,充分利用多核CPU。

四、总结:选框架,本质是选 “适配性”

Django的 “慢”,是为 “全栈、工程化、生产力” 付出的合理代价;而它能稳居第一梯队,核心原因是:

- 匹配绝大多数业务场景:90%的中小业务不需要 “极限性能”,但都需要 “快速开发、稳定运行、易维护”。

- 降低团队成本:统一的规范、丰富的内置功能、完善的文档,能大幅降低招聘、培训、协作成本。

- 生态和稳定性兜底:成熟的生态能解决几乎所有业务问题,长期支持版本让企业不用频繁重构。

最后想说:框架没有好坏,只有适配与否。如果是做高并发的API服务(如直播、秒杀),FastAPI/Tornado 可能更合适;但如果是做内容管理、电商、企业后台等需要快速落地、长期维护的业务,Django依然是Python后端的最优解之一。

这也是为什么,即便有层出不穷的新框架,Django依然能稳坐第一梯队——因为它抓住了工业级开发的核心:让开发者把精力放在业务上,而非重复造轮子。

来源:juejin.cn/post/7606182668330303524

别吹了,AI写Java代码到底能省多少时间?一个后端仔的真实记录

场景一:CRUD 生成 | 提效 70-80% | ⭐⭐⭐⭐⭐

这是 AI 最能打的场景,没有之一。

传统写法:手写 Entity → Mapper XML → Service → ServiceImpl → Controller,一套标准的增删改查,从建表到联调,至少 40 分钟。如果加上参数校验、分页查询、统一返回体,一个小时也不夸张。

用 AI 之后:给 Cursor 一段需求描述加上数据库表结构,5-10 分钟出完整代码。而且生成的代码结构很规范——注解没漏、字段映射没错、甚至连 Swagger 文档注解都给你加上了。

但别高兴太早。

我踩过的坑:AI 生成的 CRUD 代码表面上能跑,细节经常有问题。举几个典型的:

- 字段校验粗糙——

@NotNull加了,但@Size、@Pattern这种业务校验不会主动加 - 分页查询用的是内存分页而不是数据库分页(这个坑特别隐蔽)

- 异常处理一律

catch Exception,没有细分业务异常

所以我的做法是:让 AI 先生成骨架,然后自己过一遍核心逻辑。这样比从零手写快得多,又不会因为盲信 AI 埋雷。

CRUD 是 AI 的主场,这事没争议。但你还是得 review 每一行——AI 写的 bug 比你手写的更隐蔽。

场景二:Bug 排查 | 提效 40-60% | ⭐⭐⭐⭐

先说好用的部分。

一个 NullPointerException,传统排查流程:看堆栈 → 找到报错行 → 往上追调用链 → 打断点 → 复现 → 定位 → 修复。顺利的话 15 分钟,不顺利半小时起步。

现在我直接把报错日志和相关代码丢给 Claude,通常 2-3 分钟就能给出准确定位。不仅告诉你哪里报错,还能分析为什么会走到这个分支。效率差距是数量级的。

SQL 慢查询也类似。把 EXPLAIN 结果丢给 AI,它能分析出索引缺失、全表扫描、JOIN 顺序不合理等问题,给出的优化建议大部分是靠谱的。

但是。

复杂业务逻辑的 bug——比如跨服务的数据不一致、分布式事务异常、线程安全问题——AI 基本帮不上忙。原因很简单:它不了解你的业务上下文,不知道你的系统架构长什么样,不清楚各个服务之间的调用关系。

你可以把全部代码都喂给它,但在上下文窗口有限的情况下,效果也很一般。

AI debug 像个经验丰富的实习生——标准问题秒解,但真正棘手的问题还得靠你自己。

场景三:代码重构 | 提效 30-50% | ⭐⭐⭐

这个场景我体验比较复杂,分层来说。

方法级重构——好用。 提取公共方法、消除重复代码、简化多层嵌套的 if-else,这些 AI 干得又快又好。你说一句「把这段 if-else 用策略模式重构」,它真能给你一套结构清晰的策略类出来。

模块级重构——凑合。 比如给一个老旧的 Service 类做职责拆分,AI 能给出拆分方案,但命名经常不太合适,边界划分也需要自己调整。它不太懂你的团队命名规范,也不清楚哪些逻辑在你的系统里属于同一个领域。

架构级重构——别想了。 单体拆微服务、数据库分库分表这种事,涉及太多业务决策和技术权衡,AI 给的方案顶多算个参考。你要是照着它的方案直接改,后果自负。

重构的本质是对业务的理解。AI 只能帮你搬砖,不能帮你画图纸。

场景四:写单元测试 | 提效 50-70% | ⭐⭐⭐⭐

Java 程序员最不爱写但又不能不写的东西——单元测试。

传统写法:一个 Service 方法的单测,先 mock 一堆依赖,再写正常返回用例、空值用例、异常用例,30-40 分钟很正常。而且坦白说,很多人(包括我)写单测就是为了应付覆盖率检查,质量堪忧。

现在我把 Service 代码丢给 AI,说一句「用 JUnit 5 + Mockito 生成单元测试,覆盖正常和异常场景」,3-5 分钟出一整套。

举个真实例子。比如有这么一个订单查询方法:

public OrderDetailVO getOrderDetail(Long orderId) {

Order order = orderMapper.selectById(orderId);

if (order == null) {

throw new BizException(ErrorCode.ORDER_NOT_FOUND);

}

// 查关联的商品信息

List<OrderItem> items = orderItemMapper.selectByOrderId(orderId);

OrderDetailVO vo = OrderConverter.toDetailVO(order);

vo.setItems(OrderConverter.toItemVOList(items));

vo.setTotalAmount(calcTotalAmount(items));

return vo;

}

AI 生成的测试长这样(节选关键部分):

@ExtendWith(MockitoExtension.class)

class OrderServiceTest {

@Mock

private OrderMapper orderMapper;

@Mock

private OrderItemMapper orderItemMapper;

@InjectMocks

private OrderServiceImpl orderService;

@Test

@DisplayName("查询存在的订单-返回完整详情")

void getOrderDetail_success() {

Order mockOrder = buildMockOrder(1001L);

List<OrderItem> mockItems = buildMockItems(1001L, 2);

when(orderMapper.selectById(1001L)).thenReturn(mockOrder);

when(orderItemMapper.selectByOrderId(1001L)).thenReturn(mockItems);

OrderDetailVO result = orderService.getOrderDetail(1001L);

assertNotNull(result);

assertEquals(1001L, result.getOrderId());

assertEquals(2, result.getItems().size());

verify(orderMapper).selectById(1001L);

}

@Test

@DisplayName("查询不存在的订单-抛出业务异常")

void getOrderDetail_notFound() {

when(orderMapper.selectById(9999L)).thenReturn(null);

BizException ex = assertThrows(BizException.class,

() -> orderService.getOrderDetail(9999L));

assertEquals(ErrorCode.ORDER_NOT_FOUND, ex.getErrorCode());

}

}

说实话,这个质量是能直接用的。Mock 层级对、断言清晰、方法命名规范。如果手写,这两个测试方法至少要 15 分钟,AI 生成只要 2 分钟。

但我手动补了什么呢?

@Test

@DisplayName("订单存在但商品列表为空-金额应为0")

void getOrderDetail_emptyItems() {

when(orderMapper.selectById(1001L)).thenReturn(buildMockOrder(1001L));

when(orderItemMapper.selectByOrderId(1001L)).thenReturn(Collections.emptyList());

OrderDetailVO result = orderService.getOrderDetail(1001L);

assertEquals(BigDecimal.ZERO, result.getTotalAmount());

assertTrue(result.getItems().isEmpty());

}

这种业务边界用例——商品列表为空时金额计算是否正确——AI 不会主动想到,因为它不知道 calcTotalAmount 对空列表的处理逻辑是不是你期望的。

AI 生成测试的优点:

- Mockito 用得很熟练,

@Mock、@InjectMocks、when().thenReturn()一气呵成 - 正常路径和基本异常覆盖得不错

- 断言写得清晰,方法命名规范

缺点也明显:

- 边界条件经常遗漏——并发场景、数据库连接异常、超时这种不会主动想到

- 有时 mock 的层级不对——该 mock Repository 的地方 mock 了 Service

- 对业务语义理解有限——不知道空列表、金额为 0 这种场景需不需要专门测

我现在的套路是:让 AI 先生成 80% 的测试用例,自己再补上那 20% 的关键边界。这比从零手写效率高太多了。

80/20 法则在 AI 写单测这件事上体现得淋漓尽致。

场景五:写技术文档 | 提效 80-90% | ⭐⭐⭐⭐⭐

这是我觉得最被低估的 AI 提效场景。

Java 程序员写代码还行,写文档真的要命。一份接口文档写半天,一份方案设计磨一整天,部署文档更是能拖就拖。

举个例子。前阵子我写了一个用户收货地址的 Controller,大概长这样:

@PostMapping("/address/add")

public Result<Long> addAddress(@RequestBody @Valid AddressAddReq req) { ... }

@GetMapping("/address/list")

public Result<List<AddressVO>> listAddress() { ... }

@PutMapping("/address/update")

public Result<Void> updateAddress(@RequestBody @Valid AddressUpdateReq req) { ... }

@DeleteMapping("/address/{id}")

public Result<Void> deleteAddress(@PathVariable Long id) { ... }

把这段代码丢给 AI,说「生成接口文档,Markdown 格式,包含请求参数、返回值、错误码」,2 分钟后它给我的文档(节选):

POST /address/add — 新增收货地址

| 参数 | 类型 | 必填 | 说明 |

|---|---|---|---|

| receiverName | String | 是 | 收货人姓名,2-20个字符 |

| phone | String | 是 | 手机号,11位 |

| province | String | 是 | 省份 |

| city | String | 是 | 城市 |

| district | String | 是 | 区/县 |

| detailAddress | String | 是 | 详细地址,最长200字符 |

| isDefault | Integer | 否 | 是否默认地址,0-否 1-是,默认0 |

返回值: Result<Long> — 新地址ID

错误码:

ADDRESS_LIMIT_EXCEEDED— 收货地址数量超过上限(20个)PARAM_INVALID— 参数校验失败

它连字段的校验规则都从 @Valid 注解里推断出来了。手写这份文档至少要 30 分钟,现在 2 分钟生成,再花 5 分钟检查补充,总共不到 10 分钟。

方案设计文档也一样。给出需求描述和技术方案要点,AI 能在 10 分钟内生成一份结构完整的设计文档——背景、目标、方案对比、技术选型、风险评估,该有的都有。当然具体技术细节需要自己补,但框架已经省了你 80% 的时间。

README 就更不用说了,几乎不用改,直接能用。

如果你还在手写文档,那你是真的在浪费生命。这话可能有点绝对,但我是认真的。

我的真实结论

一张表总结

| 场景 | 提效幅度 | 推荐度 | 一句话 |

|---|---|---|---|

| CRUD 生成 | 70-80% | ⭐⭐⭐⭐⭐ | AI 的主场,没争议 |

| Bug 排查 | 40-60% | ⭐⭐⭐⭐ | 标准问题秒杀,复杂问题不行 |

| 代码重构 | 30-50% | ⭐⭐⭐ | 能搬砖不能画图纸 |

| 单元测试 | 50-70% | ⭐⭐⭐⭐ | AI 出 80% + 人工补 20% |

| 技术文档 | 80-90% | ⭐⭐⭐⭐⭐ | 最被低估的提效场景 |

关于「效率反降 19%」

最近那个「AI 写代码效率反降 19%」的研究火了,很多人拿来当 AI 没用的证据。但你仔细看就会发现:研究用的是大型开源项目(平均 110 万行代码),上下文极其复杂。

日常业务开发完全不是这个量级。我们的代码库上下文更可控,需求也更明确。在这种条件下,AI 发挥的空间大得多。

说白了,关键不是 AI 行不行,而是你选对了场景没有。用 AI 写 CRUD 能省 70% 时间,你非要让它帮你做架构设计——那确实会「提效为负」。

我的使用原则

- AI 擅长的事全交给它:CRUD、文档、测试框架、标准 bug 排查

- AI 不擅长的事别勉强:复杂业务逻辑、架构设计、跨服务问题

- 永远 review:AI 写的代码比你手写的更需要审查——因为它写的 bug 更隐蔽

- 积累自己的 Prompt:好的 Prompt 比好的工具更重要

写在最后

我是栈外,写了几年 Java,现在用 AI 多赚一份钱。

不会告诉你用 AI 就能月入十万。但它确实能让你每天省出 1-2 小时——前提是你用对场景。

下一篇聊聊这省出来的时间,我拿来干了什么。省下来的时间如果不变成钱,那提效就是个伪命题。

如果觉得有用,点个赞收个藏,后面还有更硬的干货。

这是「栈外」的第 1 篇文章。不画饼,只算账。

来源:juejin.cn/post/7610580125618929690

一个 Java 老兵转 Go 后,终于理解了“简单”的力量

之前写的文章《信不信?一天让你从Java工程师变成Go开发者》很受关注,很多读者对 Go 的学习很感兴趣。今天就再写一篇,聊聊 Java 程序员写 Go 时最常见的思维误区。

核心观点: Go 不需要 Spring 式的依赖注入框架,因为它的设计哲学是"显式优于隐式"。手动构造依赖看似啰嗦,实则更清晰、更快、更易调试。

从 Java 转 Go,第一天就会被这个问题困扰:"@Autowired 在哪?依赖注入框架用哪个?IoC 容器怎么配?"

答案很直接:Go 里没有,也不需要。 不是 Go 做不到,而是 Go 压根不想这么干。这不是功能缺失,而是设计哲学的根本性差异。

第一反应:Go 怎么这么"原始"?

刚开始写 Go,看到的代码是这样的:

func main() {

// 手动创建数据库连接

db := NewDB("localhost:3306", "user", "password")

// 手动创建各种 Service

userRepo := NewUserRepository(db)

orderRepo := NewOrderRepository(db)

paymentSvc := NewPaymentService(db)

inventorySvc := NewInventoryService(db)

orderSvc := NewOrderService(

orderRepo,

paymentSvc,

inventorySvc,

)

userSvc := NewUserService(userRepo)

// 手动创建 HTTP Handler

handler := NewHandler(orderSvc, userSvc)

// 启动服务

http.ListenAndServe(":8080", handler)

}

第一反应:这种写法让人想起早期的 Java 或 PHP。

在 Java 里,这些全是框架干的事:

@SpringBootApplication

public class Application {

public static void main(String[] args) {

SpringApplication.run(Application.class, args);

// 就这一行,所有对象都帮你创建好了

}

}

@RestController

public class OrderController {

@Autowired

private OrderService orderService;

// 框架自动注入,你根本看不到对象怎么创建的

}

Java 开发者心里 OS:

- "Go 是不是太简陋了?"

- "难道要我手动 new 几十个对象?"

- "这不是倒退吗?"

先别急着下结论,听我说完。

为什么 Go 要这么"原始"?

Go 的设计哲学就一句话:

显式优于隐式,简单优于复杂。

这不是口号,而是实实在在的取舍。

对比1:依赖是怎么传递的?

Java/Spring 的做法:

// 你写这个

@Service

public class OrderService {

@Autowired

private PaymentService paymentService;

@Autowired

private InventoryService inventoryService;

@Autowired

private NotificationService notificationService;

}

// 框架在背后做了:

// 1. 扫描所有类

// 2. 分析依赖关系

// 3. 构建依赖图

// 4. 按顺序创建对象

// 5. 通过反射注入字段

// 6. 处理循环依赖

// 7. 管理生命周期

这些魔法看起来很方便,但:

- 你不知道对象什么时候创建的

- 你不知道注入顺序是什么

- 出问题了,调试要靠猜

- 启动慢(要扫描、要反射)

- 内存大(要维护容器)

Go 的做法:

type OrderService struct {

paymentSvc *PaymentService

inventorySvc *InventoryService

notificationSvc *NotificationService

}

func NewOrderService(

paymentSvc *PaymentService,

inventorySvc *InventoryService,

notificationSvc *NotificationService,

) *OrderService {

return &OrderService{

paymentSvc: paymentSvc,

inventorySvc: inventorySvc,

notificationSvc: notificationSvc,

}

}

// 在 main 里

paymentSvc := NewPaymentService(db)

inventorySvc := NewInventoryService(db)

notificationSvc := NewNotificationService(queue)

orderSvc := NewOrderService(

paymentSvc,

inventorySvc,

notificationSvc,

)

这些代码看起来很啰嗦,但:

- 你清楚地看到每个对象怎么创建的

- 你清楚地看到依赖关系是什么

- 出问题了,一眼就能定位

- 启动快(没有扫描、没有反射)

- 内存小(没有容器)

对比2:遇到问题怎么调试?

Java/Spring 遇到问题:

报错:Could not autowire. No beans of 'PaymentService' type found.

你要做的:

1. 检查 PaymentService 有没有 @Service

2. 检查包扫描路径对不对

3. 检查有没有循环依赖

4. 检查 @Conditional 条件是否满足

5. 检查配置文件有没有禁用

6. Google 半天

7. 还不行,看 Spring 源码

根本原因可能是:配置文件里有个 typo

Go 遇到问题:

编译报错:undefined: paymentSvc

你要做的:

1. 看报错的那一行

2. 发现没有传 paymentSvc 参数

3. 改完,搞定

5 秒钟解决

对比3:新人上手难度

Java/Spring 新人:

"这个对象哪来的?"

"@Autowired 和 @Resource 有什么区别?"

"为什么我的 Bean 没有注入?"

"循环依赖怎么解决?"

"什么是 BeanPostProcessor?"

要学的概念:

- IoC 容器

- 依赖注入

- Bean 生命周期

- AOP

- 代理模式

- ...

Go 新人:

"这个对象哪来的?"

"看 main 函数,就是在那 New 出来的。"

"哦,明白了。"

要学的概念:

- 函数

- 指针

Go 为什么说自己"像脚本语言"?

Go 的设计目标就是:

写起来像脚本语言一样简单,跑起来像编译型语言一样快。

什么叫"像脚本语言"?

PHP 的写法:

<?php

// 直接开始写逻辑

$db = new PDO('mysql:host=localhost', 'user', 'pass');

$userRepo = new UserRepository($db);

$user = $userRepo->find(1);

echo $user->name;

Python 的写法:

# 直接开始写逻辑

db = connect_db('localhost', 'user', 'pass')

user_repo = UserRepository(db)

user = user_repo.find(1)

print(user.name)

Go 的写法:

func main() {

// 直接开始写逻辑

db := NewDB("localhost", "user", "pass")

userRepo := NewUserRepository(db)

user := userRepo.Find(1)

fmt.Println(user.Name)

}

看出来了吗?Go 就是想让你像写脚本一样写代码。

不需要:

- 复杂的配置文件

- 注解魔法

- 框架黑盒

- 反射黑魔法

只需要:

- 创建对象

- 调用方法

- 传递参数

但是,它不是脚本语言:

- 有强类型检查(写错了编译不过)

- 编译成二进制(部署一个文件)

- 性能接近 C(比 Java 快很多)

- 启动秒开(没有 JVM 预热)

这种差异带来的实际影响

理论说完了,看看实际项目中的差异。

场景1:启动速度

Java/Spring 项目:

启动流程:

1. JVM 启动(1-2秒)

2. 加载类(2-3秒)

3. 扫描注解(3-5秒)

4. 构建依赖图(2-3秒)

5. 初始化 Bean(5-10秒)

6. AOP 代理(2-3秒)

总计:15-30秒

项目大了:1-2分钟

Go 项目:

启动流程:

1. 执行 main 函数

2. 创建对象

3. 启动服务

总计:0.1-0.5秒

项目再大:也就几秒

这就是为什么 Go 适合做 CLI 工具、K8s 组件:启动快。

场景2:内存占用

Java/Spring 项目:

启动后内存:

- JVM 基础:100-200MB

- Spring 容器:50-100MB

- 对象缓存:100-200MB

最小内存:300-500MB

实际运行:1-2GB

Go 项目:

启动后内存:

- 没有虚拟机

- 没有容器

- 只有你创建的对象

最小内存:10-20MB

实际运行:50-200MB

这就是为什么 Go 适合做微服务、容器应用:省资源。

场景3:调试体验

Java/Spring 遇到空指针:

// 报错

NullPointerException at OrderService.process()

// 原因可能是:

1. paymentService 没有注入成功

2. 某个 @Conditional 条件不满足

3. 循环依赖导致代理失败

4. 配置文件写错了

// 排查过程:

- 看日志,找不到原因

- 打断点,发现字段是 null

- Google,找到类似问题

- 尝试各种方案

- 1小时后,发现是配置文件拼写错误

Go 遇到空指针:

// 报错

panic: runtime error: invalid memory address

// 看代码

orderSvc := NewOrderService(

paymentSvc,

nil, // 这里忘了传

notificationSvc,

)

// 排查过程:

- 看报错行号

- 看代码

- 发现 nil

- 改完,搞定

// 5 秒钟解决

Java 开发者常犯的错误

看几个 Java 开发者写 Go 时常犯的错误。

错误1:找依赖注入框架

错误想法:

"Go 的依赖注入框架哪个好?Wire?Dig?"

正确做法:

别找了,手动传参就够了

有些 Go 项目确实用了 Wire、Dig,但那是因为:

- 项目太大(100+ 个 Service)

- 自动生成代码,减少重复

大部分项目,手动传参就够了。

错误2:过度抽象

// 错误做法:照搬 Java 那套

type ServiceFactory interface {

CreateUserService() UserService

CreateOrderService() OrderService

}

type ServiceFactoryImpl struct {

db *DB

}

func (f *ServiceFactoryImpl) CreateUserService() UserService {

return NewUserService(f.db)

}

// 正确做法:直接创建

func main() {

db := NewDB()

userSvc := NewUserService(db)

orderSvc := NewOrderService(db)

}

错误3:到处用接口

// 错误做法:每个 struct 都配个 interface

type UserService interface {

GetUser(id int) (*User, error)

}

type UserServiceImpl struct {

repo *UserRepository

}

// 正确做法:需要 mock 时才定义 interface

type UserService struct {

repo *UserRepository

}

// 测试时才定义

type UserRepository interface {

Find(id int) (*User, error)

}

Go 的接口是隐式实现的,不需要到处声明。

错误4:配置文件过度使用

# 错误做法:把所有配置都写 YAML

database:

host: localhost

port: 3306

user: root

services:

user:

enabled: true

timeout: 5s

order:

enabled: true

timeout: 10s

// 正确做法:代码即配置

func main() {

db := NewDB("localhost:3306", "root", "password")

userSvc := NewUserService(db, 5*time.Second)

orderSvc := NewOrderService(db, 10*time.Second)

}

Go 的理念是:代码就是最好的配置。

什么时候该用依赖注入框架?

话说回来,真的完全不需要 DI 框架吗?也不是。

适合手动传参的场景(大部分情况)

小型项目(<50 个组件)

// 清晰、直接、易调试

func main() {

db := NewDB()

cache := NewCache()

userRepo := NewUserRepository(db)

orderRepo := NewOrderRepository(db)

userSvc := NewUserService(userRepo, cache)

orderSvc := NewOrderService(orderRepo, userSvc)

// 10-20 个组件,完全可控

}

中型项目(50-100 个组件)

// 可以考虑分组管理

type Services struct {

User *UserService

Order *OrderService

// ...

}

func InitServices(db *DB) *Services {

userRepo := NewUserRepository(db)

orderRepo := NewOrderRepository(db)

return &Services{

User: NewUserService(userRepo),

Order: NewOrderService(orderRepo),

}

}

适合用 DI 框架的场景

大型微服务(>100 个组件)

当你的项目有 100+ 个 Service、Repository、Client 时,手动传参确实会很繁琐。这时可以考虑:

Wire(Google 官方推荐)

- 编译时生成代码,不是运行时反射

- 性能无损耗

- 类型安全

- 适合大型项目

// wire.go

//go:build wireinject

func InitializeApp() (*App, error) {

wire.Build(

NewDB,

NewUserRepository,

NewUserService,

NewApp,

)

return nil, nil

}

// wire 会自动生成代码

Dig(Uber 出品)

- 运行时依赖注入

- 更灵活,但有性能开销

- 适合需要动态配置的场景

判断标准:

组件数 < 50 个 → 手动传参

组件数 50-100 个 → 手动传参 + 分组管理

组件数 > 100 个 → 考虑 Wire

需要插件化/动态加载 → 考虑 Dig

CLI 工具/脚本类应用 → 绝对不需要 DI 框架

记住一个原则:

不要为了"看起来像企业级架构"而引入 DI 框架。大部分 Go 项目,手动传参就够了。

澄清一个误解:Go 不是"反对抽象"

看到这里,有些人可能会想:"Go 这么简单粗暴,是不是就是写面条代码?"

不是的。

Go 的设计哲学不是"反对抽象",而是**"反对过早抽象、反对过度抽象"**。

Go 鼓励的抽象方式

1. 需要解耦时才引入接口

// 错误做法:提前抽象

type UserService interface {

GetUser(id int) (*User, error)

CreateUser(user *User) error

}

type UserServiceImpl struct { }

// 正确做法:需要 mock 时才抽象

type UserService struct {

repo UserRepository // 这里才用接口

}

type UserRepository interface {

Find(id int) (*User, error)

Save(user *User) error

}

2. 真正需要多态时才用接口

// 有多个实现时才抽象

type Storage interface {

Save(key string, value []byte) error

Load(key string) ([]byte, error)

}

// 文件存储实现

type FileStorage struct { }

// Redis 存储实现

type RedisStorage struct { }

// S3 存储实现

type S3Storage struct { }

Go 的理念是:

- 先用具体类型写代码

- 发现真正需要抽象时(测试、多实现),再引入接口

- 不要为了"看起来专业"而提前抽象

这不是反对抽象,而是在正确的时机做正确的事。

什么时候该用框架?

话说回来,难道 Go 就完全不需要框架了?

也不是。

适合用框架的场景

1. HTTP 路由:Gin、Echo

// 标准库的 http.ServeMux 太简陋

// 用 Gin 处理路由、中间件更方便

r := gin.Default()

r.GET("/users/:id", getUser)

r.POST("/orders", createOrder)

2. ORM:GORM

// 标准库的 database/sql 写 SQL 太麻烦

// 用 GORM 处理关联查询更方便

db.Where("age > ?", 18).Find(&users)

3. 配置管理:Viper

// 管理多环境配置

viper.SetConfigName("config")

viper.ReadInConfig()

不适合用框架的场景

1. 依赖注入

不需要 Wire、Dig,手动传参就够了。

2. 业务逻辑

不要用框架包装业务逻辑,直接写代码。

3. 简单功能

不要为了"看起来专业"而引入框架。

给 Java 开发者的建议

如果你是 Java 开发者,开始写 Go,记住这几点:

1. 忘掉 Spring 那套

别想着:

- 在哪配置注解

- 怎么注入依赖

- 怎么用 AOP

直接写代码就行

2. 拥抱"啰嗦"

Java 开发者看 Go:

"怎么要手动 new 这么多对象?太啰嗦了!"

写一段时间后:

"原来清晰明了比简洁更重要。"

3. 代码即文档

Java 项目:

- 要看 XML 配置

- 要看注解定义

- 要看框架文档

Go 项目:

- 看 main 函数

- 看 NewXXX 函数

- 看代码就够了

4. 简单优于复杂

遇到问题:

第一反应不是"找个框架"

而是"能不能写100行代码搞定"

90%的情况,100行代码就够了

一个实际例子

最后用一个例子,对比一下两种风格。

场景:订单服务

需要:

- 数据库操作

- 支付服务调用

- 库存服务调用

- 通知服务调用

Java/Spring 实现

// Application.java

@SpringBootApplication

public class Application {

public static void main(String[] args) {

SpringApplication.run(Application.class, args);

}

}

// OrderController.java

@RestController

@RequestMapping("/orders")

public class OrderController {

@Autowired

private OrderService orderService;

@PostMapping

public Order create(@RequestBody CreateOrderRequest req) {

return orderService.create(req);

}

}

// OrderService.java

@Service

public class OrderService {

@Autowired

private OrderRepository orderRepository;

@Autowired

private PaymentService paymentService;

@Autowired

private InventoryService inventoryService;

@Autowired

private NotificationService notificationService;

public Order create(CreateOrderRequest req) {

// 业务逻辑

}

}

配置文件 application.yml:

spring:

datasource:

url: jdbc:mysql://localhost:3306/db

username: root

password: password

代码文件: 4个

配置文件: 1个

看起来: 很简洁

实际运行: 一堆魔法

Go 实现

// main.go

func main() {

// 创建依赖

db := NewDB("localhost:3306", "root", "password")

defer db.Close()

orderRepo := NewOrderRepository(db)

paymentSvc := NewPaymentService()

inventorySvc := NewInventoryService()

notificationSvc := NewNotificationService()

orderSvc := NewOrderService(

orderRepo,

paymentSvc,

inventorySvc,

notificationSvc,

)

// 创建 HTTP Handler

r := gin.Default()

r.POST("/orders", func(c *gin.Context) {

var req CreateOrderRequest

if err := c.BindJSON(&req); err != nil {

c.JSON(400, gin.H{"error": err.Error()})

return

}

order, err := orderSvc.Create(req)

if err != nil {

c.JSON(500, gin.H{"error": err.Error()})

return

}

c.JSON(200, order)

})

// 启动服务

r.Run(":8080")

}

// order_service.go

type OrderService struct {

orderRepo *OrderRepository

paymentSvc *PaymentService

inventorySvc *InventoryService

notificationSvc *NotificationService

}

func NewOrderService(

orderRepo *OrderRepository,

paymentSvc *PaymentService,

inventorySvc *InventoryService,

notificationSvc *NotificationService,

) *OrderService {

return &OrderService{

orderRepo: orderRepo,

paymentSvc: paymentSvc,

inventorySvc: inventorySvc,

notificationSvc: notificationSvc,

}

}

func (s *OrderService) Create(req CreateOrderRequest) (*Order, error) {

// 业务逻辑

}

代码文件: 2个

配置文件: 0个

看起来: 有点啰嗦

实际运行: 一目了然

最后的思考:从 Spring 到 main(),是一次思维升级

从 Java 转 Go,最大的障碍不是语法,而是思维方式。

Java/Spring 的思维:

- 框架帮你管理一切

- 抽象层次越高越好

- 配置优于代码

- "我不需要知道对象怎么创建的,框架会处理"

Go 的思维:

- 你自己管理一切

- 简单直接就够了

- 代码即配置

- "我清楚地知道每个对象是怎么来的"

这不是谁对谁错,而是不同的设计哲学,适合不同的场景。

给 Java 开发者的建议

如果你从 Java 转 Go,记住这几点:

1. 拥抱"啰嗦",它带来的是清晰

刚开始:

"怎么要手动 new 这么多对象?太麻烦了!"

一个月后:

"原来看一眼 main 函数就知道整个系统是怎么组装的。"

2. 别急着找"Go 的 Spring"

Go 生态里有很多框架,但:

- 不要为了"看起来专业"而引入框架

- 不要为了"企业级架构"而过度设计

- 先写代码解决问题,再考虑是否需要框架

3. 代码即文档

Java 项目理解成本:

- 看配置文件

- 看注解定义

- 看框架文档

- 猜测对象是怎么创建的

Go 项目理解成本:

- 看 main 函数

- 看 NewXXX 函数

- 就这么简单

4. 简单优于复杂

遇到问题时:

第一反应不是"有没有框架能解决"

而是"能不能写 100 行代码搞定"

90% 的情况,100 行代码就够了

从 Spring 到 main(),不是倒退,而是升级

你失去的是:

- 自动注入的"魔法"

- 复杂的抽象层次

- 庞大的框架依赖

你获得的是:

- 对系统的完全掌控

- 清晰可见的执行流程

- 快速的启动和调试

- 简单直接的代码组织

这不是倒退,而是一次返璞归真的旅程。

最后的鼓励

从 Spring 的"魔法"转到 Go 的"手工",一开始可能会不适应。

你可能会觉得:

- "怎么这么原始?"

- "怎么要写这么多重复代码?"

- "没有框架怎么办?"

但坚持一周,你会发现:

- 代码更清晰了

- 调试更简单了

- 启动更快了

- 部署更轻了

再过一个月,当你回头看 Spring 项目时,你会想:

- "这个对象是怎么创建的?"

- "这个注解背后做了什么?"

- "为什么启动要 30 秒?"

那时候,你就真正理解了 Go 的设计哲学。

记住:

Go 的哲学是:显式优于隐式,简单优于复杂。

从 Spring 到 main(),你失去的是魔法,获得的是掌控。

适应这个哲学,你就适应了 Go。

欢迎来到 Go 的世界。

就这样。

来源:juejin.cn/post/7587712328826224676

告别满屏 v-if:用一个自定义指令搞定 Vue 前端权限控制

在企业级应用开发中,权限控制是一个绑不开的话题。前端权限控制虽然不能替代后端校验,但能极大提升用户体验——让用户只看到自己能操作的内容,避免无效点击和困惑。

本文将分享一个 Vue 2 自定义指令的设计思路,实现了声明式的权限控制方案。

设计目标

在动手写代码之前,我先梳理了几个核心诉求:

- 使用简单:一行代码搞定权限控制,不需要写一堆

v-if - 性能友好:同一权限不重复请求,利用缓存

- 灵活可控:支持隐藏、禁用、提示等多种交互方式

- 支持多场景:既能用在模板里,也能在 JS 逻辑中调用

核心实现

1. 权限缓存设计

权限校验通常需要请求后端接口,如果每个按钮都单独请求一次,那页面性能会非常糟糕。这里采用了 Promise 缓存 的方式:

Vue.prototype.$getPerm = (options) => {

const argId = options.type + '-' + (options.type === 'space' ? options.spaceId : options.wikiId)

// 如果缓存中没有,创建新的 Promise

if (!spaceInfoStore.permissionMap[argId]) {

spaceInfoStore.permissionMap[argId] = new Promise((resolve, reject) => {

// 请求后端获取权限...

Auth.getUserPermBySpaceId(options.spaceId).then((res) => {

const permissions = res.reduce((acc, category) => {

category.permissions.forEach(permission => {

acc.push(`${category.value}.${permission.authorityKey}`)

})

return acc

}, [])

resolve({ permissions })

})

})

}

return spaceInfoStore.permissionMap[argId]

}

这个设计的巧妙之处在于:缓存的是 Promise 本身,而不是结果。

这样做的好处是,即使多个组件同时调用 $getPerm,也只会发出一次请求。后续的调用会直接拿到同一个 Promise,等待第一次请求的结果。

2. 双重使用方式

为了覆盖不同的使用场景,我设计了两种调用方式:

方式一:指令式(模板中使用)

<button v-perm:[permOptions]="'SPACE.EDIT'">编辑</button>

方式二:编程式(JS 中使用)

this.$hasPerm({ spaceId: 123 }, 'SPACE.EDIT').then(() => {

// 有权限,执行操作

}).catch(() => {

// 无权限

})

指令式适合静态权限控制,编程式适合需要在逻辑中判断的场景。两者底层共用同一套缓存机制。

3. DOM 处理策略

无权限时如何处理 DOM?这里提供了三种策略:

function domHandler (el, binding) {

let placeholderDom = null

if (binding?.arg?.showTips || binding?.arg?.disabled) {

// 策略1&2:保留元素,但禁用或添加点击提示

placeholderDom = el.cloneNode(true)

if (binding?.arg?.showTips) {

placeholderDom.onclick = function () {

Vue.prototype.$bkMessage({

message: binding?.arg?.tipsText || '没有权限',

theme: 'warning'

})

}

}

if (binding?.arg?.disabled) {

placeholderDom.classList.add('disabled')

}

} else {

// 策略3:完全隐藏,用注释节点占位

placeholderDom = document.createComment('permission-placeholder')

}

el.placeholderDom = placeholderDom

el.parentNode.replaceChild(placeholderDom, el)

}

为什么用注释节点而不是直接 display: none?

因为注释节点不会影响布局,也不会被 CSS 选择器选中。更重要的是,我们需要保留一个"锚点",方便权限变化时把原始元素恢复回去。

4. 响应式更新

权限可能会动态变化(比如用户被授权后刷新),所以指令需要同时监听 inserted 和 update 钩子:

Vue.directive('perm', {

inserted (el, binding) {

handlerPerm(el, binding)

},

update (el, binding) {

handlerPerm(el, binding)

}

})

恢复元素的逻辑也很简单:

function restoreElement (el) {

if (el.placeholderDom && el.placeholderDom.parentNode) {

el.placeholderDom.parentNode.replaceChild(el, el.placeholderDom)

}

el.placeholderDom = null

return true

}

5. 支持布尔值快捷方式

有时候权限结果已经在外部计算好了,不需要再走一遍接口校验。这种场景下,支持直接传布尔值会更方便:

<button v-perm:[options]="hasPermission">操作</button>

if (typeof binding.value === 'boolean') {

if (binding.value === false) {

domHandler(el, binding)

} else {

restoreElement(el)

}

return

}

使用示例

基础用法

<template>

<div>

<!-- 无权限时隐藏 -->

<button v-perm:[permConfig]="'SPACE.DELETE'">删除</button>

<!-- 无权限时禁用并提示 -->

<button v-perm:[permConfigWithTips]="'SPACE.EDIT'">编辑</button>

</div>

</template>

<script>

export default {

computed: {

permConfig() {

return {

spaceId: this.currentSpaceId,

type: 'space'

}

},

permConfigWithTips() {

return {

spaceId: this.currentSpaceId,

type: 'space',

disabled: true,

showTips: true,

tipsText: '您没有编辑权限,请联系管理员'

}

}

}

}

</script>

编程式调用

// 在执行敏感操作前校验

async handleDelete() {

try {

await this.$hasPerm({ spaceId: this.spaceId }, 'SPACE.DELETE')

// 有权限,继续执行删除逻辑

await this.doDelete()

} catch {

// 无权限,$hasPerm 内部已经弹出提示

}

}

清除缓存重新加载

当权限发生变化时(比如管理员授权后),可以清除缓存重新加载:

this.$getPerm({

spaceId: this.spaceId,

clearCache: true

})

设计总结

| 特性 | 实现方式 |

|---|---|

| 性能优化 | Promise 缓存,同一权限只请求一次 |

| 使用方式 | 指令式 + 编程式双重支持 |

| DOM 处理 | 隐藏 / 禁用 / 提示三种策略 |

| 响应式 | inserted + update 钩子联动 |

| 灵活性 | 支持布尔值、清除缓存、自定义提示 |

可以优化的点

- Vue 3 适配:Vue 3 的指令钩子函数名称有变化(

mounted、updated),迁移时需要调整 - TypeScript 支持:可以为

PermissionOptions添加完整的类型定义 - 批量权限查询:如果页面上有大量权限点,可以考虑合并成一次批量查询

- 权限预加载:在路由守卫中预加载权限数据,减少页面白屏时间

以上就是这个权限指令的完整设计思路。核心思想是:用缓存换性能,用指令换简洁。希望对你有所启发,欢迎交流讨论 🙌

完整代码

最后贴一下完整代码,可以直接拿去用,根据自己项目的接口改一下就行:

// permission.js

import { useSpaceInfoStore } from '@/store/modules/spaceInfo'

import Auth from '@/api/modules/auth'

let spaceInfoStore = null

setTimeout(() => {

spaceInfoStore = useSpaceInfoStore()

}, 40)

/**

* @typedef {Object} PermissionOptions

* @property {string|number} [wikiId] - 文档id

* @property {string|number} [spaceId] - 空间id

* @property {string} [type] - 权限类型:空间/文档 space/wiki

* @property {boolean} [disabled] - 是否禁用元素

* @property {boolean} [showTips] - 是否显示提示信息

* @property {string} [tipsText] - 提示文本内容

* @property {boolean} [clearCache] - 是否清除缓存

*/

function install (Vue) {

/**

* 获取权限信息

* @param {PermissionOptions} options - 权限选项

* @returns {Promise<any>}

*/

Vue.prototype.$getPerm = (options) => {

if (!options.spaceId) return

// 如果没有传type,则根据是否有文档id判断

options.type = options.type || (options.wikiId ? 'wiki' : 'space')

const argId = options.type + '-' + (options.type === 'space' ? options.spaceId : options.wikiId)

// 清除缓存权限,可重新加载

if (options.clearCache) {

spaceInfoStore.permissionMap[argId] = false

}

if (!spaceInfoStore.permissionMap[argId]) {

spaceInfoStore.permissionMap[argId] = new Promise((resolve, reject) => {

if (options.type === 'space') {

Auth.getUserPermBySpaceId(options.spaceId).then((res) => {

// 组合权限生成唯一key

const permissions = res.reduce((acc, category) => {

category.permissions.forEach(permission => {

acc.push(`${category.value}.${permission.authorityKey}`)

})

return acc

}, [])

resolve({ permissions })

})

} else {

Auth.getWikiPermissionDetail(options.spaceId, options.wikiId).then((res) => {

// 组合权限生成唯一key

const permissions = res.map(item => item.authorityKey)

resolve({ permissions })

})

}

})

}

return spaceInfoStore.permissionMap[argId]

}

/**

* 检查是否有权限

* @param {PermissionOptions} options - 权限选项

* @param {string} perm - 权限码

* @returns {Promise<boolean>}

*/

Vue.prototype.$hasPerm = (options, perm) => {

if (!Object.prototype.hasOwnProperty.call(options, 'showTips')) {

options.showTips = true

}

return new Promise((resolve, reject) => {

if (!options.spaceId) {

resolve(true)

return

}

const promise = Vue.prototype.$getPerm(options)

promise.then((res) => {

if (res.isAdmin) {

resolve(true)

return

}

if (res.permissions.includes(perm)) {

resolve(true)

return

}

if (options.showTips) {

Vue.prototype.$bkMessage({

message: options.tipsText || '没有权限',

theme: 'warning'

})

}

reject(new Error(''))

})

})

}

/**

* DOM 处理函数 - 处理无权限时的元素显示

* @param {HTMLElement} el - DOM 元素

* @param {Object} binding - 指令绑定对象

*/

function domHandler (el, binding) {

let placeholderDom = null

if (binding?.arg?.showTips || binding?.arg?.disabled) {

placeholderDom = el.cloneNode(true)

if (binding?.arg?.showTips) {

placeholderDom.onclick = function () {

Vue.prototype.$bkMessage({

message: binding?.arg?.tipsText || '没有权限',

theme: 'warning'

})

}

}

if (binding?.arg?.disabled) {

placeholderDom.classList.add('disabled')

}

} else {

placeholderDom = document.createComment('permission-placeholder')

}

if (el.parentNode) {

el.placeholderDom = placeholderDom

el.parentNode.replaceChild(placeholderDom, el)

}

}

/**

* 将元素恢复到原始位置

* @param {HTMLElement} el - DOM 元素

* @returns {boolean}

*/

function restoreElement (el) {

el.placeholderDom && el.placeholderDom.parentNode.replaceChild(el, el.placeholderDom)

el.placeholderDom = null

return true

}

/**

* 权限处理函数

* @param {HTMLElement} el - DOM 元素

* @param {Object} binding - 指令绑定对象

*/

function handlerPerm (el, binding) {

// 通过直接传递boolean值,也可以进行权限校验

if (typeof binding.value === 'boolean') {

if (binding.value === false) {

domHandler(el, binding)

} else {

restoreElement(el)

}

return

}

// 判断权限入参是否完善

if (!binding?.arg?.spaceId || !binding?.value) return restoreElement(el)

const promise = Vue.prototype.$getPerm({ ...binding.arg })

promise.then((res) => {

if (res.isAdmin) return restoreElement(el)

if (res.permissions.includes(binding.value)) return restoreElement(el)

domHandler(el, binding)

})

}

Vue.directive('perm', {

inserted (el, binding) {

handlerPerm(el, binding)

},

update (el, binding) {

handlerPerm(el, binding)

}

})

}

export default { install }

在 main.js 里注册一下就能用了:

import permission from '@/directives/permission'

Vue.use(permission)

来源:juejin.cn/post/7585758163436011526

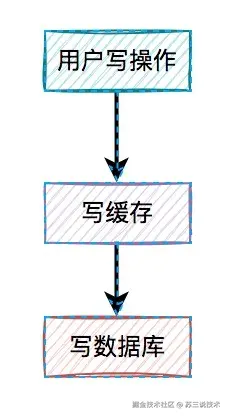

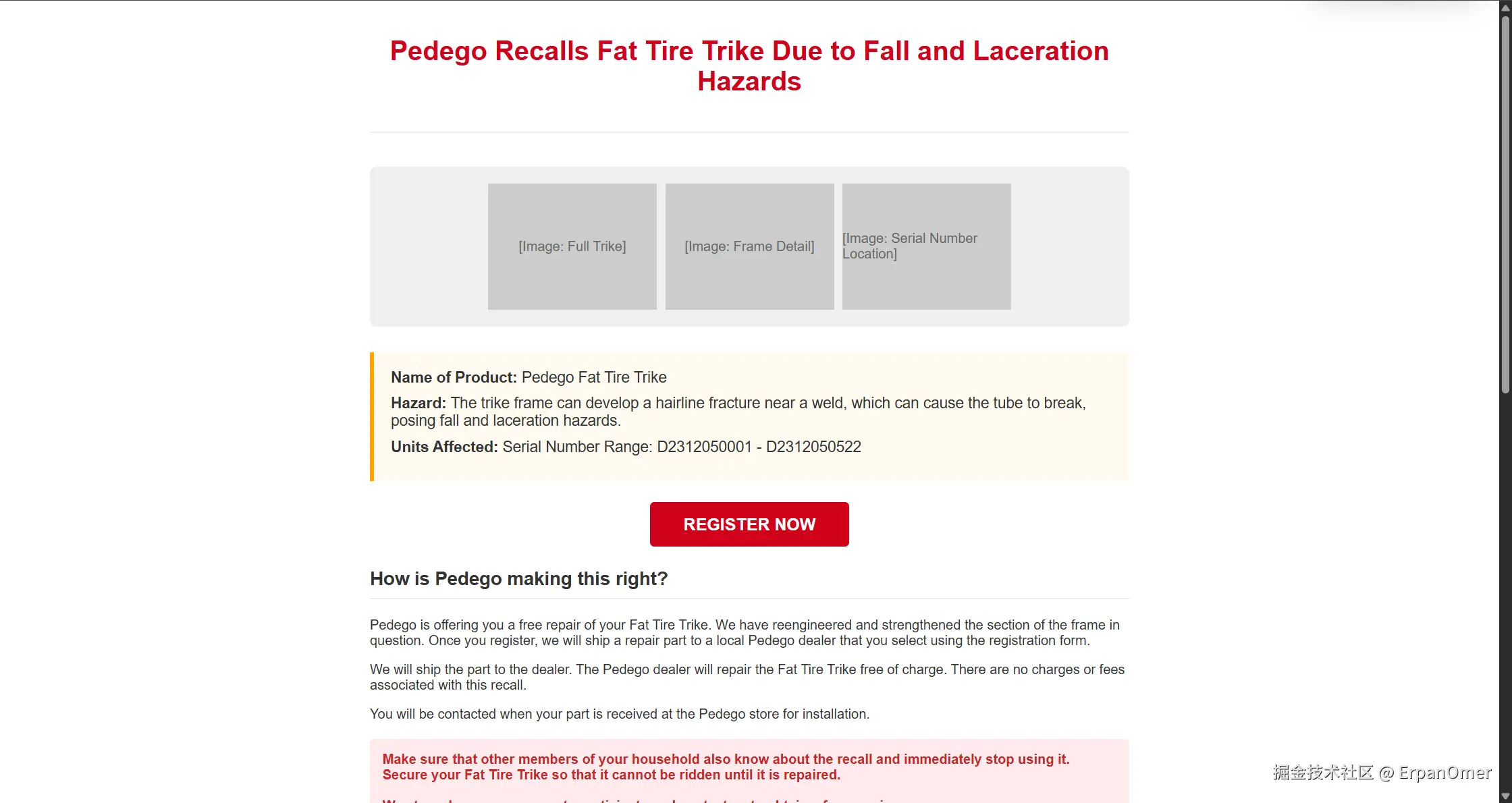

当上传不再只是 /upload,我们是怎么设计大文件上传的

业务背景

在正式讲之前,先看一个我们做的大文件上传demo。

下面这个视频演示的是上传一个 1GB 的压缩包,整个过程支持分片上传、断点续传、暂停和恢复。

可以看到速度不是特别快,这个是我故意没去优化的。

前端那边计算文件 MD5、以及最后合并文件的时间我都保留了,

主要是想让大家能看到整个流程是怎么跑通的。

平时我们在做一些 SaaS 系统的时候,文件上传这块其实基本上都设计的挺简单的。

前端做个分片上传,后端把分片合并起来,最后存 OSS 或者服务器某个路径上,再返回一个 URL 就完事了。

大多数情况下,这样的方案也确实够用。

但是最近我在做一个私有化项目,场景完全不一样。

项目是给政企客户部署的内部系统,里面有 AI 大模型客服问答的功能。

客户需要把他们内部的文档、手册、规范、图纸、流程等资料打包上传到服务器,用来做后续的向量化、知识检索或者模型训练。

这类场景如果还沿用之前 SaaS 系统那种上传方式,往往就不太适用了。

因为这些文件往往有几个共同点:

- 文件数量多,动辄几百上千份(Word、PDF、PPT、Markdown 都有);

- 文件体积大,打成 zip 动不动就是几个 G,甚至十几二十个 G;

- 上传环境复杂,客户一般在内网或局域网,有的甚至完全断网;

- 有安全要求,文件不能经过云端 OSS,里面可能有保密资料;

- 需要审计,要能知道是谁上传的、什么时候传的、文件现在存哪;

- 上传完之后还要进一步处理,比如自动解压、解析文本、拆页、向量化,然后再存入 Milvus 或 pgvector。

在正式讲之前,先看一个我们做的大文件上传demo。

下面这个视频演示的是上传一个 1GB 的压缩包,整个过程支持分片上传、断点续传、暂停和恢复。

可以看到速度不是特别快,这个是我故意没去优化的。

前端那边计算文件 MD5、以及最后合并文件的时间我都保留了,

主要是想让大家能看到整个流程是怎么跑通的。

平时我们在做一些 SaaS 系统的时候,文件上传这块其实基本上都设计的挺简单的。

前端做个分片上传,后端把分片合并起来,最后存 OSS 或者服务器某个路径上,再返回一个 URL 就完事了。

大多数情况下,这样的方案也确实够用。

但是最近我在做一个私有化项目,场景完全不一样。

项目是给政企客户部署的内部系统,里面有 AI 大模型客服问答的功能。

客户需要把他们内部的文档、手册、规范、图纸、流程等资料打包上传到服务器,用来做后续的向量化、知识检索或者模型训练。

这类场景如果还沿用之前 SaaS 系统那种上传方式,往往就不太适用了。

因为这些文件往往有几个共同点:

- 文件数量多,动辄几百上千份(Word、PDF、PPT、Markdown 都有);

- 文件体积大,打成 zip 动不动就是几个 G,甚至十几二十个 G;

- 上传环境复杂,客户一般在内网或局域网,有的甚至完全断网;

- 有安全要求,文件不能经过云端 OSS,里面可能有保密资料;

- 需要审计,要能知道是谁上传的、什么时候传的、文件现在存哪;

- 上传完之后还要进一步处理,比如自动解压、解析文本、拆页、向量化,然后再存入 Milvus 或 pgvector。

所以这种情况还用 SaaS 系统那种“简单上传+云存储”方案的话,那可能问题就一堆:

- 上传中断后用户一刷新浏览器就得重传整个包;

- 集群部署时分片打到不同机器上根本无法合并;

- 多人同时上传可能会发生文件覆盖或路径冲突;

- 没有任何上传记录,也追踪不到是谁传的;

- 对政企来说,审计、合规、保密全都不达标。

所以,我们需要重新设计文件上传的功能逻辑。

目的是让它不仅能支持大文件、断点续传、集群部署,还能同时适配内网环境、权限管控,以及后续的 AI 文档解析和知识向量化等处理流程。

为什么很多项目只需要一个 upload 接口

如果我们回头看一下自己平常做过的一些常规 Web 项目,尤其是各种 SaaS 系统或者后台管理系统,

其实大多数时候后端只会提供一个 /upload 接口, 前端拿到文件后直接调用这个接口,后端保存文件再返回一个 URL 就结束了。

甚至我们在很多项目里,前端都不会把文件传给业务服务,

而是直接通过前端 SDK(比如阿里云 OSS、腾讯云 COS、七牛云等)上传到云存储,

上传完后拿到文件地址,再把这个地址回传给后端保存。

这种方式在 SaaS 系统或者轻量级的业务里非常普遍,也非常高效。 主要原因有几个:

- 文件都比较小,大多数就是几 MB 的图片、PDF 或 Excel;

- 云存储足够稳定,上传、下载、访问都有完整的 SDK 支撑;

- 系统是公网部署,不需要考虑局域网、内网断网这些问题;

- 对安全和审计的要求不高,文件内容也不是涉密数据;

- 用户体验优先,所以直接把文件上传到云端是最省事的方案。

换句话说,这种“一个 upload 接口”或“前端直传 OSS”模式,其实是面向通用型 SaaS 场景的。

对于绝大多数互联网业务来说,它既够快又够省心。

但一旦项目换成政企、私有化部署或者 AI 训练平台这种环境,

就完全不是一个量级的问题了。

这里的关键不在“能不能上传”,

而在于文件上传之后的可控性、可追溯性和安全性。

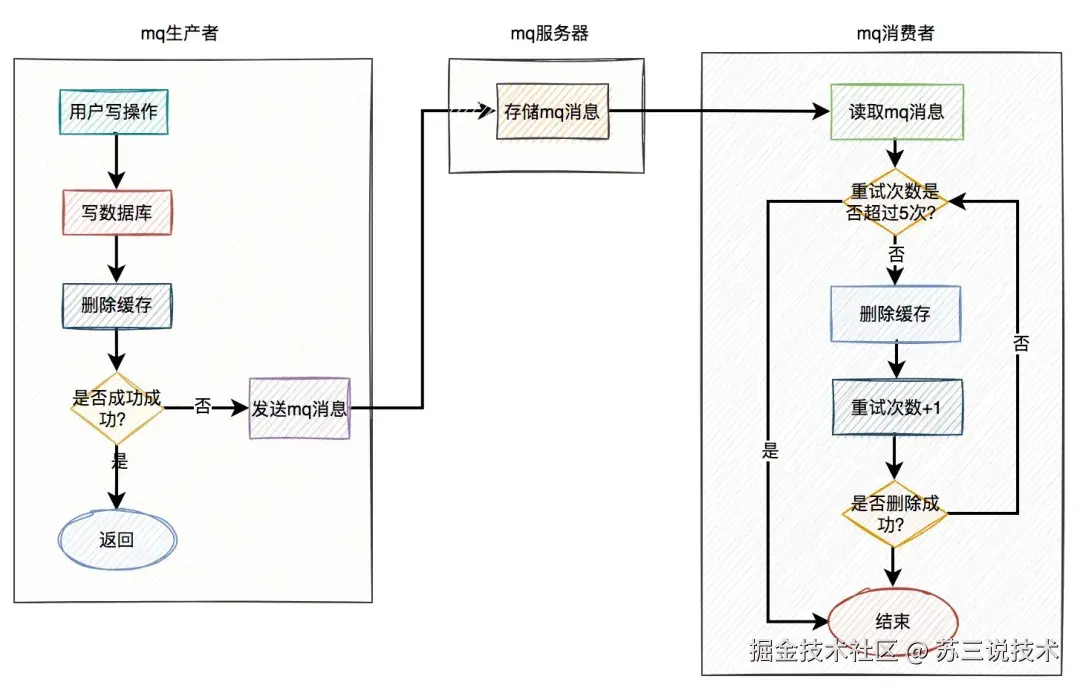

前端常见的大文件上传方式

在重新设计后端接口之前,我们先来看看现在前端常见的大文件上传思路。

其实近几年前端这块已经比较成熟了,主流方案大体都是围绕几个核心点展开的:

秒传检测、分片上传、断点续传、并发控制、进度展示。

一般来说,前端拿到文件后,会先计算一个文件哈希值,比如用 MD5。

这样做的目的是为了做秒传检测:

如果服务器上已经存在这个文件,就可以直接跳过上传,节省时间和带宽。

接下来是分片上传。

文件太大时,前端会把文件拆成多个固定大小的小块(比如每块 5MB 或 10MB),

然后一片一片地上传。这样做可以避免一次性传输大文件导致浏览器卡顿或网络中断。

然后就是断点续传。

前端会记录哪些分片已经上传成功,如果上传过程中网络中断或浏览器刷新,

下次只需要从未完成的分片继续上传,不用重新传整包文件。

在性能方面,前端还会做并发控制。

比如同时上传三到五个分片,上传完一个就立刻补下一个,

这样整体速度比单线程串行上传要快很多。

最后是进度展示。

通过监听每个分片的上传状态,前端可以计算整体进度,

给用户展示一个实时的上传百分比或进度条,让体验更可控。

可以看到,前端的大文件上传方案已经形成了一套相对标准的模式。

所以这次我在重新设计后端的时候,就打算基于这种前端逻辑,

去构建一套更贴合企业私有化环境的上传接口控制体系。

目标是让前后端的职责划分更清晰:

前端负责切片、控制与恢复;后端负责存储、校验与合并。

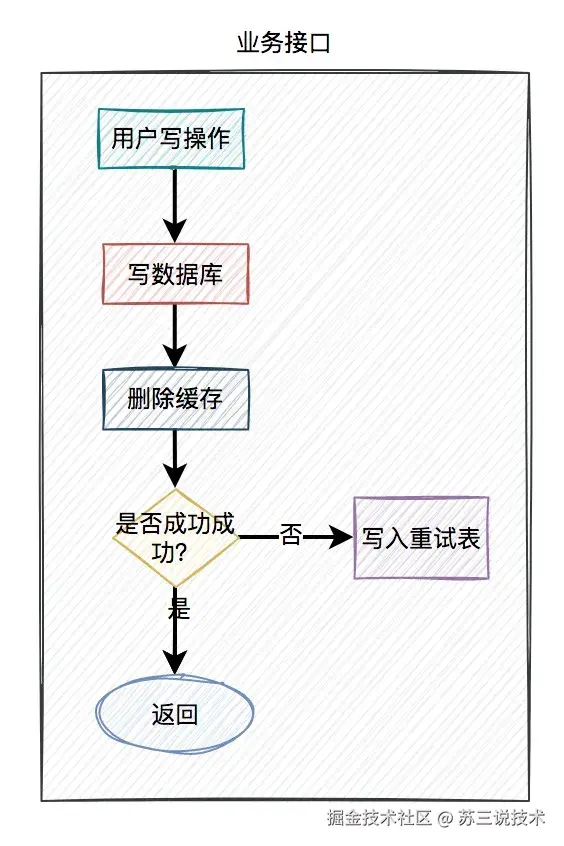

后端接口设计思路

前端的大文件上传流程其实已经相对固定了,我们只要让后端的接口和它配合得上,就能把整个上传链路打通。

所以我这次重新设计时,把上传接口拆成了几个比较独立的阶段:

秒传检查、初始化任务、上传分片、合并文件、暂停任务、取消任务、任务列表。

每个接口都只负责一件事,这样接口的职责会更清晰,也方便后期扩展。

一、/upload/check —— 秒传检查

这个接口是整个流程的第一步,用来判断文件是否已经上传过。

前端在计算完文件的全局 MD5(或其他 hash)后,会先调这个接口。

如果后端发现数据库里已经有相同 hash 的文件,就直接返回“已存在”,前端就不用再上传了。

请求示例:

POST /api/upload/check

{

"fileHash": "md5_abc123def456",

"fileName": "training-docs.zip",

"fileSize": 5342245120

}

返回示例:

{

"success": true,

"data": {

"exists": false

}

}

如果 exists = true,说明服务端已经有这个文件,可以直接走“秒传成功”的逻辑。

伪代码示例:

@PostMapping("/check")

public Result checkFile(@RequestBody Map body) {

// 1. 校验 fileHash 参数是否为空

// 2. 查询 file_info 表是否已有该文件

// 3. 如果文件已存在,直接返回秒传成功(exists = true)

// 4. 如果文件不存在,查询 upload_task 表中是否有未完成任务(支持断点续传)

}

二、/upload/init —— 初始化上传任务

如果文件不存在,就要先初始化一个新的上传任务。

这个接口的作用是创建一条 upload_task 记录,同时返回一个唯一的 uploadId。

前端会用这个 uploadId 来标识整个上传过程。

请求示例:

POST /api/upload/init

{

"fileHash": "md5_abc123def456",

"fileName": "training-docs.zip",

"totalChunks": 320,

"chunkSize": 5242880

}

返回示例:

{

"success": true,

"data": {

"uploadId": "b4f8e3a7-1a0c-4a1d-88af-61e98d91a49b",

"uploadedChunks": []

}

}

uploadedChunks 用来支持断点续传,如果之前有部分分片上传过,就会在这里返回索引数组。

伪代码示例:

@PostMapping("/init")

public Result initUpload(@RequestBody UploadInitRequest request) {

// 1. 检查是否已有同 fileHash 的任务,若有则返回旧任务信息(支持断点续传)

// 2. 否则创建新的 upload_task 记录,生成 uploadId

// 3. 初始化分片数量、大小、状态等信息

// 4. 返回 uploadId 与已上传分片索引列表

}

三、/upload/chunk —— 上传单个分片

这是整个上传过程里调用次数最多的接口。

每个分片都会单独上传一次,并在服务端保存为临时文件,同时写入 upload_chunk 表。

上传成功后,后端会更新 upload_task 的进度信息。

请求示例(表单上传):

POST /api/upload/chunk

Content-Type: multipart/form-data

formData:

uploadId: b4f8e3a7-1a0c-4a1d-88af-61e98d91a49b

chunkIndex: 0

chunkSize: 5242880

chunkHash: md5_001

file: (二进制分片数据)

返回示例:

{

"success": true,

"data": {

"uploadId": "b4f8e3a7-1a0c-4a1d-88af-61e98d91a49b",

"chunkIndex": 0,

"chunkSize": 5242880

}

}

伪代码示例:

@PostMapping(value = "/chunk", consumes = MediaType.MULTIPART_FORM_DATA_VALUE)

public Result uploadChunk(@ModelAttribute UploadChunkRequest req) {

// 1. 校验任务状态,禁止上传已取消或已完成的任务

// 2. 检查本地目录(或云端存储桶)是否存在,不存在则创建

// 3. 接收当前分片文件并写入临时路径

// 4. 写入 upload_chunk 表,标记状态为 “已上传”

// 5. 更新 upload_task 的 uploaded_chunks 数量

}

四、/upload/merge —— 合并分片

当前端确认所有分片都上传完后,会调用 /upload/merge。

后端收到这个请求后,去检查所有分片是否完整,然后按照索引顺序依次合并。

合并成功后,会删除临时分片文件,并更新 upload_task 状态为“完成”。

如果启用了云存储,这一步也可以直接把合并后的文件上传到 OSS。

请求示例:

POST /api/upload/merge

{

"uploadId": "b4f8e3a7-1a0c-4a1d-88af-61e98d91a49b",

"fileHash": "md5_abc123def456"

}

返回示例:

{

"success": true,

"message": "文件合并成功",

"data": {

"storagePath": "/data/uploads/training-docs.zip"

}

}

伪代码示例:

@PostMapping("/merge")

public Result mergeFile(@RequestBody UploadMergeRequest req) {

// 1. 检查 upload_task 状态是否允许合并

// 2. 校验所有分片是否都上传完成

// 3. 如果是本地存储:按 chunk_index 顺序流式合并文件

// 4. 如果是云存储:调用云端分片合并 API(如 OSS、COS)

// 5. 校验文件 hash 完整性,更新任务状态为 COMPLETED

// 6. 将最终文件信息写入 file_info 表

}

五、/upload/pause —— 暂停任务

这个接口用于在上传过程中手动暂停任务。

前端可能会在网络波动或用户主动点击暂停时调用。

后端会更新任务状态为“已暂停”,并记录当前已上传的分片数。

请求示例:

POST /api/upload/pause

{

"uploadId": "b4f8e3a7-1a0c-4a1d-88af-61e98d91a49b"

}

返回示例:

{

"success": true,

"message": "任务已暂停"

}

伪代码示例:

@PostMapping("/pause")

public Result pauseUpload(@RequestBody UploadPauseRequest req) {

// 1. 查找对应的 upload_task

// 2. 更新任务状态为 “已暂停”

// 3. 返回任务状态确认信息

}

六、/upload/cancel —— 取消任务

如果用户想放弃本次上传,可以调用 /cancel。

后端会把任务状态标记为“已取消”,并清理对应的临时分片文件。

这样能避免磁盘上堆积无用数据。

请求示例:

POST /api/upload/cancel

{

"uploadId": "b4f8e3a7-1a0c-4a1d-88af-61e98d91a49b"

}

返回示例:

{

"success": true,

"message": "任务已取消"

}

伪代码示例:

@PostMapping("/cancel")

public Result cancelUpload(@RequestBody UploadCancelRequest req) {

// 1. 查找对应的 upload_task

// 2. 更新任务状态为 “已取消”

// 3. 删除或标记已上传的分片文件为待清理

// 4. 返回操作结果

}

七、/upload/list —— 查询任务列表

这个接口我们用于管理后台查看当前上传任务的整体情况。

可以展示每个任务的文件名、大小、进度、状态、上传人等信息,方便追踪和审计。

请求示例:

GET /api/upload/list

返回示例:

{

"success": true,

"data": [

{

"uploadId": "b4f8e3a7-1a0c-4a1d-88af-61e98d91a49b",

"fileName": "training-docs.zip",

"status": "COMPLETED",

"uploadedChunks": 320,

"totalChunks": 320,

"uploader": "admin",

"createdAt": "2025-10-20 14:30:12"

}

]

}

伪代码示例:

@GetMapping("/list")

public Result> listUploadTasks() {

// 1. 查询所有上传任务

// 2. 按创建时间或状态排序

// 3. 返回任务摘要信息(任务名、状态、进度、上传人等)

}

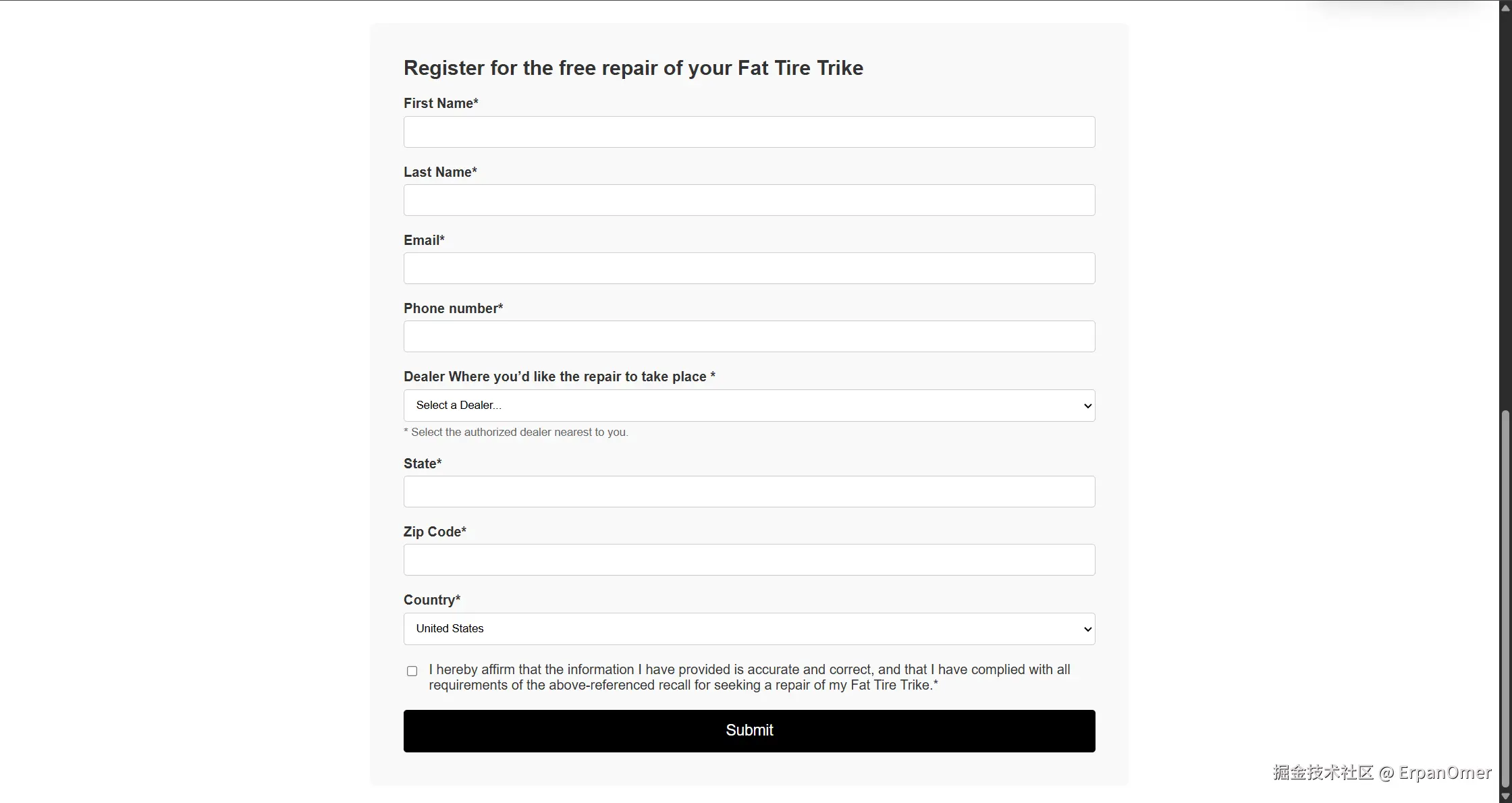

接口调用顺序小结

那我们这整个上传过程的调用顺序就是:

1. /upload/check → 秒传检测

2. /upload/init → 初始化上传任务

3. /upload/chunk → 循环上传所有分片

4. /upload/merge → 所有分片完成后合并

(可选)/upload/pause、/upload/cancel 用于控制任务

(可选)/upload/list 用于任务追踪与审计

接口调用顺序示意图

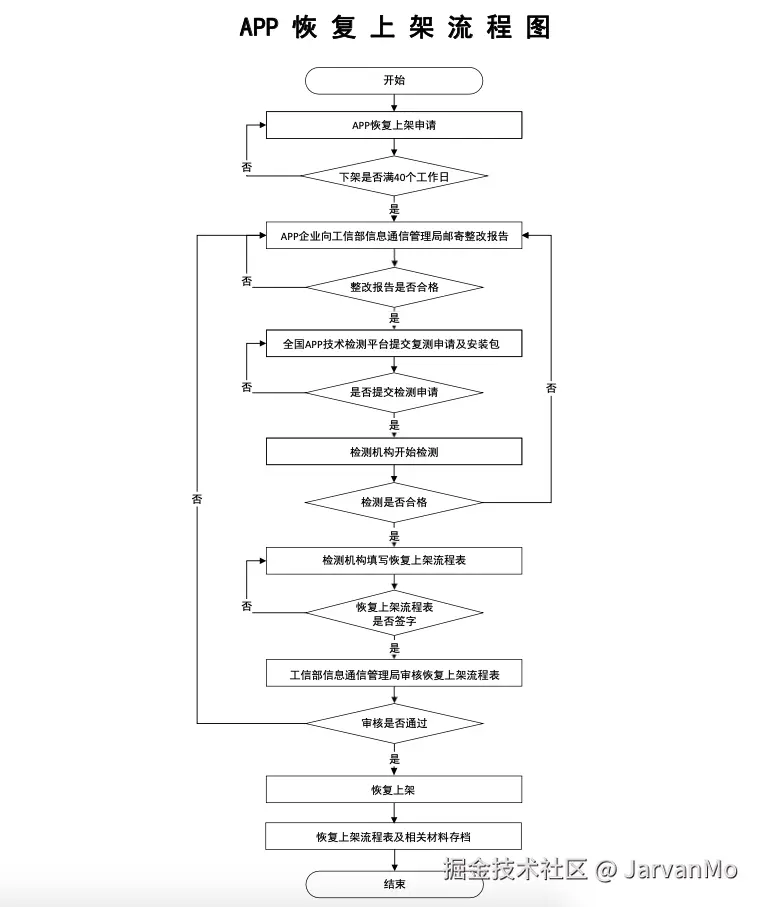

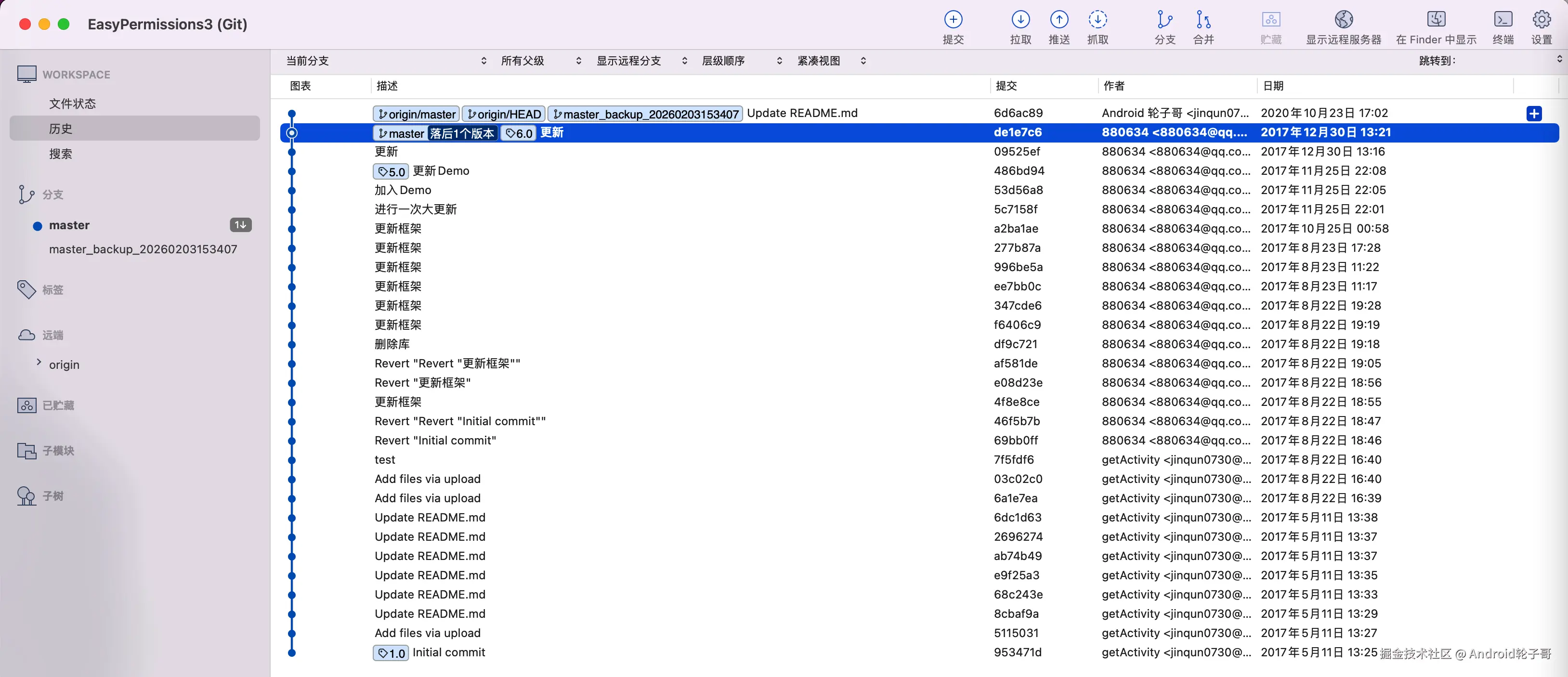

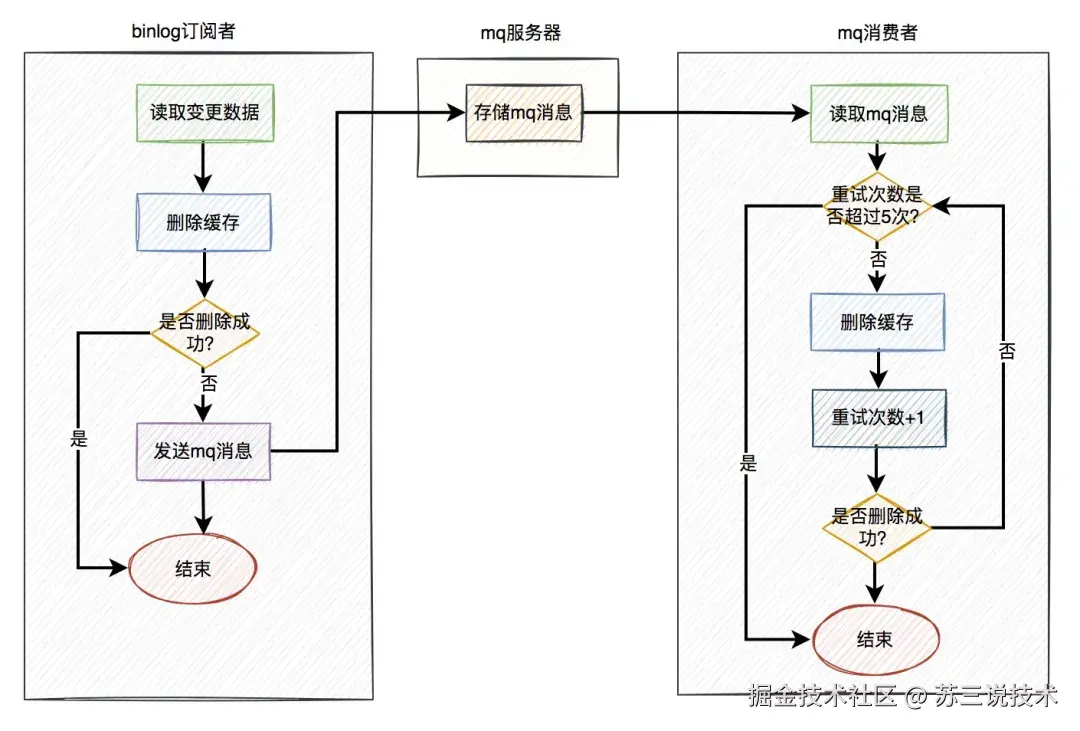

下面这张时序图展示了前端、后端、数据库在整个上传过程中的交互关系。

这样安排有几个好处:

- 逻辑衔接顺:上面刚讲完每个接口的职责,下面立刻用图总结;

- 视觉节奏平衡:读者读到这里已经看了不少文字,用图能缓解阅读疲劳;

- 承上启下:这张图既总结接口流程,又能自然引出下一节“数据库表设计”。

这套接口设计基本能覆盖大文件上传在企业项目中的常见需求。

接下来,我们再来看看支撑这套接口背后的数据库表设计。

数据库的作用是让上传任务的状态可追踪、可恢复,也能在集群部署时保持一致性。

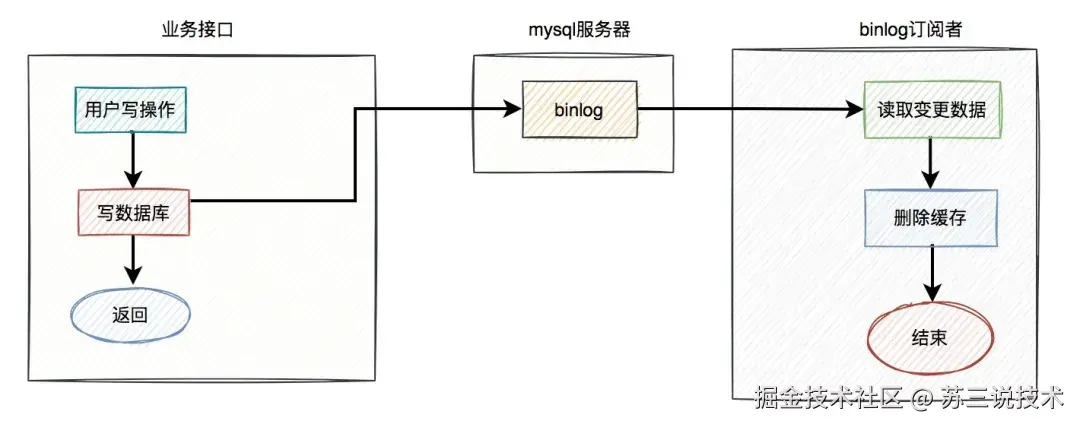

数据库表设计思路

前面说的那一套接口,要真正稳定地跑起来,

后端必须有一套能记录任务状态、分片信息、文件存储路径的数据库结构。

因为上传这种场景不是“一次请求就结束”的操作,它往往会持续几分钟甚至几个小时,

所以我们需要让任务状态可以追踪、可以恢复,还要能支撑集群部署。

我这次主要设计了三张核心表:upload_task(上传任务表)、upload_chunk(分片表)、file_info(文件信息表)。

它们分别负责记录任务、分片和最终文件三层的数据关系。

一、upload_task —— 上传任务表

这张表是整个上传过程的“总账”,

每一个文件上传任务,不管分成多少片,都会在这里生成一条记录。

它主要用来保存任务的全局信息,比如文件名、大小、上传进度、状态、存储方式等。

CREATE TABLE `upload_task` (

`id` bigint(20) NOT NULL AUTO_INCREMENT,

`upload_id` varchar(64) NOT NULL COMMENT '任务唯一ID(UUID)',

`file_hash` varchar(64) NOT NULL COMMENT '文件哈希(用于秒传与断点续传)',

`file_name` varchar(255) NOT NULL COMMENT '文件名称',

`file_size` bigint(20) NOT NULL COMMENT '文件总大小(字节)',

`chunk_size` bigint(20) NOT NULL COMMENT '每个分片大小(字节)',

`total_chunks` int(11) NOT NULL COMMENT '分片总数',

`uploaded_chunks` int(11) DEFAULT '0' COMMENT '已上传分片数量',

`status` tinyint(4) DEFAULT '0' COMMENT '任务状态:0-待上传 1-上传中 2-合并中 3-完成 4-取消 5-失败 6-已合并 7-已暂停',

`storage_type` varchar(32) DEFAULT 'local' COMMENT '存储类型:local/oss/cos/minio/s3等',

`storage_url` varchar(512) DEFAULT NULL COMMENT '文件最终存储地址(云端或本地路径)',

`local_path` varchar(512) DEFAULT NULL COMMENT '本地临时文件或合并文件路径',

`remark` varchar(255) DEFAULT NULL COMMENT '备注信息',

`uploader` varchar(64) DEFAULT NULL COMMENT '上传人',

`created_at` datetime DEFAULT CURRENT_TIMESTAMP COMMENT '创建时间',

`updated_at` datetime DEFAULT CURRENT_TIMESTAMP ON UPDATE CURRENT_TIMESTAMP COMMENT '更新时间',

PRIMARY KEY (`id`),

UNIQUE KEY `upload_id` (`upload_id`),

KEY `idx_hash` (`file_hash`),

KEY `idx_status` (`status`)

) ENGINE=InnoDB DEFAULT CHARSET=utf8mb4 COMMENT='上传任务表(支持多种云存储)';

设计要点:

upload_id是前端初始化任务后由后端生成的唯一标识;file_hash用来支持秒传逻辑;status控制任务生命周期(等待、上传中、合并中、完成等);storage_type、storage_url可以兼容多种存储方案(本地、OSS、COS、MinIO);uploaded_chunks字段让任务能随时恢复,适配断点续传。

二、upload_chunk —— 分片表

这张表对应每个上传任务下的所有分片。

每一个分片都会单独在这里占一条记录,用来追踪它的上传状态。

这张表的存在让我们能做断点续传、进度统计、以及合并前的完整性检查。

CREATE TABLE `upload_chunk` (

`id` bigint(20) NOT NULL AUTO_INCREMENT,

`upload_id` varchar(64) NOT NULL COMMENT '所属上传任务ID',

`chunk_index` int(11) NOT NULL COMMENT '分片索引(从0开始)',

`chunk_size` bigint(20) NOT NULL COMMENT '实际分片大小(字节)',

`chunk_hash` varchar(64) DEFAULT NULL COMMENT '可选:分片hash(用于高级去重)',

`status` tinyint(4) DEFAULT '0' COMMENT '状态:0-待上传 1-已上传 2-已合并',

`local_path` varchar(512) DEFAULT NULL COMMENT '分片本地路径',

`created_at` datetime DEFAULT CURRENT_TIMESTAMP COMMENT '创建时间',

`updated_at` datetime DEFAULT CURRENT_TIMESTAMP ON UPDATE CURRENT_TIMESTAMP COMMENT '更新时间',

PRIMARY KEY (`id`),

UNIQUE KEY `uniq_task_chunk` (`upload_id`,`chunk_index`),

KEY `idx_upload_id` (`upload_id`)

) ENGINE=InnoDB DEFAULT CHARSET=utf8mb4 COMMENT='上传分片表';

设计要点:

upload_id是任务外键,和upload_task一一对应;chunk_index代表分片顺序,合并文件时会按这个排序;chunk_hash可选字段,用来在上传前后做完整性校验;status字段控制上传进度(待上传、已上传、已合并);- 唯一索引 (

upload_id,chunk_index) 避免重复插入分片。

通过这张表,我们可以轻松实现断点续传:

当用户重新开始上传时,后端只返回未完成的分片索引,前端跳过已上传的部分。

三、file_info —— 文件信息表

这张表记录的是上传完成后的“最终文件信息”,

相当于系统的文件索引表。只要文件合并成功并通过校验,

后端就会往这里写入一条记录。

这张表支撑秒传功能,也能被后续的文档解析或向量化任务使用。

CREATE TABLE `file_info` (

`id` bigint(20) NOT NULL AUTO_INCREMENT,

`file_hash` varchar(64) NOT NULL COMMENT '文件hash,用于秒传',

`file_name` varchar(255) NOT NULL COMMENT '文件名称',

`file_size` bigint(20) NOT NULL COMMENT '文件大小',

`storage_type` varchar(32) DEFAULT 'local' COMMENT '存储类型:local/oss/cos/minio/s3等',

`storage_url` varchar(512) DEFAULT NULL COMMENT '文件最终存储地址(云端或本地路径)',

`uploader` varchar(64) DEFAULT NULL COMMENT '上传人',

`status` tinyint(4) DEFAULT '1' COMMENT '状态:1-正常,2-删除中,3-已归档',

`remark` varchar(255) DEFAULT NULL COMMENT '备注',

`created_at` datetime DEFAULT CURRENT_TIMESTAMP COMMENT '创建时间',

PRIMARY KEY (`id`),

UNIQUE KEY `file_hash` (`file_hash`)

) ENGINE=InnoDB DEFAULT CHARSET=utf8mb4 COMMENT='已上传文件信息表(支持多云存储)';

设计要点:

file_hash是全局唯一标识,用于秒传和查重;storage_url记录最终可访问路径;status可扩展为删除、归档等后续操作;- 这张表和业务系统中的“文档解析”、“知识库构建”可以直接关联。

四、三张表之间的关系

这三张表之间的关系我们可以简单理解为:

upload_task (上传任务)

├── upload_chunk (分片详情)

└── file_info (最终文件)

upload_task管理任务生命周期;upload_chunk跟踪每个分片的上传进度;file_info保存最终文件索引,用于秒传与后续 AI 处理。

这样设计的好处是:

- 上传状态可追踪;

- 上传任务可恢复;

- 文件信息可统一管理;

- 多节点部署也能保证一致性。

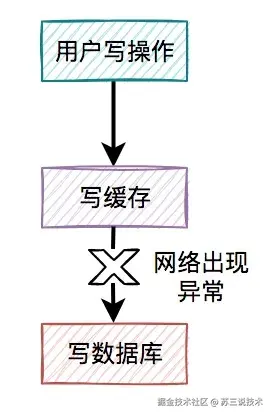

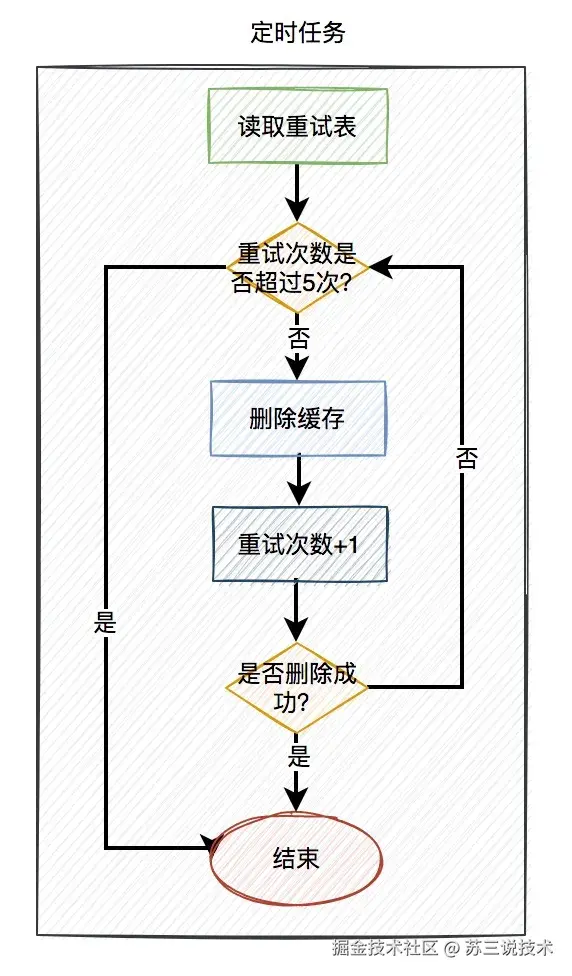

上传状态流转与任务恢复机制

有了前面的三张核心表,整个上传的过程就能被“状态机化”管理。

简单来说,我们希望每一个上传任务从创建、上传、合并到完成,都能有一个明确的状态,

系统也能在任意阶段中断后恢复,不需要用户重新来一遍。

我们把整个上传任务的生命周期划分成几个关键状态:

WAITING(0, "待上传"),

UPLOADING(1, "上传中"),

MERGING(2, "合并中"),

COMPLETED(3, "已完成"),

CANCELED(4, "已取消"),

FAILED(5, "上传失败"),

CHUNK_MERGED(6, "已合并"),

PAUSED(7, "已暂停");

一、WAITING(待上传)

当用户在前端发起上传、文件切片还没真正传上来之前,

系统会先生成一个上传任务记录(也就是 /upload/init 接口那一步)。

这个时候任务只是“登记”在数据库里,还没开始传数据。

我们可以理解为:

任务刚创建,还没开始跑。

此时前端拿到 uploadId,就可以开始逐片上传了。

在数据库层面,upload_task.status = 0,所有的分片表里还没有数据。

二、UPLOADING(上传中)

当第一个分片开始上传时,系统会把任务状态更新为 上传中。

这时候每上传一块分片,都会往 upload_chunk 表里写入一条记录,

并且更新任务的 uploaded_chunks 字段。

我们会周期性地根据分片上传数量去更新进度条,

比如已上传 35 / 100 块,系统就知道这部分可以恢复。

这个阶段是任务生命周期里最活跃的一段:

用户可能暂停、断网、刷新页面、甚至浏览器崩溃。

但是没关系,因为分片信息都落地到数据库了,

我们能随时通过 upload_chunk 的状态重新恢复上传。

三、PAUSED(已暂停)

如果用户主动点击“暂停上传”,

系统就会把任务状态标记为 PAUSED。

暂停并不会删除分片,只是告诉系统“不要再继续发请求”。

这样当用户重新点击“继续上传”时,

前端只需从后端拿到“哪些分片还没上传”,就能断点续传。

这个状态一般只在用户控制的情况下出现,

比如网络不好、或者中途切换网络时暂停。

四、CANCELED(已取消)

取消和暂停不同,取消意味着用户彻底放弃了这个上传任务。

任务会被标记为 CANCELED,同时系统可以选择:

- 删除已经上传的临时分片文件;

- 或者保留一段时间等待清理任务。

在后台日志中,这个状态主要用于审计:

记录谁取消了任务、在什么时间、上传了多少进度。

五、MERGING(合并中)

当所有分片都上传完成后,

后端会自动或手动触发文件合并逻辑(调用 /upload/merge)。

此时任务状态会切换为 MERGING,表示系统正在进行最后一步。

在这一步里:

- 如果是本地存储,会逐个读取分片文件并拼接为完整文件;

- 如果是云存储(比如 OSS、MinIO),则会触发服务端的分片合并 API。

合并过程通常比较耗时,尤其是几 GB 的文件,

所以单独拿出来作为一个明确状态是必要的。

六、CHUNK_MERGED(已合并)

有些系统会把合并成功但未做后续处理的状态单独标出来,

比如文件已经合并,但还没入库、还没解析。

这个状态可以让我们在合并之后还有机会做文件校验或后处理。

不过在实际项目里,也可以直接跳过这一步,

合并完后立刻进入下一状态——COMPLETED。

七、COMPLETED(已完成)

文件合并完成、验证通过、存储路径落地、写入 file_info 表,

这时候任务就算彻底完成了。

在这个状态下:

- 用户可以正常访问文件;

- 系统可以执行后续的解析任务(比如文档拆页、向量化等);

- 文件具备秒传条件,下次再上传同样的文件会直接跳过。

COMPLETED 是整个生命周期的终点状态。

在数据库中,任务记录会更新最终路径、存储类型、完成时间等字段。

八、FAILED(上传失败)

上传过程中如果出现异常,比如网络中断、磁盘写入异常、OSS 上传失败等,

系统会标记任务为 FAILED。

这一状态不会自动清理,

方便管理员事后追踪错误原因或人工恢复。

失败任务在设计上一般允许“重新启动”,

也就是通过任务 ID 重新触发上传,从未完成的分片继续。

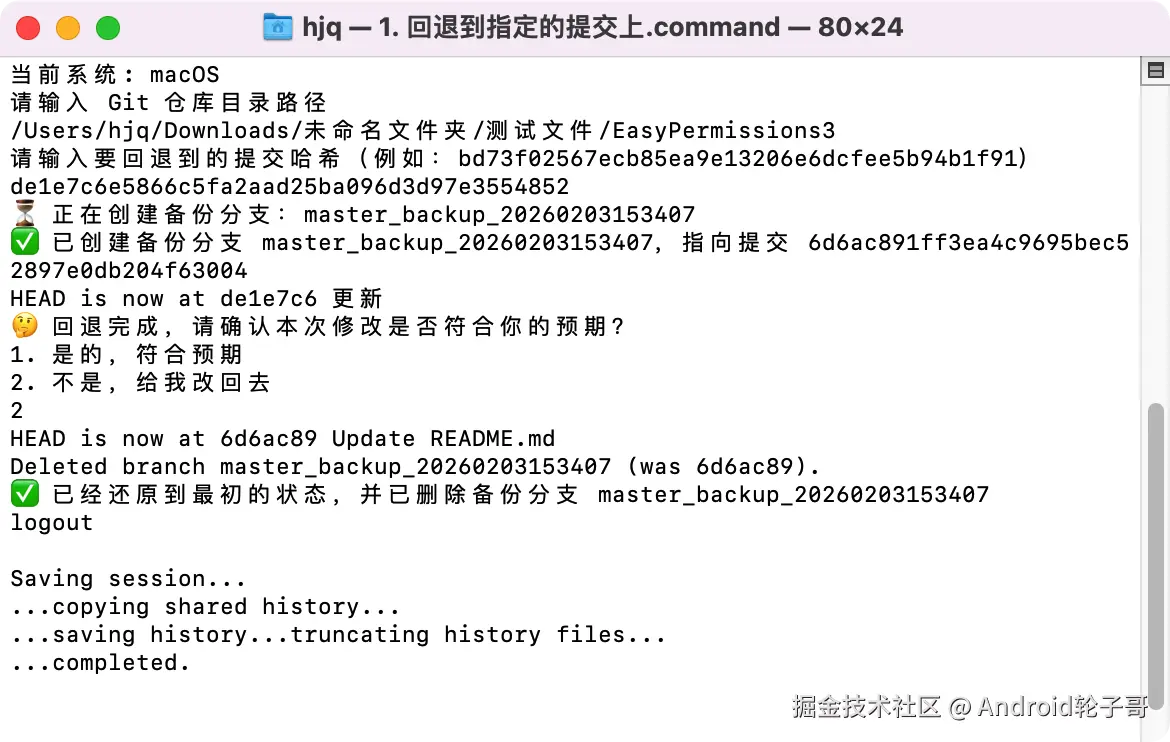

我们可以通过下面这张图可以更直观地看到整个上传任务的生命周期:

九、任务恢复机制

在这套机制下,任务恢复就变得非常自然。

前端每次进入上传页面时,只要传入文件的 hash,

后端就能通过 upload_task 和 upload_chunk 判断:

- 这个文件有没有上传任务;

- 如果有,哪些分片已经上传;

- 任务当前状态是什么(暂停、失败还是上传中)。

然后前端只需补传那些未上传的分片即可。

这就是我们常说的 断点续传(Resumable Upload) 。

在集群环境中,这套逻辑同样成立,

因为任务与分片状态都落在数据库,不依赖单台服务器。

无论请求打到哪一台机器,上传进度都是统一可见的。

十、中断后如何续传

在实际使用中,用户上传中断是很常见的。

比如文件太大上传到一半,浏览器突然关了;

或者公司网络断了,机器重启了;

甚至有人直接换了电脑继续操作。

如果系统没有任务恢复机制,那用户每次都得重新传一遍,

尤其是那种几个 G 的文件,不但浪费时间,还容易出错。

所以我们在设计这套上传中心时,

一开始就考虑了“断点续传”和“任务恢复”的问题。

1. 恢复上传靠的其实是数据库里的状态

断点续传的核心逻辑,其实很简单:

我们让任务和分片的状态都写进数据库。

每当用户重新进入上传页面、选中同一个文件时,

前端会先计算出文件的 hash,然后调用 /upload/check 接口。

后端收到 hash 后,会依次去查三张表:

- 先查

file_info

如果能查到,说明文件之前已经上传并合并成功,

这时候直接返回“文件已存在”,前端就能实现“秒传”,不需要重新上传。 - 查不到

file_info,就去查upload_task

如果找到了对应任务,就说明这个文件上传到一半被中断了。

这时我们会返回这个任务的 uploadId。 - 再查 `upload_chunk``

系统会统计出哪些分片已经上传成功,哪些还没传。

然后返回一个“未完成的分片索引列表”给前端。

前端拿到这些信息后,就能从中断的地方继续往下传,

不用再重复上传已经完成的部分。

2. 前端续传时的流程

前端拿到旧的 uploadId 和未完成分片列表后,

只需要跳过那些已经上传成功的分片,

然后照常调用 /upload/chunk 去上传剩下的部分。

上传过程中,每个分片的状态都会被实时更新到 upload_chunk 表中,upload_task 表的 uploaded_chunks 也会跟着同步增加。

当所有分片都上传完后,任务状态自动进入 MERGING(合并中)阶段。

所以整个续传过程,其实就是**“基于数据库状态的增量上传”**。

用户不需要额外操作,系统自己就能恢复上次的进度。

3. 任务状态和恢复判断

任务是否允许恢复,系统会根据 upload_task.status 来判断。

大致逻辑是这样的:

| 状态 | 是否可恢复 | 说明 |

|---|---|---|

| WAITING | 可以 | 任务刚创建,还没开始传 |

| UPLOADING | 可以 | 正在上传中,可以继续 |

| PAUSED | 可以 | 用户主动暂停,可以恢复 |

| FAILED | 可以 | 上传失败,可以重新尝试 |

| CANCELED | 不可以 | 用户主动取消,不再恢复 |

| COMPLETED | 不需要 | 已经完成,直接秒传 |

| MERGING | 等待中 | 系统正在合并,前端等待即可 |

这套判断逻辑让任务的行为更清晰。

比如用户暂停上传再回来时,可以直接恢复;

如果任务已经取消,那就算用户重启也不会再自动续传。

4. 多机器部署下的恢复问题

有些人会担心:如果我们的系统是集群部署的,

上传时中断后再续传,万一请求打到另一台机器上,

还能恢复吗?

其实没问题。

因为我们所有任务和分片的状态都是写进数据库的,

不依赖内存或本地文件。

也就是说,哪怕用户上次上传在 A 机器,这次续传到了 B 机器,

系统仍然能根据数据库的记录知道:

这个 uploadId 下的哪些分片已经上传完,哪些还没传。

所以集群部署下也能无缝续传,不会出现“不同机器不认任务”的情况。

5. 小结

整个任务恢复机制靠的就是两张表:upload_task 和 upload_chunk。upload_task 负责记录任务总体进度,upload_chunk 负责记录每个分片的上传状态。

当用户重新上传时,我们查表判断进度,

前端从未完成的地方继续传,就能实现真正意义上的“断点续传”。

这套机制有几个显著的好处:

- 上传进度可追踪;

- 中断后可恢复;

- 支持集群部署;

- 不依赖浏览器缓存或 Session。

所以,只要数据库没丢,任务记录还在,

上传进度就能恢复,哪怕换机器、重启系统都没问题。

文件合并与完整性校验

前面的所有步骤,其实都是在为这一刻做准备。

当用户的所有分片都上传完成后,接下来最重要的工作就是:

把这些分片拼成一个完整的文件,并且确保文件内容没有出错。

这一步看似简单,但其实是整个大文件上传流程里最容易出问题的地方。

尤其在集群部署下,如果不同分片分布在不同机器上,

那合并逻辑就不能只靠本地文件路径去拼接,否则根本找不到所有分片。

所以我们先来理一理整个思路。

一、合并的触发时机

前端在检测到所有分片都上传完成后,会调用 /upload/merge 接口。

这个接口的作用就是通知后端:

“这个任务的所有分片都传完了,现在可以开始合并了。”

后端接收到请求后,会先去查数据库确认几个关键信息:

- 这个任务对应的 uploadId 是否存在;

upload_chunk表里所有分片是否都处于 “已上传” 状态;- 当前任务状态是否允许合并(例如不是暂停、取消或失败)。

确认无误后,任务状态会从 UPLOADING 变成 MERGING,

正式进入文件合并阶段。

二、本地合并逻辑

如果系统配置的是本地存储(也就是 cloud.enable = false),

那所有分片文件都保存在服务器的临时目录中。

合并逻辑大致是这样的:

- 后端按分片的

chunk_index顺序,依次读取每个分片文件。 - 逐个写入到一个新的目标文件中,比如

merge.zip。 - 每合并一个分片,就更新数据库中的状态。

- 合并完成后,把任务状态更新为

COMPLETED,并写入最终路径。

整个过程看起来很直观,

但这里有两个要点需要特别注意:

- 写入顺序要严格按照分片索引,否则文件内容会错乱;

- 文件 IO 要用流式写入(Stream) ,避免内存一次性读取所有分片导致溢出。

合并完成后,我们会计算整个文件的 MD5,与原始 fileHash 对比,

如果不一致,就说明合并过程中数据丢失或出错。

这种情况任务会被标记为 FAILED,并在日志中留下异常记录。

三、云端合并逻辑

如果我们配置了云存储(比如 OSS、COS、MinIO 等),

那分片文件就不是存在本地磁盘,而是上传到云端的对象存储桶里。

在这种情况下,合并逻辑就不需要我们自己拼文件了,

因为大部分云存储服务都提供了“分片合并”的 API。

比如以 OSS 为例,上传时我们调用的是 uploadPart 接口,

合并时只需要调用 completeMultipartUpload,

它会根据上传时的分片顺序自动合并为一个完整对象。

整个过程的优点是:

- 不占用本地磁盘;

- 不受单机 IO 限制;

- 云端自动校验每个分片的完整性。

所以在云存储场景下,我们只需要做两件事:

- 通知云服务去执行合并;

- 成功后记录最终的文件地址(

storage_url)到数据库。

这样整个流程就闭环了。

四、集群部署下的合并问题

单机情况下,合并很简单,因为所有分片都在本地。

但如果系统是集群部署的,分片请求可能打到了不同机器,

这时候分片文件就会分散在多个节点上。

我们在设计时考虑了三种解决方案:

方案 1:共享存储(私有化部署下比较推荐)

最常见的做法是把所有机器的上传目录指向同一个共享路径,

比如通过 NFS、NAS、或对象存储挂载到 /data/uploads。

这样无论用户上传的分片打到哪台机器,

最终都会写入同一个物理目录。

当合并请求发起时,任意一台机器都能访问到完整的分片文件。

这是目前在企业部署中最稳定、最通用的方案。

方案 2:云存储中转

如果机器之间没有共享目录,那我们可以让每个分片先上传到云端,

合并时再调用云服务的 API 进行分片合并。

这种方式适合公网可访问的 SaaS 环境。

但对于政企内网部署,就不一定行得通。

方案 3:统一调度节点

还有一种是我们自己维护一个“合并调度节点”,

所有分片上传完后,系统会把合并任务分配到一个指定节点执行,

这个节点会从其他机器拉取分片(比如通过 HTTP 内部传输或 RPC)。

这种方式更复杂,适合大规模分布式存储场景。

在私有化项目中,我们一般采用第一种方式——共享目录 + 本地合并。

既能保证性能,也能兼顾安全性。

五、完整性校验

文件合并完成后,最后一步是完整性校验。

我们会重新计算合并后文件的 MD5,与前端最初上传的 fileHash 对比。

如果一致,就说明文件合并成功,内容没有丢失;

如果不一致,就说明某个分片损坏或顺序错误,

任务会被标记为 FAILED,并自动记录错误日志。

这样可以确保文件数据的安全性,

避免在后续 AI 解析或向量化阶段出现内容异常。

六、异步处理与性能优化

开头的视频里我们也看到了,整个上传和合并过程我们是同步执行的。

从前端开始上传分片,到最后文件合并完成,都在等待同一个流程走完。

这种方式在演示时很直观,但在真实项目中其实问题不少。

最明显的一个问题就是——时间太长。

像我们刚才那个 1GB 的文件,即使网络稳定、服务器性能还可以,

整个流程也要几分钟甚至更久。

如果我们让前端一直等待响应,接口超时、连接断开、前端刷新这些问题就都会冒出来。

所以,在真正的业务系统里,我们一般会把合并、校验、迁移 OSS 或解析入库这些操作改成异步任务来做。

接口只负责接收分片、登记状态,然后立刻返回“任务已创建”或“上传完成,正在处理中”的提示。

后续的合并、校验、清理临时文件这些工作交给后台的异步线程、任务队列或者调度器去跑。

这样做的好处有几个:

- 前端体验更流畅,不用卡在“等待合并”阶段;

- 后端可以批量处理任务,减少高峰期的 IO 压力;

- 如果任务失败或中断,也能通过任务表重试或补偿;

- 对接外部存储或 AI 解析流程时,也能自然衔接后续任务链。

简单来说,上传只是第一步,

而合并、校验、转存这些操作本质上更像是后台任务。

我们在系统设计时只要把这些环节分开,让接口尽量“轻”,

这套上传系统就能在面对更大文件、更复杂场景时依然稳定可靠。

七、小结

整个合并与校验阶段,是把前面所有分片上传工作“收尾”的过程。

我们通过以下机制保证了稳定性:

- 本地存储场景下:顺序读取 + 流式写入 + hash 校验;

- 云存储场景下:依赖云端分片合并 API;

- 集群环境下:通过共享存储或统一调度节点解决文件分散问题;

- 数据库层面:实时记录状态,便于追踪和审计。

最终,当文件合并成功、校验通过后,

系统会将结果写入 file_info 表,

整条上传链路就算是完整闭环。

最后

我们平常做的项目,大多数时候文件上传都挺简单的。

前端传到 OSS,后端接个地址存起来就行。

但等真正做私有化项目的时候,也就会发现很多地方都不一样了。

要求更多,考虑的细节也多得多。

像这次做的大文件上传就是个很典型的例子。

以前那种简单方案,放在这种环境下就完全不够用了。

得考虑断点续传、任务恢复、集群部署、权限、审计这些东西,

一步没想好,后面全是坑。

我们现在这套设计,其实就是在解决这些“现实问题”。

接口虽然多一点,但每个职责都很清晰,

任务状态能追踪,上传中断能恢复,

甚至以后如果我们想单独抽出来做一个文件系统模块也完全没问题。

不管是拿来给知识库用,还是 AI 向量化、文档解析,这套逻辑都能复用。

其实很多以前觉得“简单”的功能,

一旦遇到复杂场景,其实都得重新想。

但好处是,一旦做通了,这套东西就能稳定用很久。

到这里,大文件上传这块我们算是完整走了一遍。

以后再遇到类似需求,我们就有经验了,

不用再从头掉坑里爬出来一次哈。

更多架构实战、工程化经验和踩坑复盘,我会在公众号 「洛卡卡了」 持续更新。

如果内容对你有帮助,欢迎关注我,我们一起每天学一点,一起进步。

来源:juejin.cn/post/7571355989133099023

程序员,你使用过灰度发布吗?

大家好呀,我是猿java。

在分布式系统中,我们经常听到灰度发布这个词,那么,什么是灰度发布?为什么需要灰度发布?如何实现灰度发布?这篇文章,我们来聊一聊。

1. 什么是灰度发布?

简单来说,灰度发布也叫做渐进式发布或金丝雀发布,它是一种逐步将新版本应用到生产环境中的策略。相比于一次性全量发布,灰度发布可以让我们在小范围内先行测试新功能,监控其表现,再决定是否全面推开。这样做的好处是显而易见的:

- 降低风险:新版本如果存在 bug,只影响少部分用户,减少了对整体用户体验的冲击。

- 快速回滚:在小范围内发现问题,可以更快地回到旧版本。

- 收集反馈:可以在真实环境中收集用户反馈,优化新功能。

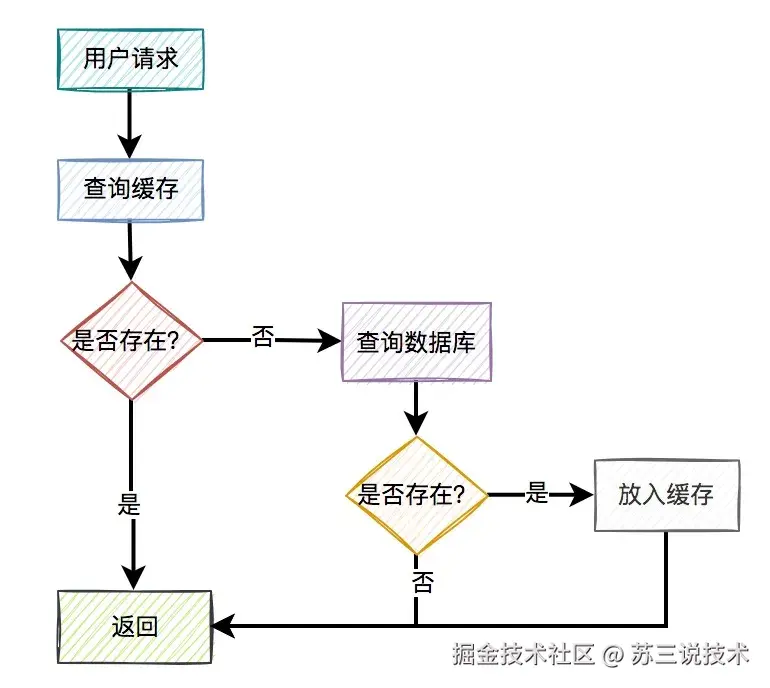

2. 原理解析

要理解灰度发布,我们需要先了解一下它的基本流程:

- 准备阶段:在生产环境中保留旧版本,同时引入新版本。

- 小范围发布:将新版本先部署到一小部分用户,例如1%-10%。

- 监控与评估:监控新版本的性能和稳定性,收集用户反馈。

- 逐步扩展:如果一切正常,将新版本逐步推广到更多用户。

- 全面切换:当确认新版本稳定后,全面替换旧版本。

在这个过程中,关键在于如何切分流量,确保新旧版本平稳过渡。常见的切分方式包括:

- 基于用户ID:根据用户的唯一标识,将部分用户指向新版本。

- 基于地域:先在特定地区进行发布,观察效果后再扩展到其他地区。

- 基于设备:例如,先在Android或iOS用户中进行发布。

3. 示例演示

为了更好地理解灰度发布,接下来,我们通过一个简单的 Java示例来演示基本的灰度发布策略。假设我们有一个简单的 Web应用,有两个版本的登录接口/login/v1和/login/v2,我们希望将百分之十的流量引导到v2,其余流量继续使用v1。

3.1 第一步:引入灰度策略

我们可以通过拦截器(Interceptor)来实现流量的切分。以下是一个基于Spring Boot的简单实现:

import org.springframework.stereotype.Component;

import org.springframework.web.servlet.HandlerInterceptor;

import javax.servlet.http.HttpServletRequest;

import javax.servlet.http.HttpServletResponse;

import java.util.Random;

@Component

public class GrayReleaseInterceptor implements HandlerInterceptor {

private static final double GRAY_RELEASE_PERCENT = 0.1; // 10% 流量

@Override

public boolean preHandle(HttpServletRequest request, HttpServletResponse response, Object handler) throws Exception {

String uri = request.getRequestURI();

if ("/login".equals(uri)) {

if (isGrayRelease()) {

// 重定向到新版本接口

response.sendRedirect("/login/v2");

return false;

} else {

// 使用旧版本接口

response.sendRedirect("/login/v1");

return false;

}

}

return true;

}

private boolean isGrayRelease() {

Random random = new Random();

return random.nextDouble() < GRAY_RELEASE_PERCENT;

}

}

3.2 第二步:配置拦截器

在Spring Boot中,我们需要将拦截器注册到应用中:

import org.springframework.beans.factory.annotation.Autowired;

import org.springframework.context.annotation.Configuration;

import org.springframework.web.servlet.config.annotation.*;

@Configuration

public class WebConfig implements WebMvcConfigurer {

@Autowired

private GrayReleaseInterceptor grayReleaseInterceptor;

@Override

public void addInterceptors(InterceptorRegistry registry) {

registry.addInterceptor(grayReleaseInterceptor).addPathPatterns("/login");

}

}

3.3 第三步:实现不同版本的登录接口

import org.springframework.web.bind.annotation.*;

@RestController

@RequestMapping("/login")

public class LoginController {

@GetMapping("/v1")

public String loginV1(@RequestParam String username, @RequestParam String password) {

// 旧版本登录逻辑

return "登录成功 - v1";

}

@GetMapping("/v2")

public String loginV2(@RequestParam String username, @RequestParam String password) {

// 新版本登录逻辑

return "登录成功 - v2";

}

}

在上面三个步骤之后,我们就实现了登录接口地灰度发布:

- 当用户访问

/login时,拦截器会根据设定的灰度比例(10%)决定请求被重定向到/login/v1还是/login/v2。 - 大部分用户会体验旧版本接口,少部分用户会体验新版本接口。

3.4 灰度发布优化

上述示例,我们只是一个简化的灰度发布实现,实际生产环境中,我们可能需要更精细的灰度策略,例如:

- 基于用户属性:不仅仅是随机切分,可以根据用户的地理位置、设备类型等更复杂的条件。

- 动态配置:通过配置中心动态调整灰度比例,无需重启应用。

- 监控与告警:集成监控系统,实时监控新版本的性能指标,异常时自动回滚。

- A/B 测试:结合A/B测试,进一步优化用户体验和功能效果。

4. 为什么需要灰度发布?

在实际工作中,为什么我们要使用灰度发布?这里我们总结了几个重要的原因。

4.1 降低发布风险

每次发布新版本,尤其是功能性更新或架构调整,都会伴随着一定的风险。即使经过了充分的测试,实际生产环境中仍可能出现意想不到的问题。灰度发布通过将新版本逐步推向部分用户,可以有效降低全量发布可能带来的风险。

举个例子,假设你上线了一个全新的支付功能,直接面向所有用户开放。如果这个功能存在严重 bug,可能导致大量用户无法完成支付,甚至影响公司声誉。而如果采用灰度发布,先让10%的用户体验新功能,发现问题后只需影响少部分用户,修复起来也更为迅速和容易。

4.2 快速回滚

在传统的全量发布中,一旦发现问题,回滚到旧版本可能需要耗费大量时间和精力,尤其是在高并发系统中,数据状态的同步与恢复更是复杂。而灰度发布由于新版本只覆盖部分流量,问题定位和回滚变得更加简单和快速。

比如说,你在灰度发布阶段发现新版本的某个功能在某些特定条件下会导致系统崩溃,立即可以停止向新用户推送这个版本,甚至只针对受影响的用户进行回滚操作,而不用影响全部用户的正常使用。

4.3 实时监控与反馈

灰度发布让你有机会在真实的生产环境中监控新版本的表现,并收集用户的反馈。这些数据对于评估新功能的实际效果至关重要,有助于做出更明智的决策。

举个具体的场景,你新增了一个推荐算法,希望提升用户的点击率。在灰度发布阶段,你可以监控新算法带来的点击率变化、服务器负载情况等指标,确保新算法确实带来了预期的效果,而不是引入了新的问题。

4.4 提升用户体验

通过灰度发布,你可以在推出新功能时,逐步优化用户体验。先让一部分用户体验新功能,收集他们的使用反馈,根据反馈不断改进,最终推出一个更成熟、更符合用户需求的版本。

举个例子,你开发了一项新的用户界面设计,直接全量发布可能会让一部分用户感到不适应或不满意。灰度发布允许你先让一部分用户体验新界面,收集他们的意见,进行必要的调整,再逐步扩大使用范围,确保最终发布的版本能获得更多用户的认可和喜爱。

4.5 支持A/B测试

灰度发布是实现A/B测试的基础。通过将用户随机分配到不同的版本,你可以比较不同版本的表现,选择最优方案进行全面推行。这对于优化产品功能和提升用户体验具有重要意义。

比如说,你想测试两个不同的推荐算法,看哪个能带来更高的转化率。通过灰度发布,将用户随机分配到使用算法A和算法B的版本,比较它们的表现,最终选择效果更好的算法进行全面部署。

4.6 应对复杂的业务需求

在一些复杂的业务场景中,全量发布可能无法满足灵活的需求,比如分阶段推出新功能、针对不同用户群体进行差异化体验等。灰度发布提供了更高的灵活性和可控性,能够更好地适应多变的业务需求。

例如,你正在开发一个面向企业用户的新功能,希望先让部分高价值客户试用,收集他们的反馈后再决定是否全面推广。灰度发布让这一过程变得更加顺畅和可控。

5. 总结

本文,我们详细地分析了灰度发布,它是一种强大而灵活的部署策略,能有效降低新版本上线带来的风险,提高系统的稳定性和用户体验。作为Java开发者,掌握灰度发布的原理和实现方法,不仅能提升我们的技术能力,还能为团队的项目成功保驾护航。

对于灰度发布,如果你有更多的问题或想法,欢迎随时交流!

6. 学习交流

如果你觉得文章有帮助,请帮忙转发给更多的好友,或关注公众号:猿java,持续输出硬核文章。

来源:juejin.cn/post/7488321730764603402

布隆过滤器(附Java代码)

一、前言

想象这样一个场景:你的电商系统每天有1000万次商品查询,但其中90%是无效ID(比如用户手误输入或恶意爬虫)。每次查询都要穿透缓存打到数据库,数据库压力山大!

// 传统做法:每次都要查数据库

public Product queryProduct(Long id) {

Product product = cache.get(id); // Redis缓存

if (product == null) {

product = db.query(id); // 90%的无效请求打到数据库!

if (product != null) {

cache.set(id, product);

}

}

return product;

}

布隆过滤器(Bloom Filter) 就是解决这类问题的利器:它用极小的空间快速判断“某个元素一定不存在”或“可能存在”,从而在查询前提前拦截无效请求,保护后端数据库。

典型应用场景:

- 防止缓存穿透(无效Key反复查询数据库)

- 网页爬虫URL去重

- 邮箱系统黑名单过滤

- 推荐系统已读内容过滤

二、核心原理

2.1 生活化类比:图书馆的“借书登记表”

假设图书馆有100万个座位,管理员用一张超大登记表(位数组)记录谁来过:

| 座位号 | 1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 | 9 | 10 | ... |

|---|---|---|---|---|---|---|---|---|---|---|---|

| 状态 | 0 | 1 | 0 | 1 | 0 | 0 | 1 | 0 | 0 | 1 | ... |

- 当张三来借书,管理员用3个不同规则计算他的“专属座位”:

- 规则1:姓名笔画数 % 10 → 座位2

- 规则2:身-份-证后3位 % 10 → 座位4

- 规则3:生日数字和 % 10 → 座位7

- 管理员把2、4、7号座位标记为

1 - 下次张三再来,只要所有对应座位都是1,就认为“他可能来过”;只要有一个是0,就确定“他没来过”

核心特性:

- 绝不漏判:如果元素不存在,100%能判断出来(座位有0)

- 可能误判:如果所有座位都是1,可能是别人“撞座位”了(误判率可控)

- 无法删除:座位一旦标1,不能随便改回0(否则会影响其他元素)

2.2 技术原理图解

元素 "nontee"

│

├─ 哈希函数1 → 位置 15 → 位数组[15] = 1

├─ 哈希函数2 → 位置 87 → 位数组[87] = 1

└─ 哈希函数3 → 位置 203 → 位数组[203] = 1

查询 "nontee"

│

├─ 哈希函数1 → 位置 15 → 检查位数组[15] == 1? ✓

├─ 哈希函数2 → 位置 87 → 检查位数组[87] == 1? ✓

└─ 哈希函数3 → 位置 203 → 检查位数组[203] == 1? ✓

↓

结论:可能存在(需二次确认)

2.3 关键参数:如何控制误判率?

布隆过滤器有3个核心参数:

| 参数 | 说明 | 影响 |

|---|---|---|

m | 位数组大小(bit) | 越大误判率越低,但占空间 |

n | 预期插入元素数量 | 超过预期会导致误判率飙升 |

k | 哈希函数个数 | 最佳值 ≈ (m/n) * ln2 |

误判率公式:

经验法则:每存储1个元素,分配10bit空间,误判率约1%

例如:存储100万个元素 → 需要 100万 × 10 bit ≈ 1.25MB(传统HashSet需几十MB!)

三、代码实战

3.1 手写简易版布隆过滤器(理解原理必备)

import java.util.BitSet;

import java.util.MissingResourceException;

/**

* 简易布隆过滤器实现(教学用途)

* 特点:使用3个哈希函数,固定大小位数组

*/

public class SimpleBloomFilter {

// 位数组(实际存储结构)

private final BitSet bitSet;

// 位数组大小(单位:bit)

private final int bitSize;

// 哈希函数种子(用于生成不同哈希值)

private final int[] seeds = {7, 11, 13};

/**

* 构造函数

* @param expectedSize 预期元素数量